結論ファースト

AIインフラ分野に明確な分岐点が現れた。超長コンテキスト需要を巡り、業界は全く異なる2つの技術路線に分裂しつつある。

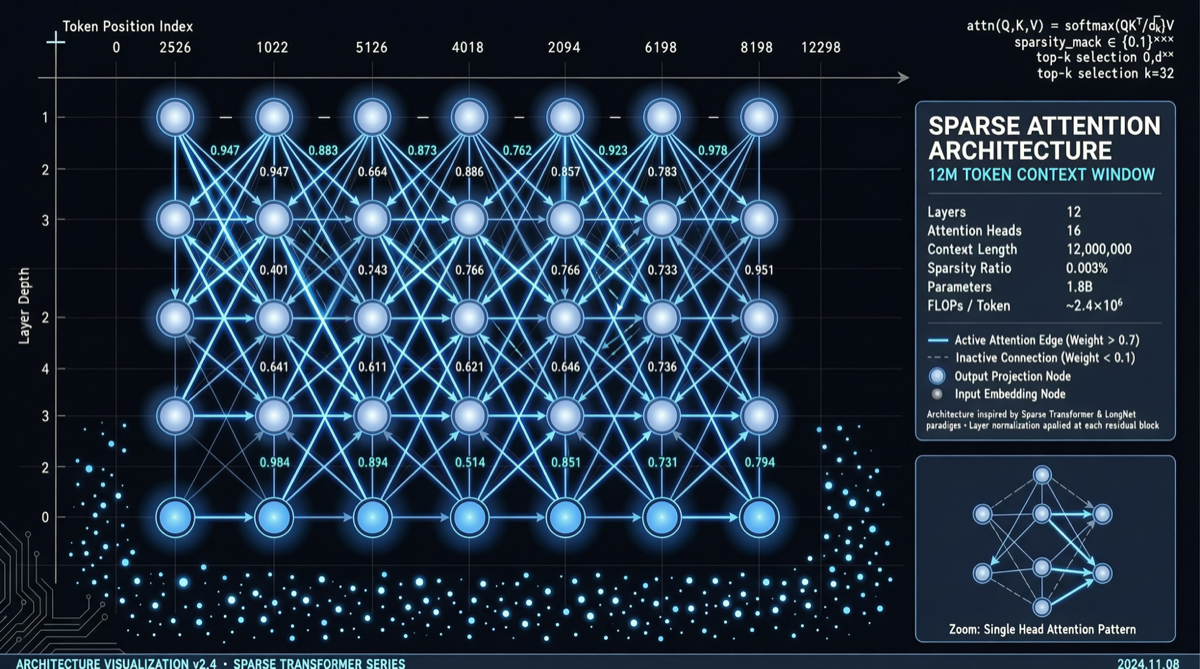

路線其一(垂直統合):SubQが2900万ドルを調達し、1200万トークンコンテキスト対応モデルをゼロから再訓練。

- 高リスク・ハイリターン。成功すればパフォーマンスと効率性の両方をコントロール可能

- ただし膨大な計算リソースとデータが必要であり、自社モデルのみに限定される

路線其二(水平埋め込み):evermindのMSA(Multi-Scale Attention)は主要モデルの上にメモリレイヤーを追加。

- あらゆるモデルに対応、再訓練不要

- ただし性能の上限はホストモデル自身のアテンションメカニズム互換性に依存

コミュニティの指摘は核心を突いている。「12Mコンテキストに2900万ドル——業界全体がスパースアテンションこそがデンスアテンションの解決策であると信じ始めたことの証だ。」

なぜスパースアテンションなのか

この議論を理解するには、まず問題そのものに戻ろう。

従来のTransformerデンスアテンションは、長コンテキストシナリオにおいて2つの硬性約に直面する:

- O(n²)の計算量——コンテキストが2倍になれば計算量は4倍

- KVキャッシュのメモリ爆発——1200万トークンのKVキャッシュには数百GBのVRAMが必要

デンスアテンションは128K以下では問題なく動作するが、100万トークンを超えるとコストもレイテンシも許容範囲を超えてしまう。

スパースアテンションの核心アイデアはこうだ:すべてのトークンがすべてのトークンにとって重要なわけではない。 アテンションを選択的に計算することで、精度を維持しつつ計算量をほぼ線形に抑えられる。

2つの路線を拆解する

SubQ:モデルを再訓練する

SubQは最もアグレッシブな道を選んだ——1200万トークンコンテキストをネイティブにサポートするモデルをゼロから訓練する。

- メリット:アテンションメカニズムを長コンテキスト向けにエンドツーエンドで最適化可能、後方互換性は不要

- デメリット:モデル訓練の世界で2900万ドルは決して大きくない——エラーの余地は極めて狭い

- リスク:訓練途中でアーキテクチャに問題が発覚した場合、埋没コストは甚大

注目すべきは、SubQのAPIは自社プロダクトと深く結合している点だ。「モデル・アズ・ア・サービス」路線である。

evermind MSA:主要モデルにメモリを追加

evermindのMulti-Scale Attentionは別の道を選んだ——モデル重みに手を加えず、推論時に外部メモリレイヤーを接続する。

- メリット:Claude、GPT、Geminiなどの主要モデルと互換性があり、クライアントはモデルプロバイダーを切り替える必要がない

- デメリット:性能の上限はホストモデルに制限される。本質的には「パッチ」ソリューション

- リスク:主要モデル自身が長コンテキスト機能を追加した場合、MSAの差別化価値は浸食される

業界シグナル

この資金調達ラウンドはいくつかの注目すべきシグナルを示している:

- スパースアテンションが学術概念から商業トラックへ移行しつつある——投資家は「より大きなモデル」ではなく「アテンションメカニズムのイノベーション」に対価を払う用意がある

- 12Mコンテキストが新たなベンチマークになりつつある——それ以前は、100万トークン(Claude)と200万トークン(Gemini)が公開上限だった。1200万はその桁違いの飛躍

- まだ勝者は決まっていない——CNN対Transformerの物語と同様、初期の複数路線並行は健全である

開発者への影響

| ユースケース | 推奨路線 | 理由 |

|---|---|---|

| 極端な長コンテキスト性能が必要 | SubQ(訓練が成功すれば) | ネイティブスパースアテンション、エンドツーエンド最適化 |

| 既存モデル+長メモリを使いたい | evermind MSA | モデル切替不要、プラグアンドプレイ |

| コスト重視 | 様子見 | 両路線とも初期段階、価格はまだ不透明 |

結論

2900万ドルは決して巨額ではないが、それは一つの転換点を示している。AIインフラ競争の次元が下方にシフトしつつあるのだ——「誰のモデルパラメータがより大きいか」から「誰のアテンションメカニズムがより賢いか」へ。

スパースアテンションは本当にデンスアテンションの究極の解決策なのか。答えはまだここにはないが、この資金調達ラウンドが少なくとも証明しているのは:本物のお金を賭ける者が現れたということだ。