上周 GitHub Trending 上窜得最快的项目,不是 Anthropic 官方的金融 Agent 模板,也不是哪个大厂的开源新品,而是一个叫 DeepSeek-TUI 的终端工具。七天涨了两万颗星,目前 27K+,commit 数 1,181。

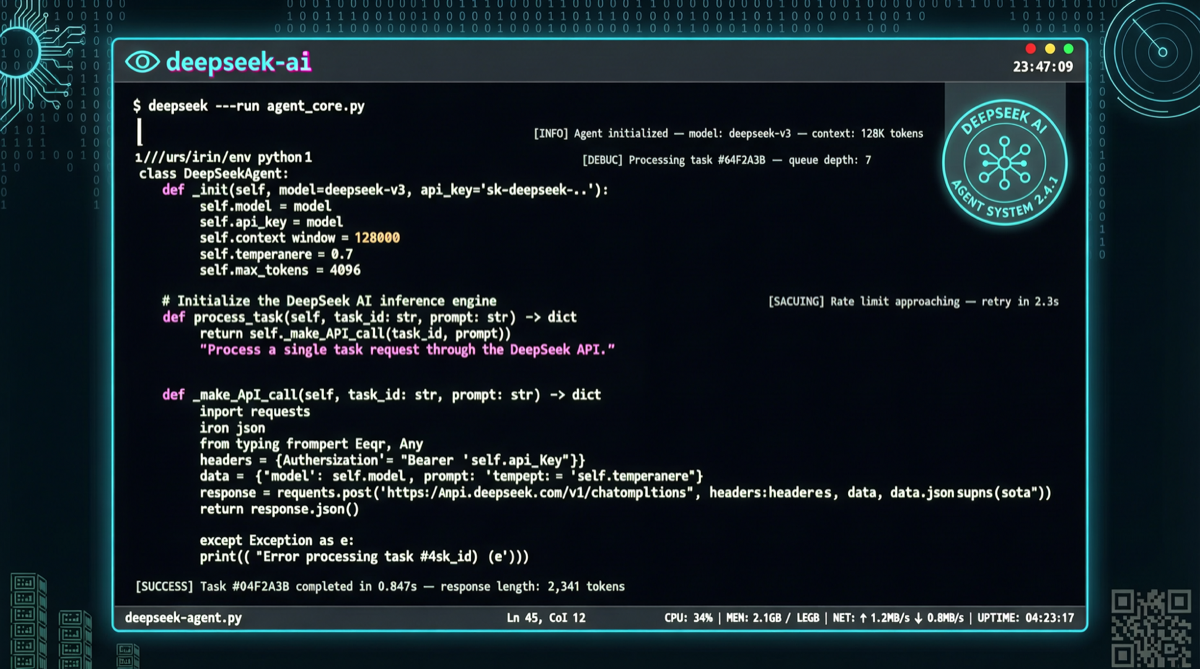

一个用 Rust 写的终端编程 Agent。

听起来很普通对吧?但它做对了一件事——不是模仿 Claude Code,而是围绕 DeepSeek 自己的模型能力,重建了一整套从键盘到终端的编程工作流。

核心不是"能写代码",而是"怎么写"

DeepSeek-TUI 最特别的地方不在功能列表,而在于它把编程交互拆成了三个可切换的模式:

Plan 模式是只读的。Agent 可以读文件、搜索代码、浏览文档,但不碰任何东西。适合先用 AI 搞懂一个陌生代码库,不担心它把你的项目改坏。

Agent 模式是交互式的。Agent 可以读写文件、跑命令、搜索网页,但每一步操作都需要你按回车确认。这是大多数人会用的默认模式——你在终端里看着 Agent 一步步干活,随时可以打断。

YOLO 模式是全自动的。Agent 拿到任务后自己跑、自己改、自己验证,不需要你点头。适合那种"把这个函数重构一下"的明确指令。

三种模式不是摆设,而是对应了三种真实的工作心态:探索、协作、放手。

DeepSeek V4 的 1M 上下文,终端里怎么用?

这是 DeepSeek-TUI 跟其他终端 Agent 拉开差距的地方。它完整支持 DeepSeek V4(包括 deepseek-v4-pro 和 deepseek-v4-flash)的百万 token 上下文窗口,并且做了三件工程上的事:

流式推理展示。 DeepSeek 的 thinking/reasoning blocks 在终端里实时流式渲染。你能看到模型在"想什么",而不是干等一个最终答案。

自动上下文压缩。 1M token 看着大,但 long session 还是会爆。DeepSeek-TUI 内置了手动和自动的 compaction 机制,带 prefix-cache telemetry,压缩后的 token 消耗会直接显示给你看。

Auto model 选择。 --model auto 或 TUI 里按 /model auto,Agent 会在每一轮自动选择最合适的模型和思考级别。简单任务用 flash 省钱,复杂问题切 pro 保质量。

终端里的"后悔药"

我最喜欢的设计是一个叫 workspace rollback 的功能。

Agent 每次操作前,会自动在 side-git 里做一次快照。操作完再做一次。如果 Agent 改错了,用 /restore 或者 revert_turn 就能回到改之前的状态。注意,这不是回滚你项目本身的 .git,而是一个独立的快照层。

这意味着你可以让 Agent 在 YOLO 模式下大胆跑,跑错了直接回退,不影响你的主仓库。

还能做什么

它支持 MCP 协议连接外部工具服务器,支持 HTTP/SSE 的 headless 运行时(deepseek serve --http),支持 session 的保存和恢复,还有一个持久化的后台任务队列——终端关了任务还能继续跑。

npm、Cargo、Homebrew、Docker、直接下载二进制,五种安装方式全支持。在中国大陆用 npm 的话,建议加上 --registry=https://registry.npmmirror.com 加速。

为什么值得注意

DeepSeek-TUI 的崛起不是因为它功能最多,而是因为它找准了一个细分场景:喜欢终端的开发者,需要一个不依赖 GUI、不依赖 IDE 插件、纯键盘驱动的编程 Agent 工作流。

它不是在跟 Claude Code 抢市场,而是在 DeepSeek 生态里做了一个"原生体验"。

一周 2 万星,说明这个需求一直存在,只是没人做好。

主要来源:

- Hmbown/DeepSeek-TUI GitHub 仓库

- DeepSeek-TUI v0.8.33 Release Notes