核心结论

Claude Opus 4.7 完成了一项此前被认为需要人类研究者才能完成的任务:从零实现 AlphaZero 风格的自博弈管线。

- 在消费级硬件上仅用 3 小时完成实现

- 在 Connect Four(四子棋)游戏中以先手身份 7/8 击败了 Pascal Pons 专业 solver

- 其他参与测试的前沿 Coding Agent 均未超过 2/8

这不是一个”AI 会下棋”的演示,而是一个 Agent 自主研究 → 实现算法 → 训练模型 → 验证结果 的端到端闭环。

实验详情

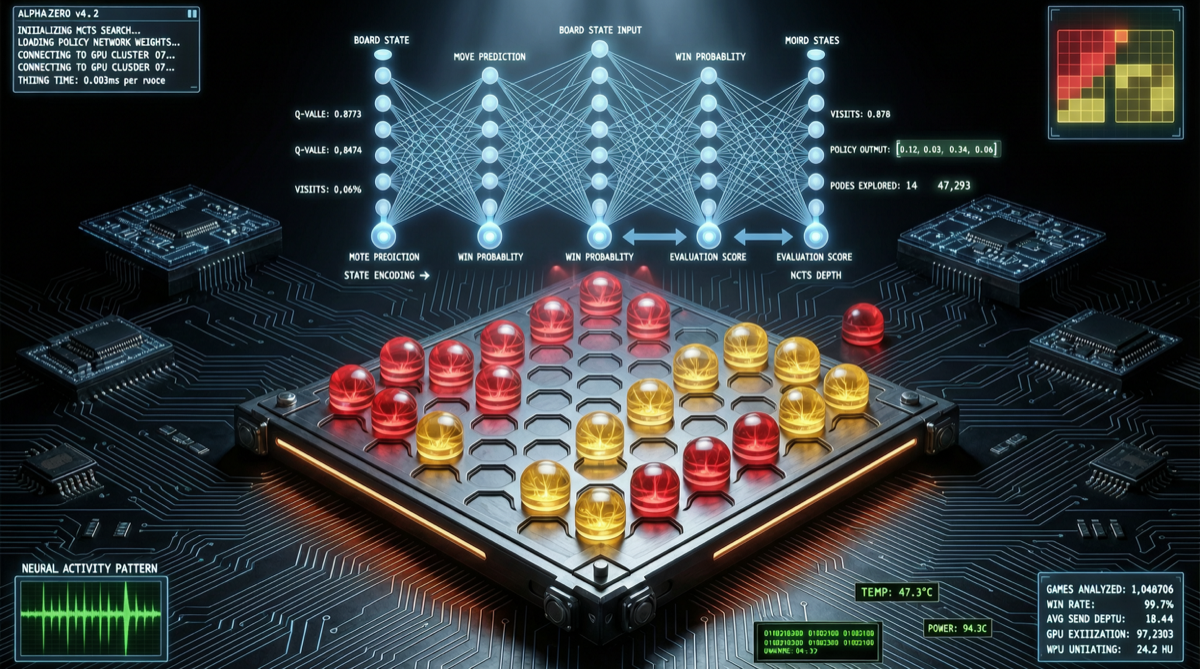

任务:实现 AlphaZero 风格的自博弈强化学习管线,从零开始训练一个 Connect Four 棋手。

AlphaZero 方法的核心:

- 不依赖人类棋谱,完全通过自我对弈学习

- 使用 MCTS(蒙特卡洛树搜索)+ 神经网络评估局面

- 自举迭代:更好的模型 → 更强的对手 → 更好的训练数据 → 更好的模型

Claude Opus 4.7 的表现:

- 在 3 小时内完成了从算法理解、代码编写、调试到训练的完整流程

- 作为先手(first-mover)在 8 局中对 Pascal Pons solver 取得 7 胜

- Pascal Pons solver 是一个经过数学证明的完美 solver,理论上不会输——Claude 的胜利意味着它在先手优势下找到了最优策略

对比结果:

| Agent | Connect Four 胜率 (vs Pascal Pons) | 完成时间 |

|---|---|---|

| Claude Opus 4.7 | 7/8 (先手) | 3 小时 |

| 其他前沿 Coding Agent | ≤ 2/8 | 未在规定时间内完成 |

为什么这个结果重要

1. 自主研究能力

AlphaZero 的实现涉及多个领域的交叉知识:强化学习、蒙特卡洛搜索、神经网络训练、博弈论。Claude Opus 4.7 不仅”写代码”,还展示了理解复杂算法 → 自主实现 → 调试优化的研究能力。

2. 与传统 Coding Agent 的差距

其他 Coding Agent 在相同任务上最高仅达到 2/8 的胜率,差距显著。这说明 Coding Agent 之间的能力分化已经出现——有些能处理端到端的研究型任务,有些仍停留在代码补全和简单重构层面。

3. 消费级硬件的可行性

实验在消费级硬件上完成,而非云端 GPU 集群。这意味着 AlphaZero 级别的自博弈训练正在从”需要百万美元算力”走向”个人开发者也能玩”的阶段。

对 Agent 生态的影响

这个实验结果与 Anthropic CEO Amodei “编程将最先消失”的声明形成了一个有趣的对照:

- Amodei 说的是宏观趋势

- AlphaZero 实验是微观证据——Claude Opus 4.7 已经能自主完成一个需要多领域知识的研究项目

但同时也需要清醒认识:

- Connect Four 是一个完全信息、有限状态的博弈游戏,复杂度远低于真实软件工程

- 89% 的 AI Agent 在生产环境中失败的行业数据提醒我们,demo 能力和生产可用性之间存在巨大鸿沟

- 自博弈管线的实现质量、可维护性、可扩展性等工程维度的评估仍然缺失

行动建议

- 研究者:关注自博弈方法在其他领域(如优化问题、程序合成)的迁移可能性

- Agent 开发者:Claude Opus 4.7 展示了”研究型 Agent”的能力上限,可以作为对标基准

- 投资人:具备自主研究和端到端交付能力的 Agent 平台可能形成新的技术护城河

- 普通用户:短期无需恐慌——这个实验展示的是 Claude 在特定研究型任务上的能力,不等于通用软件工程能力

Claude Opus 4.7 的 AlphaZero 实验是一个信号,但不是终局。它证明了前沿 Coding Agent 正在跨越从”代码生成器”到”自主研究者”的分水岭。下一步的关键问题是:这种能力能否迁移到更复杂的、不完全信息的真实工程场景中?