一个反直觉的观点

当前几乎所有 AI Agent 的记忆系统都在做同一件事:尽可能准确地把经验压缩成摘要存起来。

这篇论文的作者们说:方向错了。

他们提出一个核心论点——Agent 的记忆不应该是"过去的描述",而应该是"决策的区分器"。换句话说,记忆的价值不在于它忠实地描述了发生了什么,而在于它保留了那些必须被区分的不同历史状态,以便 Agent 在有限的内存预算下做出好的决策。

从信息论到 Agent 记忆

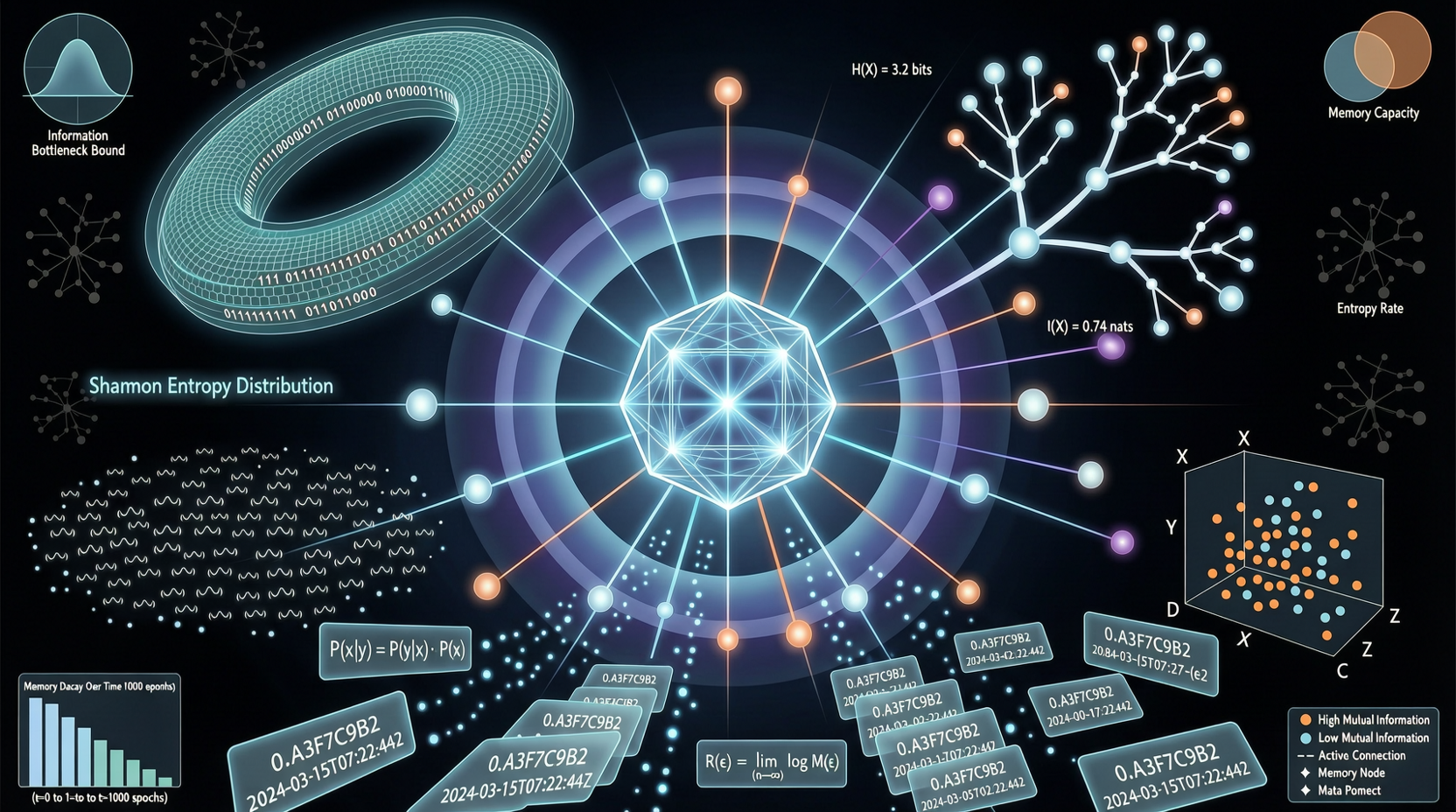

作者借用了信息论中的率失真理论(Rate-Distortion Theory)——这个理论原本是研究"在给定比特率下,信号能压缩到什么程度而不失真"。

套用到 Agent 记忆上:

- 率(Rate) = 内存预算(你能存多少东西)

- 失真(Distortion) = 决策质量的损失(因为遗忘而做出的次优决策)

这个框架导出了两个关键结论:

1. 精确的遗忘边界

在给定内存预算下,可以数学上确定哪些信息可以安全遗忘,哪些必须保留。不是基于"相关性"或"显著性"这些模糊标准,而是基于"遗忘这条信息会不会导致决策冲突"。

2. 记忆-失真前沿

存在一个最优的 trade-off 曲线,描述内存预算和决策质量之间的关系。在这条曲线上的点是 Pareto 最优的——你不可能在不增加内存的情况下提高决策质量,也不可能在保持决策质量的情况下减少内存。

DeMem:从理论到实现

基于这个框架,作者提出了 DeMem(Decision-centric Memory),一个在线记忆学习器。核心机制是:

只有当数据证明共享一个记忆状态会导致决策冲突时,才细化记忆分区。

翻译成人话:不要预先把所有经验都存得很详细,而是"懒加载"——只在发现"这两件事看起来像但需要不同处理方式"的时候,才把它们区分开。

这和我们人类的记忆方式有微妙的相似之处。你不会记住每天通勤的每一个细节,但如果某天路上发生了特殊事件(事故、偶遇),你就会记住那天的路线——因为"那天和平时不一样,需要区别对待"。

实验结果

论文在两个场景验证了 DeMem:

- 受控合成诊断:在人工设计的测试环境中,DeMem 在相同内存预算下优于基线

- 长程对话 benchmark:在需要多轮记忆的真实对话场景中,DeMem 带来了一致的收益

具体的提升幅度论文中有详细数据,但核心信息是:不是 marginally better,而是 consistent gains under the same runtime budget。

这对 Agent 开发意味着什么

目前主流的 Agent 记忆方案——无论是 LangChain 的 conversation buffer、向量数据库里的经验存储,还是各种 summary 策略——都是"描述导向"的。它们假设记忆的目标是 faithfully represent the past。

DeMem 提出了一个不同的范式:记忆的目标是 support good decisions under memory constraints。

如果这个范式被广泛接受,整个 Agent 记忆基础设施的设计思路都可能需要调整。

作者阵容

论文作者包括来自 Monash University(Zenglin Xu, Lizhen Qu)、CUHK(Irwin King)和字节跳动/其他机构的学者。这个组合说明研究既有学术深度,也有工业界视角。

冷静看待

理论很漂亮,但有几个问题需要后续研究回答:

- DeMem 在更复杂的真实场景(比如多工具调用的 Agent、网页浏览 Agent)中的表现如何?

- 决策冲突的检测成本本身有多大?如果检测机制太重,可能会抵消记忆精简带来的收益。

- 有没有开源实现?论文中没有提到代码发布计划。

一句话

"记住决策,而不是描述"——这个原则如果成立,可能会成为 Agent 记忆系统设计的一个分水岭。

主要来源:

- arXiv:2605.10870 - DeMem

- 作者:Mingxi Zou, Zhihan Guo, Langzhang Liang, Zhuo Wang, Qifan Wang, Qingsong Wen, Irwin King, Lizhen Qu, Zenglin Xu