核心结论

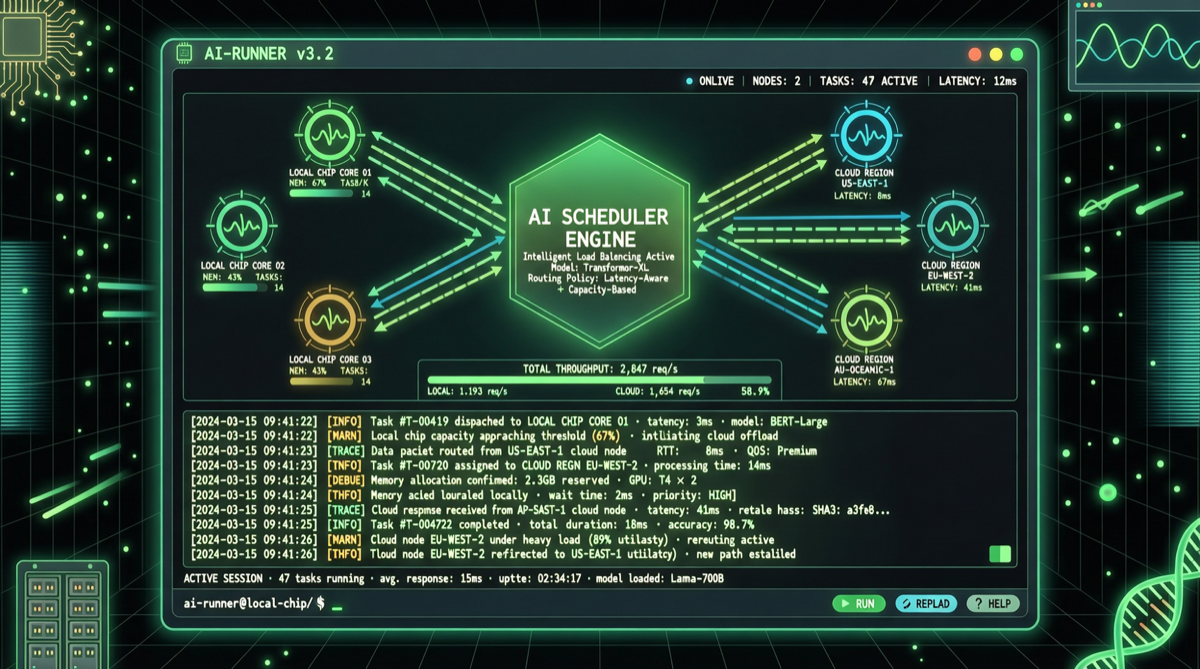

Google 在 4 月底发布 Gemini CLI v0.40.0,新增了对本地 Gemma 模型的智能路由支持。这不是一个简单的功能更新,而是一套完整的本地+云端混合 AI 架构策略:简单任务由本地 Gemma 免费处理,复杂任务自动路由到云端 Gemini 付费 API。

架构拆解

Gemini CLI v0.40 的智能路由逻辑:

用户输入 → 任务复杂度评估

↓

┌────┴────┐

简单任务 复杂任务

↓ ↓

本地 Gemma 云端 Gemini

(免费/零延迟) (更强能力)

↓ ↓

直接返回 返回结果实际体验影响:

| 场景 | 处理路径 | 成本 | 延迟 |

|---|---|---|---|

| 文件读取/搜索 | 本地 Gemma | 免费 | < 1s |

| 简单代码补全 | 本地 Gemma | 免费 | < 1s |

| 复杂代码重构 | 云端 Gemini | API 费用 | 2-5s |

| 多步推理任务 | 云端 Gemini | API 费用 | 5-10s |

| 长文档分析 | 云端 Gemini | API 费用 | 10s+ |

为什么这很重要

1. 成本结构革命

对于日常使用 CLI 的开发者,大部分交互其实是简单任务:查看文件、搜索代码、简单的代码补全。这些任务如果每次都调用云端 API,月度费用可能达到数百美元。本地 Gemma 处理后,云端 API 调用量预计可减少 60-80%。

2. 隐私与合规

本地处理意味着代码和文件内容不会离开开发者的机器。对于需要处理敏感代码(企业内部代码、合规数据)的团队,这是一个关键卖点。

3. 离线可用

断网状态下,本地 Gemma 仍然可以提供基础的 AI 辅助能力,这对远程开发和网络不稳定场景非常实用。

与竞品对比

| 工具 | 本地模型支持 | 智能路由 | 免费额度 | 开源 |

|---|---|---|---|---|

| Gemini CLI v0.40 | ✅ Gemma | ✅ 自动路由 | 本地免费 | ❌ |

| Claude Code | ❌ | ❌ | 有限 | ❌ |

| Cursor | 部分支持 | ❌ | 有限 | ❌ |

| OpenClaw | ✅ 完全本地 | ✅ 可配置 | 完全免费 | ✅ |

| Continue | ✅ 多模型 | ✅ 可配置 | 取决于模型 | ✅ |

Google 的差异化在于:它用智能路由将本地和云端无缝衔接,用户不需要手动切换模型。

上手步骤

# 安装/更新 Gemini CLI

npm install -g @google/gemini-cli

# 下载本地 Gemma 模型(首次使用)

gemini setup-local-model

# 配置路由规则(可选)

gemini config set routing-strategy auto

# 验证路由状态

gemini status

# 应显示:Local Gemma: Ready | Cloud Gemini: Connected硬件要求

| 模型 | 显存/内存 | 推荐配置 |

|---|---|---|

| Gemma 3 1B | 2GB RAM | 任意现代笔记本 |

| Gemma 3 4B | 4GB RAM | 8GB RAM 以上设备 |

| Gemma 3 12B | 12GB VRAM | 带独立显卡的台式机 |

大多数开发者的日常笔记本即可运行 Gemma 3 4B,足以覆盖简单任务场景。

行动建议

- 重度 CLI 用户:立即升级到 v0.40,本地 Gemma 可以大幅降低月度 API 费用。

- 隐私敏感团队:利用本地 Gemma 处理所有日常任务,仅将需要深度分析的任务发送到云端。

- AI 工具选型者:将 Gemini CLI 的智能路由能力纳入评估标准——未来的 AI 工具不只是”哪个模型更强”,而是”哪个工具的路由策略更省钱”。

Gemini CLI v0.40 的本地 Gemma 支持,是 Google 在 AI 工具赛道上的一步精准棋:用免费本地模型锁定用户入口,用云端模型提供增值能力。