智谱的 GLM-5V-Turbo 之前已经在 design-to-code 场景里出现过,但当时没人拿到完整的技术报告。今天这份报告把底牌翻出来了。

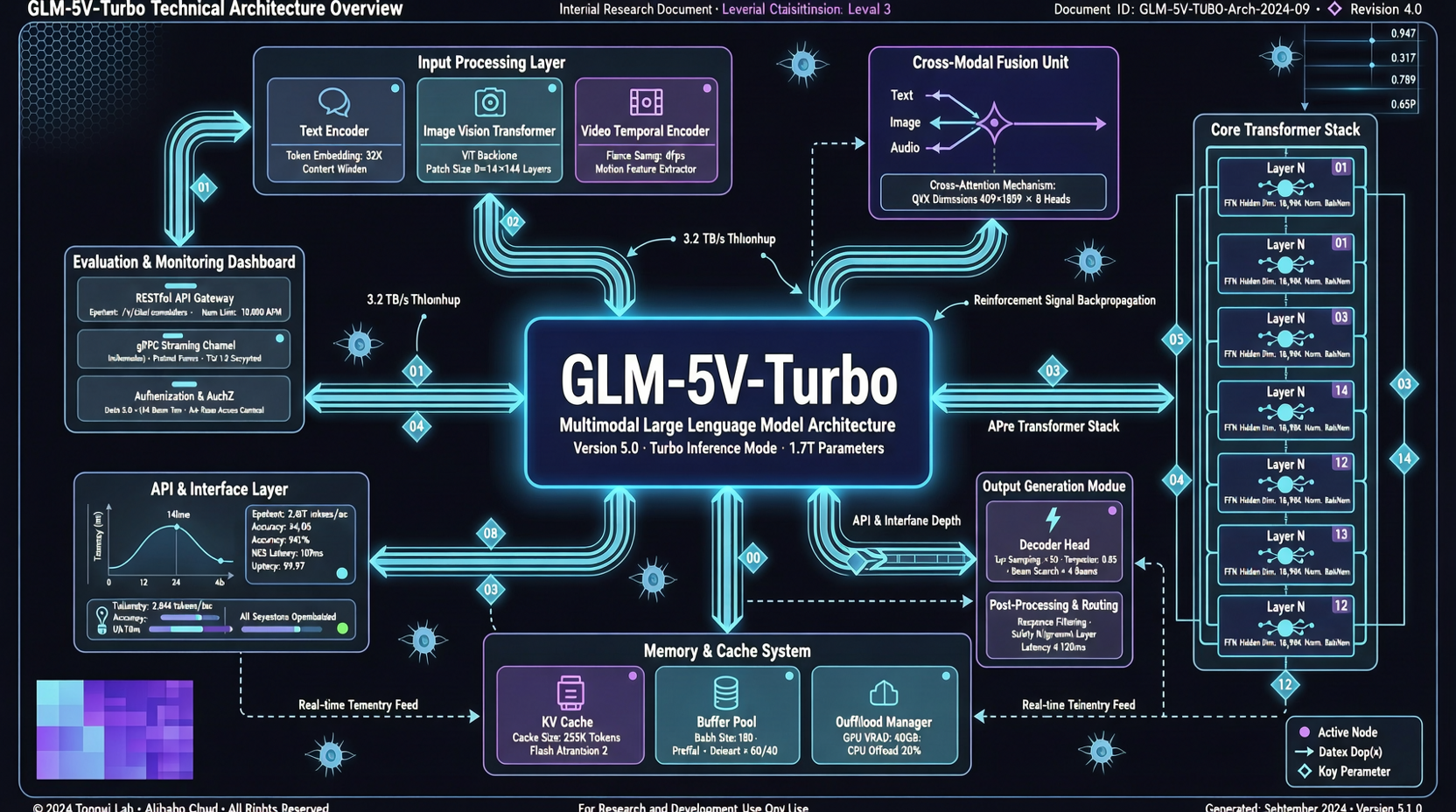

核心就一句话:他们在做一个原生支持多模态 Agent 的基础模型,而不是给语言模型套个视觉外壳。

感知-规划-执行的闭环

报告里最值得关注的是工具链的设计。GLM-5V-Turbo 把搜索、裁剪、标注、网页阅读这些多模态工具串在了一个闭环里:模型先感知输入,然后规划要调用哪些工具,最后执行。

这不是简单的 function calling。function calling 是"你说做什么我就做什么",这个闭环是"我自己判断需要用什么工具、用几次、按什么顺序"。

区别在于,前者需要人设计好调用逻辑,后者模型自己决定。

和 Claude Code、OpenClaw 的集成

报告特别提到,GLM-5V-Turbo 可以集成到 Claude Code 和 OpenClaw 中作为视觉理解模块。这意味着智谱在定位上,把自家模型当成了 Agent 生态里的一个可插拔组件。

这个思路挺务实的。不是每个人都要从零搭 Agent 框架,把视觉能力嵌入已有的工具链,反而更容易落地。

强化学习的角色

技术报告里强化学习的篇幅不小。多模态 Agent 的 RL 训练比纯文本难很多——奖励信号要从视觉、文本、工具调用结果三个维度来设计。智谱在这个方向上投入的时间比同行早。

不过报告里没有给出具体的 benchmark 数字,至少公开版本没有。这有点遗憾,因为多模态 Agent 这个赛道还缺权威的横向对比。

边界在哪里

GLM-5V-Turbo 的亮点在工具链集成和 Agent 框架适配,但如果你的需求是纯文本代码生成或中文写作,它未必比同价位的纯文本模型有优势。

多模态 Agent 模型的溢价在于"能看懂又能操作"。如果你只需要"看懂"或只需要"操作",可能不需要为另一个能力买单。

主要来源: