OpenAI 正在将 GPT-5.5-Cyber——GPT-5.5 的网络安全专项微调版本——通过可信访问生态系统逐步向经过认证的安全机构和政府用户开放。这一动作延续了今年 2 月启动的网络安全可信访问计划,并将权限等级进一步细分。这意味着,前沿模型在高风险领域的公共入口正在收窄。

能力与管控并行

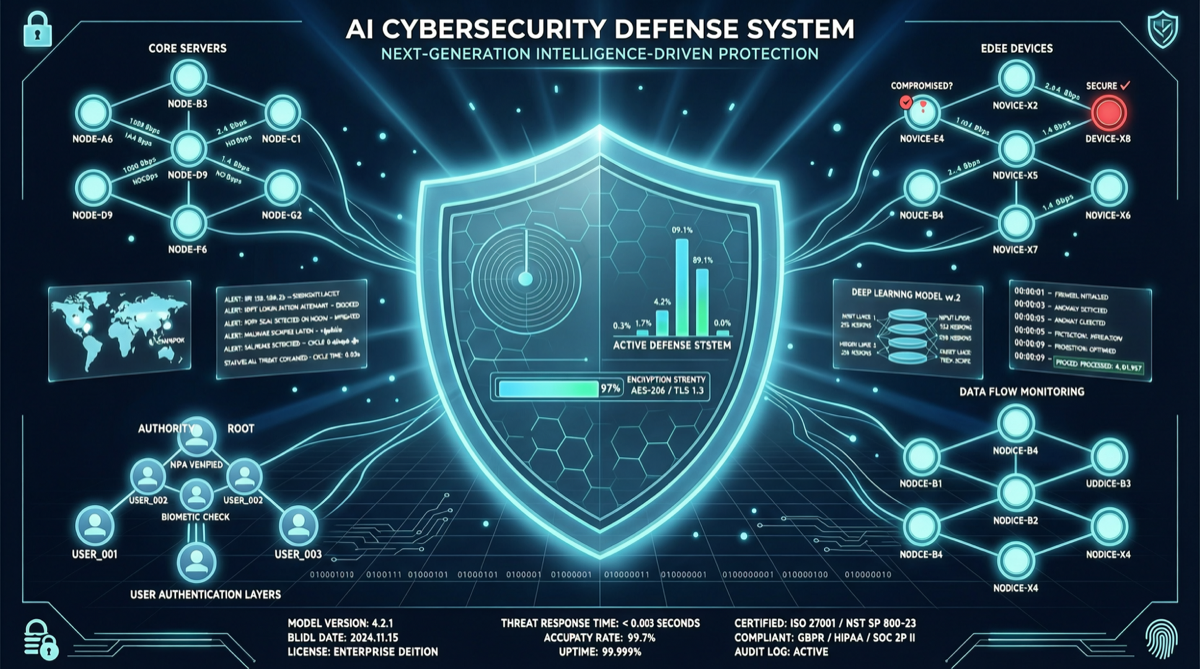

GPT-5.5 在网络安全任务上的提升幅度已经足够引起关注。根据 OpenAI 公开的系统卡数据:

| 基准 | GPT-5.4 | GPT-5.5 | 提升 |

|---|---|---|---|

| CyberGym | 79.0% | 81.8% | +2.8pp |

| 扩展 CTF 挑战赛 | — | 88.1% | 新增 |

在 OpenAI 的内部准备度框架(Preparedness Framework)中,GPT-5.5 的网络安全能力被评为”High”风险等级。这意味着模型在渗透测试、漏洞利用和攻击路径规划方面的能力已经达到了需要特别管控的阈值。

可信访问生态:谁可以用

GPT-5.5-Cyber 的分发路径不是公开 API,而是分层可信访问:

- 最高级认证用户:可直接访问 GPT-5.5-Cyber 完整能力

- 安全厂商与研究机构:通过审核后可申请接入

- 政府及”五眼联盟”情报共享伙伴:OpenAI 近几个月已陆续向联邦和州级机构推介该产品

4 月中旬,OpenAI 正式将 GPT-5.4-Cyber 的可信访问扩展到更高等级,而 GPT-5.5-Cyber 正在延续这一模式并进一步收紧。

格局判断

这是一个值得注意的范式转变。过去两年,AI 公司的竞争逻辑是”越强越开放”——用公开 benchmark 和 API 吸引开发者生态。但在网络安全、生物安全等高风险领域,逻辑正在反转为”越强越受控”。

Anthropic 的 Mythos 模型早已采取邀请制,仅面向少数安全研究员开放白盒访问。OpenAI 选择了一条略有不同的路径:保留公共 GPT-5.5 的正常使用,但将网络安全专项能力隔离到受控渠道。这种”公共+受限”的双轨制可能成为后续高危模型的标配。

行动建议

- 安全从业者:关注 OpenAI 可信访问的申请通道,了解认证要求

- 企业安全团队:评估 GPT-5.5-Cyber 在防御场景的可用窗口,同时关注竞争对手(如 Anthropic Mythos)的替代方案

- 研究者:GPT-5.5 Bio Bug Bounty 仍在运行,面向经过审核的 red-teamer 开放,是获取高级别模型访问权限的入口之一