结论先行

lambda/hermes-agent-reasoning-traces 数据集的发布可能是 2026 年 AI Agent 领域最重要的基础设施更新之一。它首次让开发者和研究者能够大规模地观察、分析和优化 AI Agent 的推理过程。

在此之前,Agent 调试基本靠”看日志、猜原因”。现在,有了标准化的推理轨迹数据集和分析工具链,Agent 开发正在从”手艺活”走向”工程化”。

发生了什么

数据集内容

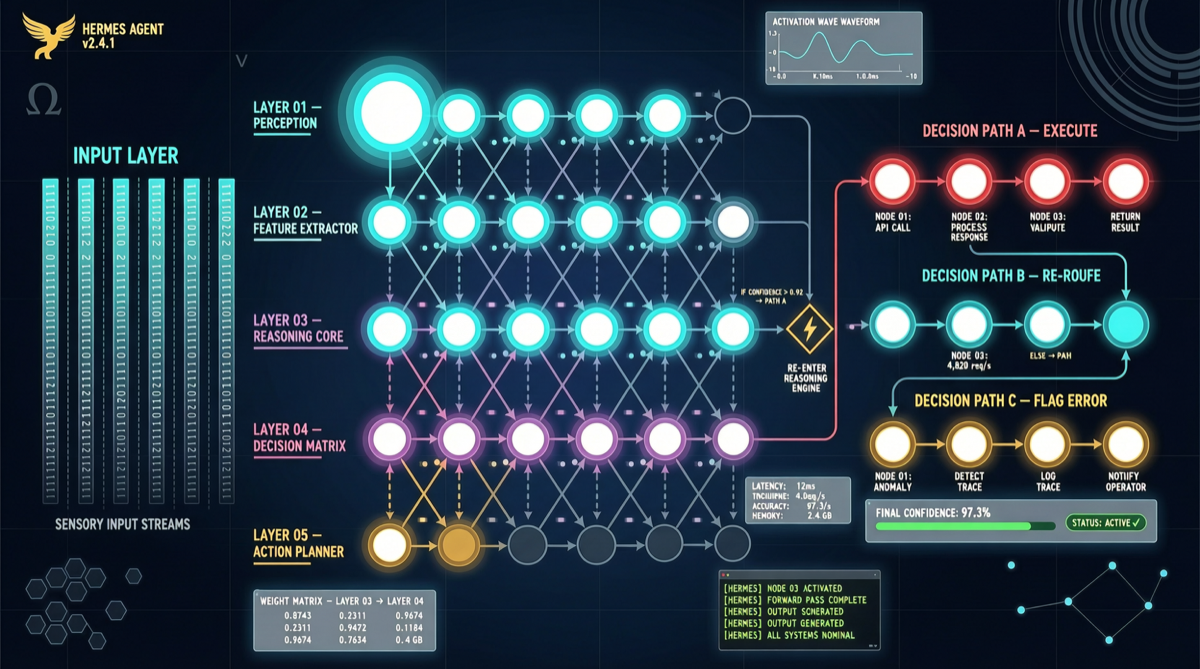

该数据集基于 Hermes Agent 的运行数据,包含 Agent 在处理各种任务时的完整推理轨迹:

每条推理轨迹包含:

├── 用户输入(任务描述)

├── Agent 的思考过程(reasoning steps)

├── 工具调用序列(tool calls)

│ ├── 调用参数

│ ├── 返回结果

│ └── Agent 对结果的理解

├── 中间决策点(decision points)

│ ├── 备选方案

│ ├── 选择理由

│ └── 被排除方案的评估

├── 最终输出

└── 执行结果评估(成功/失败/部分成功)配套工具链

数据集不只是”一堆 JSON 文件”,而是附带了完整的分析工具链:

| 工具 | 功能 | 输出 |

|---|---|---|

| 解析器(Parser) | 将原始轨迹转为结构化数据 | 标准化的推理步骤序列 |

| 分析器(Analyzer) | 识别推理模式和常见错误 | 统计报告 + 模式分类 |

| 可视化工具(Visualizer) | 将推理过程转为图形 | 决策树 / 流程图 |

| 微调管线(Fine-Tuning) | 用轨迹数据优化模型 | 改进的推理策略 |

配套 Jupyter Notebook 包含完整的代码示例,用户可以直接运行并分析数据。

为什么重要

1. Agent 调试终于有了”数据基础”

过去调试 Agent 的方式:

Agent 出错了 → 看日志 → 猜哪里出了问题 → 改 prompt → 重试 → 再猜有了推理轨迹数据集后:

Agent 出错了 → 查轨迹数据集 → 找到相似案例 → 分析失败模式 → 针对性优化这类似于软件开发从”print 调试”到”专业 profiler”的演进。

2. 推理质量可以量化和比较

通过标准化轨迹数据,研究者现在可以:

- 测量推理深度:Agent 平均进行多少步推理?

- 识别推理缺陷:哪些类型的任务容易导致推理崩溃?

- 比较不同模型:同一任务,不同模型的推理路径有何差异?

- 追踪改进效果:Prompt 优化后,推理轨迹发生了什么变化?

3. 微调 Agent 推理策略成为可能

数据集附带了微调管线,意味着你可以:

- 用高质量推理轨迹”教”Agent 更好的推理方式

- 针对特定任务域微调推理策略

- 让 Agent 学习从失败中改进的方法

这是 Agent 自我改进的基础设施。

数据洞察(初步分析)

基于已公开的数据集样本,一些值得关注的模式:

推理步数分布

简单任务(代码补全): 3-5 步推理

中等任务(API 集成): 8-15 步推理

复杂任务(系统调试): 20-40+ 步推理常见推理失败模式

| 失败模式 | 占比 | 典型场景 |

|---|---|---|

| 工具调用参数错误 | ~25% | API 参数格式不对 |

| 推理循环(死循环) | ~18% | 同一思路反复尝试 |

| 上下文丢失 | ~15% | 长任务中忘记初始目标 |

| 工具结果误读 | ~20% | 错误理解工具返回 |

| 策略选择错误 | ~12% | 选错了工具或方法 |

| 其他 | ~10% | — |

高表现 Agent 的共同特征

数据集中表现最好的 Agent 轨迹显示出以下模式:

- 明确的分阶段规划:先计划、再执行、最后验证

- 主动的错误检测:在执行过程中持续检查结果的正确性

- 灵活的策略切换:当某条路走不通时,快速切换到备选方案

- 适度的推理深度:不会过度思考简单问题,也不会跳过复杂问题的推理

与 LLM 推理数据的关键区别

很多人可能会问:这和 LLM 的 CoT(思维链)数据有什么区别?

| 维度 | LLM CoT 数据 | Agent 推理轨迹 |

|---|---|---|

| 范围 | 单次推理过程 | 多步骤、多工具、跨会话 |

| 交互 | 纯文本推理 | 包含工具调用和结果反馈 |

| 时间跨度 | 秒级 | 分钟到小时级 |

| 决策类型 | 生成下一个 token | 选择工具、判断结果、调整策略 |

| 可观测性 | 推理即最终输出 | 推理是中间状态,执行是最终输出 |

关键区别:Agent 推理轨迹包含了”与世界的交互”,这是纯 LLM CoT 数据无法提供的。

应用场景

对 Agent 开发者

- 调试加速:通过对比成功和失败的轨迹,快速定位问题

- 性能优化:分析哪些推理步骤可以简化或跳过

- 质量评估:用数据集作为 benchmark 评估 Agent 改进效果

对研究者

- 推理模式研究:Agent 如何组织和执行复杂推理?

- 工具使用学习:Agent 如何学会有效使用工具?

- 错误分析:Agent 推理失败的根因是什么?

对产品经理

- 用户体验优化:哪些推理步骤可以向用户展示以增加透明度?

- 功能规划:数据集中的失败模式指向哪些需要改进的产品功能?

上手指南

快速开始

# 克隆数据集

git clone https://github.com/lambda/hermes-agent-reasoning-traces

# 打开 Jupyter Notebook

cd hermes-agent-reasoning-traces

jupyter notebook analysis.ipynb基础分析示例

# 加载数据集

from reasoning_traces import load_traces, visualize_trace

traces = load_traces("dataset/")

# 查看一个任务的完整推理轨迹

trace = traces[0]

visualize_trace(trace)

# 统计分析

from reasoning_traces.analyzer import ReasoningAnalyzer

analyzer = ReasoningAnalyzer(traces)

report = analyzer.generate_report()

print(report.summary())格局判断

AI Agent 可观测性的进化

2024: 看日志猜原因(原始时代)

2025: 简单的轨迹记录(前可观测时代)

2026: 标准化推理轨迹数据集 + 分析工具 ← 我们现在在这里

2027: 实时推理监控 + 自动根因分析

2028: Agent 自我诊断 + 自我修复这个数据集的发布标志着 AI Agent 领域正在经历从”黑盒”到”白盒”的关键转变。

行动建议

| 角色 | 建议 |

|---|---|

| Hermes Agent 用户 | 下载数据集分析自己的 Agent 行为,找到优化空间 |

| Agent 框架开发者 | 参考此数据集设计自己的推理轨迹标准 |

| AI 研究者 | 利用此数据集开展 Agent 推理模式研究 |

| 企业 Agent 部署者 | 评估是否需要在生产环境中收集类似的推理轨迹数据 |

核心判断:推理轨迹数据之于 Agent,正如日志数据之于传统软件。没有可观测性,就没有工程化。这个数据集为 AI Agent 的工程化迈出了关键一步。