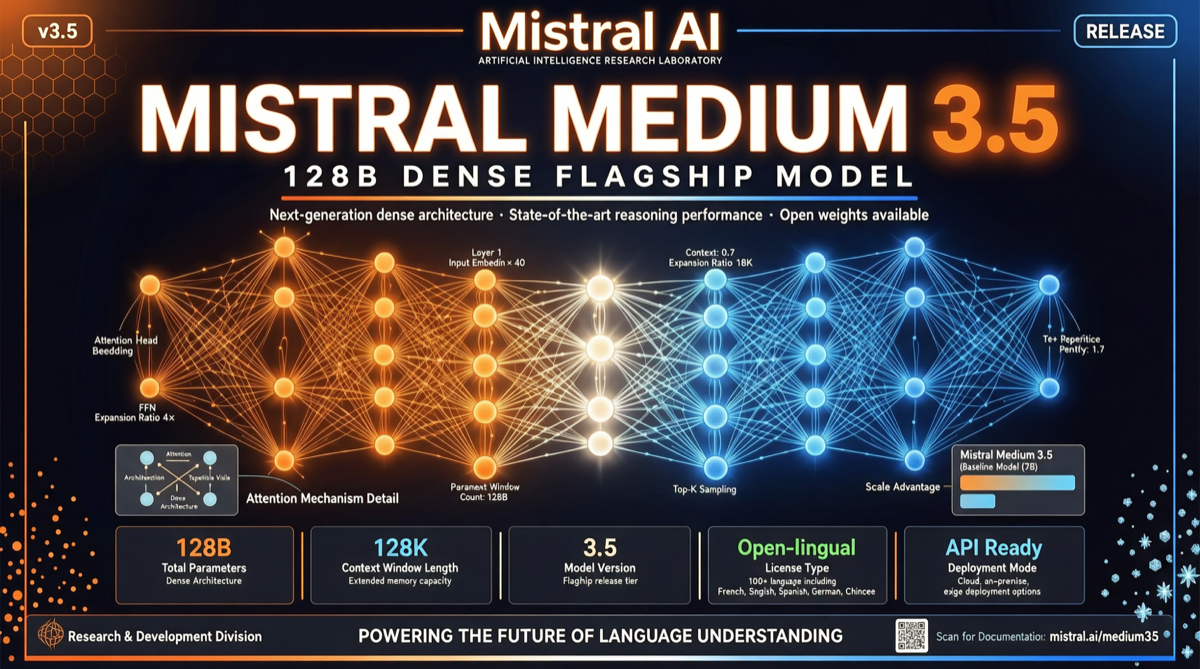

Mistral 于 2026 年 4 月 29 日发布 Mistral Medium 3.5,一款 128B 参数的稠密旗舰模型,同时集成文本和视觉理解能力。这是 Mistral 在中型稠密模型赛道上的最新布局,也是欧洲 AI 公司在 2026 年模型竞争中的一次重要出手。

核心规格

Medium 3.5 的关键参数如下:

| 指标 | 数值 |

|---|---|

| 参数量 | 128B(稠密) |

| 上下文窗口 | 256K tokens |

| 模态 | 文本 + 视觉 |

| 推理模式 | 可配置推理强度 |

| SWE-bench Verified | 77.6% |

| τ³ Telecom | 91.4 |

| 本地运行需求 | 约 64GB RAM |

与同尺寸模型相比,Medium 3.5 在通信行业基准 τ³ Telecom 上达到 91.4 分,在代码修复基准 SWE-bench Verified 上达到 77.6%。这些成绩与 6 倍参数量的模型处于同一梯队。

可配置推理:效率与精度的平衡

Medium 3.5 最值得关注的设计是可配置推理强度。用户可以在调用时指定推理深度,简单任务快速响应,复杂任务自动加强推理。这意味着同一个模型可以同时覆盖低延迟场景和高精度场景,减少了为不同任务部署不同模型的运维成本。

与竞品的横向对比

在同一参数区间,Medium 3.5 的竞争对手主要包括 Qwen3.6-27B(更小但效率突出)和 IBM Granite 4.1-30B(同日发布)。从社区反馈看,Medium 3.5 在代码能力和视觉理解上的综合表现优于 Granite 4.1,但在某些垂直领域基准上 Qwen3.6-27B 仍有优势。

一个值得注意的差异是许可协议:Mistral Medium 3.5 的开源许可为 Mistral Research License(研究许可),而同日发布的 IBM Granite 4.1 采用 Apache 2.0。对于商用部署,Apache 2.0 的约束更少。

本地部署的可行性

Medium 3.5 可以在约 64GB 内存的机器上本地运行(GGUF 格式),这为对数据隐私有要求的团队提供了可行方案。配合 NVIDIA NIM 推理服务,企业可以在自有硬件上部署而无需依赖外部 API。

格局判断

Medium 3.5 的发布说明欧洲 AI 公司正在从”追赶者”向”差异化竞争者”转型——不再追求最大参数,而是聚焦于中型稠密模型的效率和可部署性。这与 Mistral 一贯的”高效开源”路线一致。

对于开发者而言,如果你需要一款可以在本地运行、同时具备视觉理解和代码修复能力的模型,Medium 3.5 值得测试。

主要来源

- Mistral Medium 3.5 官方发布

- Mistral AI Studio

- NVIDIA NIM 部署指南