传统 AI 推理栈有一个致命假设:每次请求都是独立的。但 Agent 时代彻底打破了这个假设。

痛点

Agent 编码会话的典型行为模式:

传统推理假设:

Request 1 → 计算 → Response 1

Request 2 → 计算 → Response 2

Request 3 → 计算 → Response 3

Agent 编码会话的真实行为:

Session: 同一个代码仓库的调试任务

├─ Request 1: 读取文件 A

├─ Request 2: 读取文件 A + 文件 B(重复计算文件 A 的上下文)

├─ Request 3: 运行测试 + 读取文件 A + B + C(又重复计算)

├─ Request 4: 修复代码 + 重新运行测试(继续重复...)

└─ ... 200+ 次调用后,大量 token 预算浪费在重复计算上一个 Agent 编码会话可能产生数百次 API 调用,其中大部分上下文已经在之前的调用中计算过。传统推理栈对这些重复视而不见。

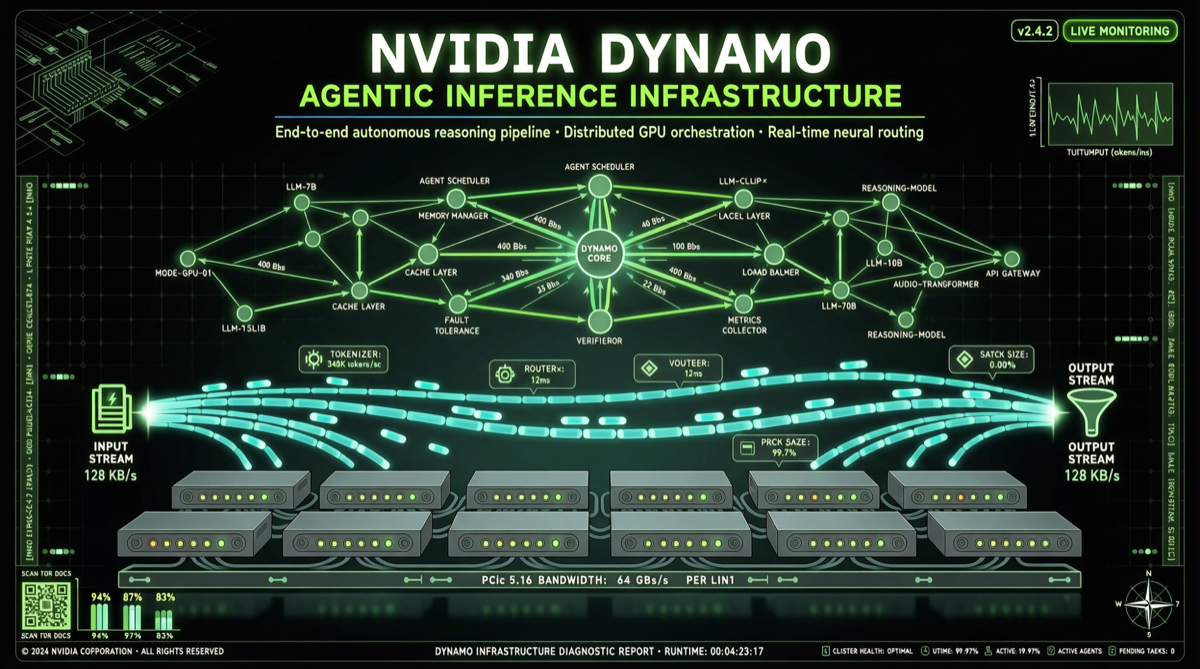

Dynamo 做了什么

核心能力

| 能力 | 解决的问题 | 效果 |

|---|---|---|

| KV 感知路由 | Agent 请求携带大量重叠上下文 | 避免重复计算 KV cache |

| 上下文复用 | 同一会话中的重复 token | 显著降低每 token 成本 |

| 智能调度 | 多个 Agent 并发请求的 GPU 分配 | 提升 GPU 利用率 |

| 分布式推理 | 超大模型跨节点部署 | 降低单次推理延迟 |

2.7 倍性能提升

在 Google Cloud Next 大会上,NVIDIA 团队展示了 Dynamo 如何在同等硅片上实现 2.7 倍性能提升。这不是通过更好的芯片实现的,而是通过:

- 消除 Agent 会话中的冗余 KV cache 计算

- 更智能的请求路由,将具有相似上下文的请求路由到相同的 GPU

- 优化 Agent 场景下的批处理策略

为什么这件事重要

推理成本是 Agent 规模化的瓶颈

Agent 编码工具的 API 收入增长速度远超预期:

- GPT-5.5 发布一周内,Codex 收入翻倍

- API 收入增速是之前任何版本的两倍

- Agent 工具的 token 消耗量是传统聊天应用的 10-100 倍

如果推理成本不能随 Agent 使用量线性扩展,Agent 商业模式的可持续性将受到挑战。Dynamo 是 NVIDIA 对这个问题的一次系统性回应。

重新定义”推理”的含义

传统推理(2023-2025):

输入 → 模型 → 输出

关注点:延迟、吞吐量

Agentic 推理(2026):

输入 → [会话状态 + 上下文历史 + 工具调用] → 模型 → [输出 + 状态更新]

关注点:上下文复用、状态管理、多请求协调Dynamo 是第一个从”Agentic 推理”的假设出发重新设计整个推理栈的项目,而不是在现有架构上打补丁。

与 nvext 的配合

同周发布的 nvext(Full-Stack Optimizations for Agentic Inference with NVIDIA Dynamo)进一步扩展了 Dynamo 的能力:

- 全栈优化:从芯片级到应用级的端到端优化

- 与 Dynamo 深度集成:共享 KV cache 管理和路由策略

- 针对 NVIDIA 硬件定制:利用 TensorRT、CUDA Graph 等底层优化

技术架构

KV 感知路由的工作原理

Agent 请求进入 Dynamo 路由层:

↓

提取请求的 KV cache 签名

↓

┌──────────────┼──────────────┐

↓ ↓ ↓

GPU 1 有匹配的 GPU 2 有匹配 无匹配的 GPU

KV cache KV cache → 选择最优 GPU

↓ ↓ 并创建新 cache

复用 cache 复用 cache

↓ ↓

跳过 KV 计算 跳过 KV 计算这种路由策略在 Agent 场景下特别有效,因为同一 Agent 会话中的连续请求通常有大量重叠的上下文。

与传统推理引擎的对比

| 特性 | vLLM | TensorRT-LLM | NVIDIA Dynamo |

|---|---|---|---|

| KV cache 管理 | 基本 | 优化 | KV 感知路由 |

| Agent 会话优化 | 无 | 无 | 核心设计目标 |

| 上下文复用 | 有限 | 有限 | 原生支持 |

| 多 Agent 调度 | 无 | 无 | 内置 |

| 开源 | ✅ | 部分 | ✅ |

对开发者的影响

降低 Agent 运行成本

对于运行大量 Agent 工作流的团队:

- 直接成本下降:KV cache 复用减少重复计算

- 延迟改善:路由优化减少冷启动时间

- 吞吐量提升:智能批处理提高 GPU 利用率

架构选择的变化

过去:

Agent 框架 → 推理 API(OpenAI/Anthropic)→ 结果

Dynamo 时代:

Agent 框架 → Dynamo 路由层 → 最优推理后端 → 结果

↓

自动选择本地/云端

复用已有 KV cache

智能批处理与国产模型的适配

Dynamo 作为一个开源推理优化层,理论上可以适配任何支持标准 API 的模型:

- Qwen 系列、GLM、DeepSeek 等国产模型可以受益于 Dynamo 的 KV cache 管理

- 对于需要大规模部署国产模型 Agent 的企业,Dynamo 提供了一个通用的推理优化层

- 关注 Dynamo 社区对国产模型适配的进展

竞争格局

推理优化赛道

| 项目 | 公司 | 定位 | 与 Dynamo 差异 |

|---|---|---|---|

| Dynamo | NVIDIA | Agentic 推理全栈优化 | 基准 |

| vLLM | 社区 | 通用推理引擎 | 更通用,缺少 Agent 专用优化 |

| TensorRT-LLM | NVIDIA | GPU 推理优化 | 侧重单模型推理,非 Agent |

| SGLang | 社区 | 推理框架 | 有 KV cache 优化,但非 Agent 专用 |

| SageServe | SageAI | 多模型推理 | 侧重多模型路由 |

NVIDIA 的战略意图

Dynamo 的发布是 NVIDIA 在 AI 推理层的又一次布局:

- 芯片层:GPU(Blackwell、Rubin)

- 互连层:NVLink、Quantum InfiniBand

- 推理层:TensorRT-LLM、Dynamo

- 生态层:CUDA、NGC

通过 Dynamo,NVIDIA 正在确保即使推理工作负载从”单次请求”转向”Agent 会话”,其基础设施仍然是最优选择。

行动建议

如果你在运行 Agent 编码工具

- 评估 Dynamo 对当前推理成本的优化潜力:重点关注 KV cache 命中率

- 测试场景:对比使用 Dynamo 前后,相同 Agent 工作流的 token 消耗和延迟

- 关注开源社区:Dynamo 是开源项目,社区贡献可能快速扩展其对不同模型和框架的支持

如果你在构建 AI 应用

- 将推理优化纳入架构设计:Agent 应用的推理成本模型与传统应用完全不同

- 关注 KV cache 策略:这可能是 Agent 时代最重要的推理优化方向

- 考虑多后端架构:Dynamo 的路由层允许动态选择最优推理后端

如果你在做推理基础设施

- Dynamo 为 Agentic 推理设立了一个新的基准

- 关注 Dynamo 的技术细节:KV 感知路由、上下文复用策略、智能调度算法

- 评估你的推理栈是否已经针对 Agent 场景优化

总结

NVIDIA Dynamo 的意义不在于它做了什么新东西(KV cache 复用、智能路由都不是新概念),而在于第一个把这些优化系统性地组织在”Agentic 推理”的范式下。当 AI 应用从聊天机器人进化为自主 Agent 时,推理基础设施必须随之进化。Dynamo 是 NVIDIA 对这个进化的回答。

对于开发者来说,最直接的信号是:Agent 应用的推理成本还有巨大的优化空间。如果你的 Agent 系统还在用传统推理引擎,你可能正在为重复的 KV cache 计算支付不必要的费用。

主要来源: