OpenAI 在五月初往 API 里塞了三款新的实时语音模型,这件事的音量不大,但信号值得听。

5 月 7 日,OpenAI 官方博客发布了一篇简短的公告:新模型支持推理、翻译和语音转写,目标是让基于语音的软件 Agent 更自然、更能实时完成任务。

VentureBeat 的报道给了一个关键信息:这些模型具备 GPT-5 级别的推理能力,且是实时语音级别的。

变化在哪

之前的语音模型——比如 GPT-4o 的实时语音模式——已经能做到流畅对话了。但"流畅"不等于"聪明"。语音 Agent 的瓶颈不在理解你说的什么,在于它有没有能力在理解的基础上做复杂推理。

举个例子:你用语音让一个 Agent 帮你查航班、比较价格、考虑你的时间安排、然后预订。这个链路里涉及多个步骤的推理和决策。以前的语音模型在这类任务上的表现,用 VentureBeat 的原话说——"changes what voice agents can actually orchestrate"(改变了语音 Agent 真正能编排的东西)。

这三款新模型的定位不是替代 GPT-5 的文本 API,而是在语音通道上提供接近文本模型的推理质量。

三个模型的分工

OpenAI 没有详细列出每款模型的规格,但从描述看,三款模型分别侧重:

- 推理型语音模型:处理需要多步推理的语音任务,比如客服场景中的问题诊断

- 翻译型语音模型:实时语音翻译,延迟是关键指标

- 转写型语音模型:语音到文本的高精度转写,可能面向会议记录和语音搜索场景

这种拆分说明 OpenAI 对语音场景的理解在细化——不再是一个"通用语音模型打天下",而是按用途分化。

对开发者的意义

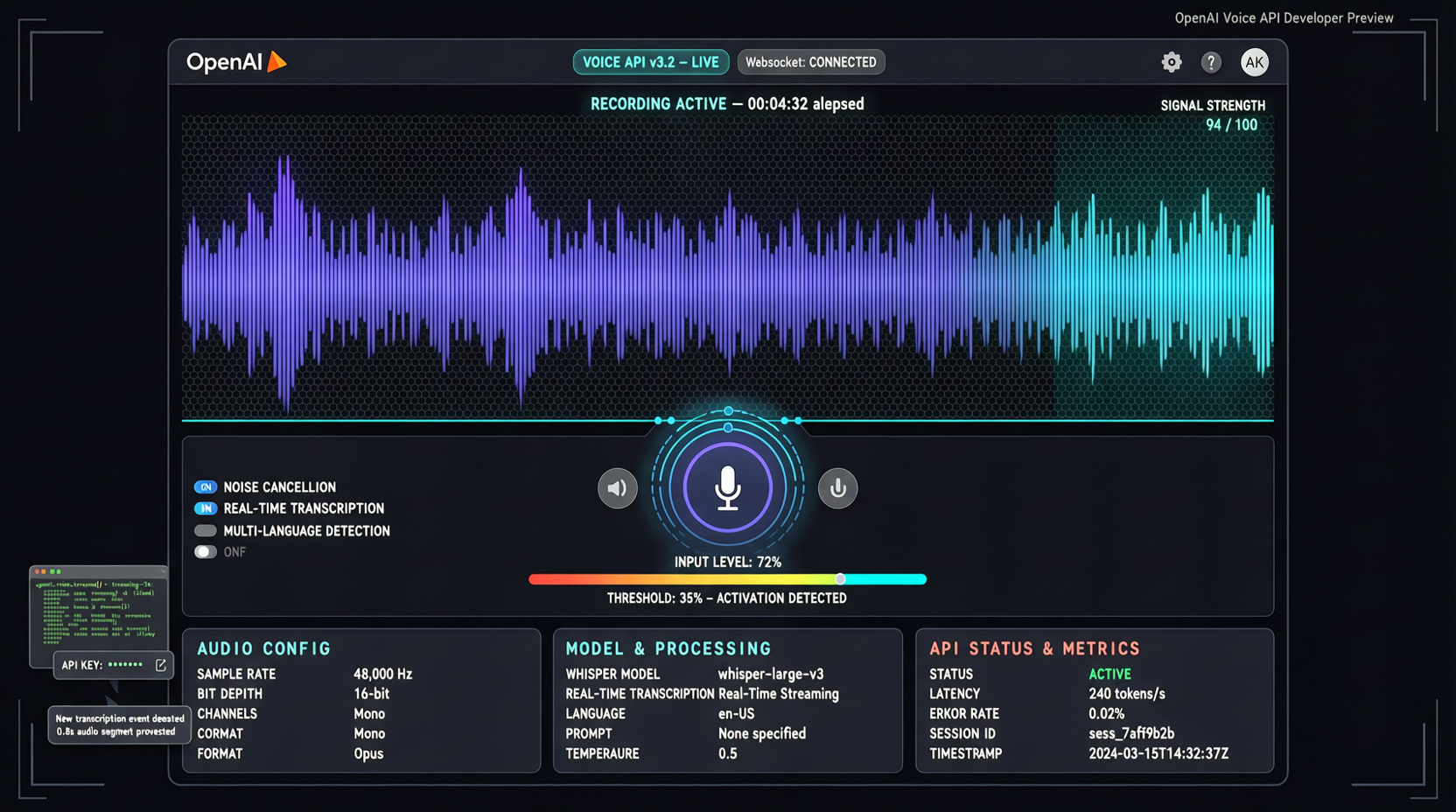

对做语音产品的团队来说,这降低了自研语音推理栈的必要性。以前你可能需要把语音转成文本,送给 GPT 做推理,再把结果转回语音——链路长、延迟高、错误累积。现在 OpenAI 把这三步合在了一个 API 调用里。

延迟数据官方没公布。但既然强调"real-time",意味着响应时间应该在亚秒级别——否则"实时"就只是营销用语。

一个保留

语音推理模型的实际效果,取决于它在噪音环境、方言、多人对话场景下的表现。实验室条件下的 demo 和真实世界的语音交互之间,通常隔着一条鸿沟。这个差距,等开发者拿到 API key 跑两天就知道了。

主要来源:OpenAI 官方博客、Reuters、VentureBeat。具体模型名称和定价待 OpenAI API 文档更新。