Ключевая деталь, которую большинство пропустило

Недавно в китайском AI-сообществе распространился румор о Kimi K3:

«По слухам, Kimi K3 планируется выпустить в третьем квартале, масштаб параметров превышает 2,5 триллиона; внутренние эксперименты уже протестировали длину контекста, значительно превышающую 1 миллион токенов, но остаётся неопределённым, будет ли контекст в 1M открыт для пользователей. Основным барьером, ограничивающим выпуск Kimi с контекстом в 1M, является не технология, а вычислительные ресурсы.»

Обратите внимание на последнее предложение — барьер — это не технология, а вычислительная мощность.

Это, возможно, самый легко непонятый, но наиболее решающий водораздел в конкуренции больших моделей 2026 года.

Техническая осуществимость против коммерческой жизнеспособности

С технической точки зрения, контекст в 1 миллион токенов больше не вопрос «можно ли это сделать».

DeepSeek V4 Flash/Pro уже поддерживает контекст в 1M, и внутренние эксперименты Kimi K3 также успешно прошли 1M+ токенов. Несколько проектов с открытым исходным кодом также экспериментируют со сверхдлинным контекстом.

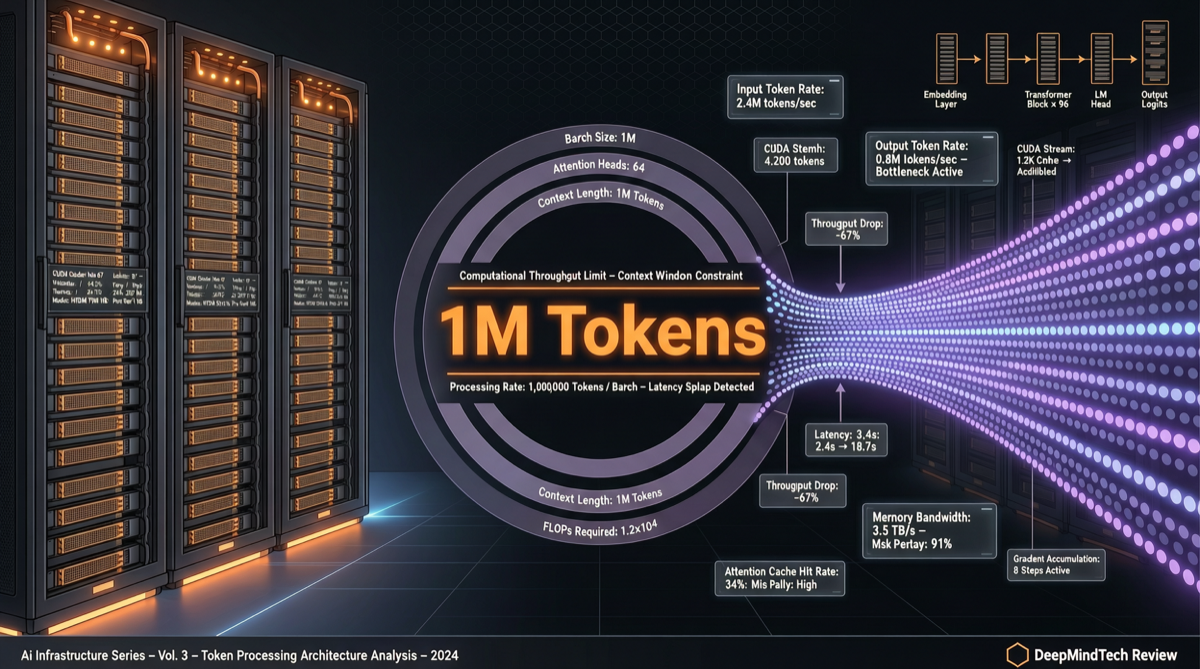

Настоящий вызов заключается в следующем: когда 1 миллион токенов поступает в модель, сколько вычислительной мощности требуется для обслуживания одного вывода?

Приблизительные оценки:

- KV Cache для 1M токенов в точности FP16 занимает примерно несколько ГБ видеопамяти

- Полный вывод контекста в 1M на A100 может занять от десятков секунд до нескольких минут

- Если 10 000 пользователей одновременно отправят запросы с контекстом в 1M, требуемый масштаб GPU-кластера будет астрономическим

Именно поэтому Kimi (Moonshot AI), несмотря на то что уже доказала технологию внутри компании, всё ещё колеблется открывать её для пользователей — вычислительные затраты съедят всю прибыль.

Вычислительные козыри в руках разных игроков

В этой гонке за контекст в 1M вычислительные ресурсы, находящиеся в руках каждого игрока, различаются колоссально:

DeepSeek: Собственные кластеры интеллектуальных вычислений + партнёрства с несколькими поставщиками вычислительных ресурсов. V4 Flash/Pro уже поддерживает контекст в 1M. Его уверенность проистекает из отличной оптимизации эффективности модели — та же длина контекста требует от DeepSeek меньше вычислительной мощности.

Moonshot AI (Kimi): Получила значительное финансирование, но всё ещё догоняет в области вычислительной инфраструктуры. Именно поэтому контекст в 1M для K3 «протестирован внутри», но «неясно, будет ли открыт».

Alibaba (Qwen): Опирается на вычислительную инфраструктуру Alibaba Cloud, теоретически наиболее способна предоставлять крупномасштабные сервисы с контекстом в 1M. Но стратегия Qwen больше ориентирована на эффективность модели и адаптацию к множеству сценариев, а не на чистое стремление к длине контекста.

Zhipu AI (GLM): Имеет наработки в области длинного контекста, но масштаб вычислений является ограничивающим фактором.

Почему это важно?

Потому что контекст в 1M — это не просто вопрос «может прочитать больше» — он переопределяет то, что может делать AI:

- Анализ полной кодовой базы: прочитать исходный код всего проекта за один раз для глобального рефакторинга

- Понимание длинных документов: Целая книга, юридический контракт или финансовый отчёт, проанализированные за один проход

- Память многораундового диалога: История взаимодействия с AI больше не нуждается в «обрезке» или «сжатии»

- Анализ данных: Массивные структурированные данные, введённые за один раз, с прямым выводом заключений

Когда модель первой предоставляет контекст в 1M по доступной цене, она получает структурное преимущество в этих сценариях — не потому, что модель умнее, а потому, что она может «видеть» больше информации.

Три поля битвы в вычислительной гонке

Развивая румор о Kimi K3, вычислительная гонка в индустрии больших моделей 2026 года концентрируется на трёх уровнях:

1. Вычисления для обучения: потолок масштаба параметров

2,5 триллиона параметров Kimi K3 означают, что вычислительная мощность, необходимая для обучения, является астрономической. Это не вопрос «купить ещё несколько карт» — это требует систематического создания полнофункциональных возможностей от чипов до кластеров.

2. Вычисления для вывода: решающий фактор стоимости сервиса

Стоимость обслуживания контекста в 1M определяет, кто может коммерциализировать в масштабе. DeepSeek снизил стоимость вывода через оптимизацию архитектуры модели (MoE, разреженность и т. д.), что, возможно, является ключевой причиной, по которой он открыл контекст в 1M быстрее конкурентов.

3. Периферийные вычисления: будущее локального развёртывания

Выдающаяся производительность Qwen 3.6 в локальных моделях показывает, что параллельно продвигается другой путь: вместить достаточно мощную модель в оборудование потребительского класса. Это не путь контекста в 1M, но может быть более практичной стратегией «достаточно хорошо».

Сигналы для индустрии и инвесторов

- Вычислительная мощность — настоящая защитная стена. Архитектуры моделей можно скопировать, статьи — воспроизвести, но вычислительная инфраструктура требует времени и накопления капитала.

- Контекст в 1M станет водоразделом. Компании, которые могут себе это позволить, получат дифференцированные преимущества; те, которые не могут, будут вынуждены конкурировать на длинах контекста «достаточно хороших».

- Третий квартал — критическое окно. Если Kimi K3 выйдет по графику в третьем квартале и откроет контекст в 1M, Moonshot AI докажет, что её вычислительная инфраструктура достигла нового уровня. Если задержка или сокращение — это указывает на то, что вычислительный барьер серьёзнее, чем ожидали внешние наблюдатели.

Конкуренция больших моделей сместилась от «чья статья сильнее» к «чьих вычислений достаточно». Это не сексуальный нарратив, но это ключ к определению победителя.