Addy Osmani выложил agent-skills на GitHub, и за неделю проект набрал 11 791 звезду.

Не список «XX AI-инструментов». Каждый навык — это инженерная практика продакшн-уровня: как делать code review, писать миграции, обрабатывать breaking changes.

Тот факт, что это стало вирусным, означает одно: bottleneck для AI-кодирующих агентов — не модель, а инженерные знания.

Модели становятся лучше, но код всё ещё требует «знать как»

GPT-5, Claude Opus 4.7, Qwen3.6 — эти модели пишут код хорошо. Но в реальной работе написание кода — это 30% задачи. Остальные 70%:

- Каковы тестовые конвенции проекта?

- В каком формате писать PR?

- Нужно ли запускать бенчмарки при обновлении зависимостей?

Модель этого не знает. Ей нужно сказать.

Agent-skills стандартизирует часть «сказать ей». Не промпты, а структурированные определения навыков.

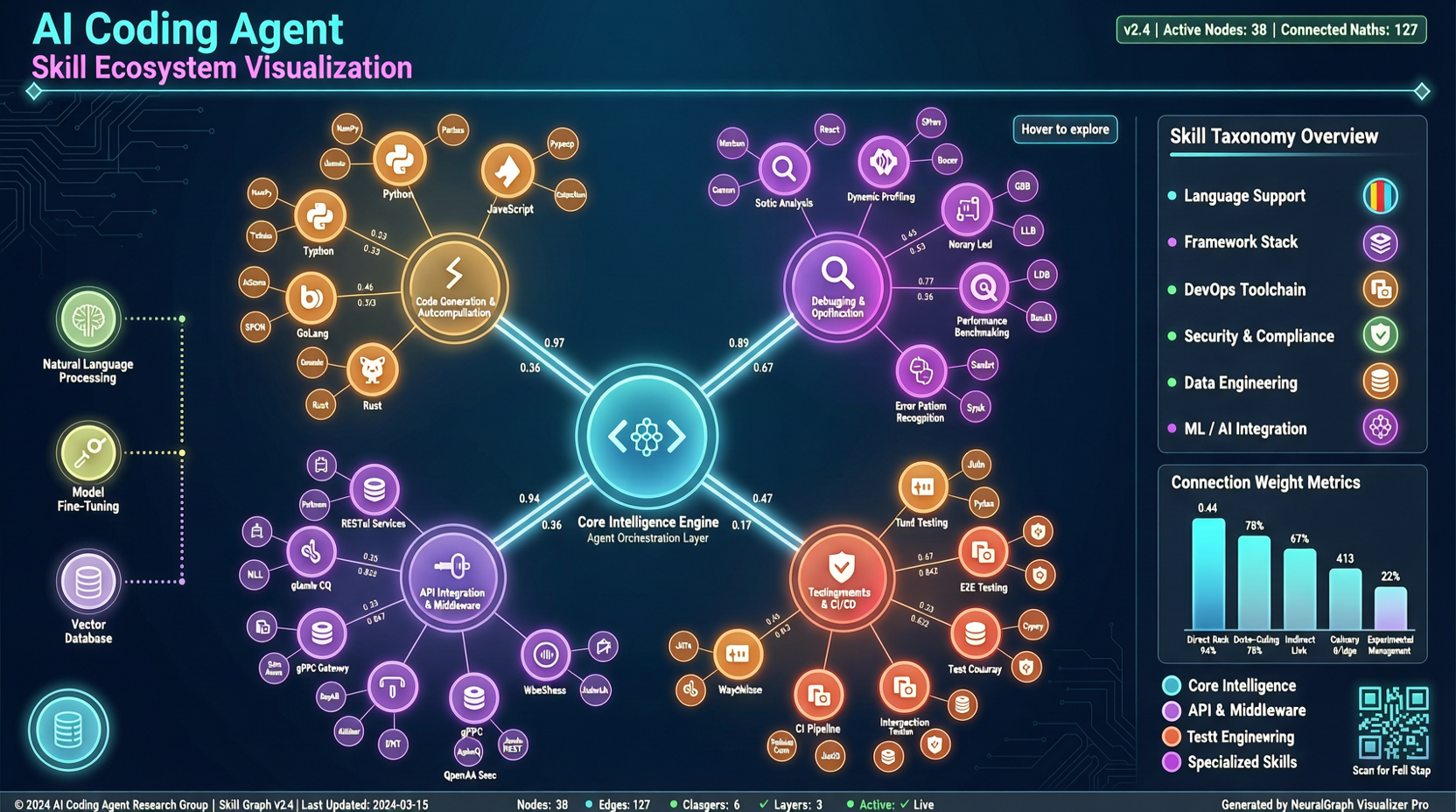

Экосистема AI-кодинга на GitHub на этой неделе

agent-skills (40k+) — определяет, что агенты могут делать

agentmemory (7.3k) — сохраняет контекст проекта

DeepSeek-TUI (27k) — терминальный интерфейс агента

9router (9.8k) — подключает агентов к 40+ моделям

UI-TARS-desktop (33k) — мультимодальный GUI-агент

Кто определяет стандарт, определяет будущее

NPM определил формат JS-пакетов. Docker — упаковку контейнеров. MCP — протокол вызова инструментов.

Agent-skills может стать «стандартом навыков» для AI-кодирующих агентов.

Моё мнение

Буду отслеживать проект. Не потому что его сделал кто-то из Google, а потому что он бьёт в реальный пробел: агентам не хватает моста между способностью и конкретной инженерной практикой.

Источники: