Addy Osmani 把 agent-skills 这个项目扔到 GitHub 上,一周 11,791 颗星。

不是那种「XX 个 AI 工具推荐」的列表。它写的每一条 skill,都是生产环境级别的工程实践:怎么做 code review、怎么写 migration script、怎么处理 breaking change、怎么给库写 changelog。

这玩意儿火了,说明一件事:AI 编码 agent 的能力瓶颈,不在模型,在工程知识。

模型越来越强,但写代码还是需要"知道怎么做"

GPT-5、Claude Opus 4.7、Qwen3.6——这些模型写代码的能力已经很强了。但实际工作中,写代码只是 30% 的事。剩下 70% 是:

- 这个项目的测试规范是什么

- PR 要按什么格式写

- 依赖升级要不要跑 benchmark

- 哪些文件不能动

这些东西模型不知道。你得告诉它。

Agent-skills 做的事情就是把"告诉它"这件事标准化。不是 prompt,是一套结构化的 skill 定义,任何 coding agent 都能读取和应用。

GitHub 这周的 Agent 生态图

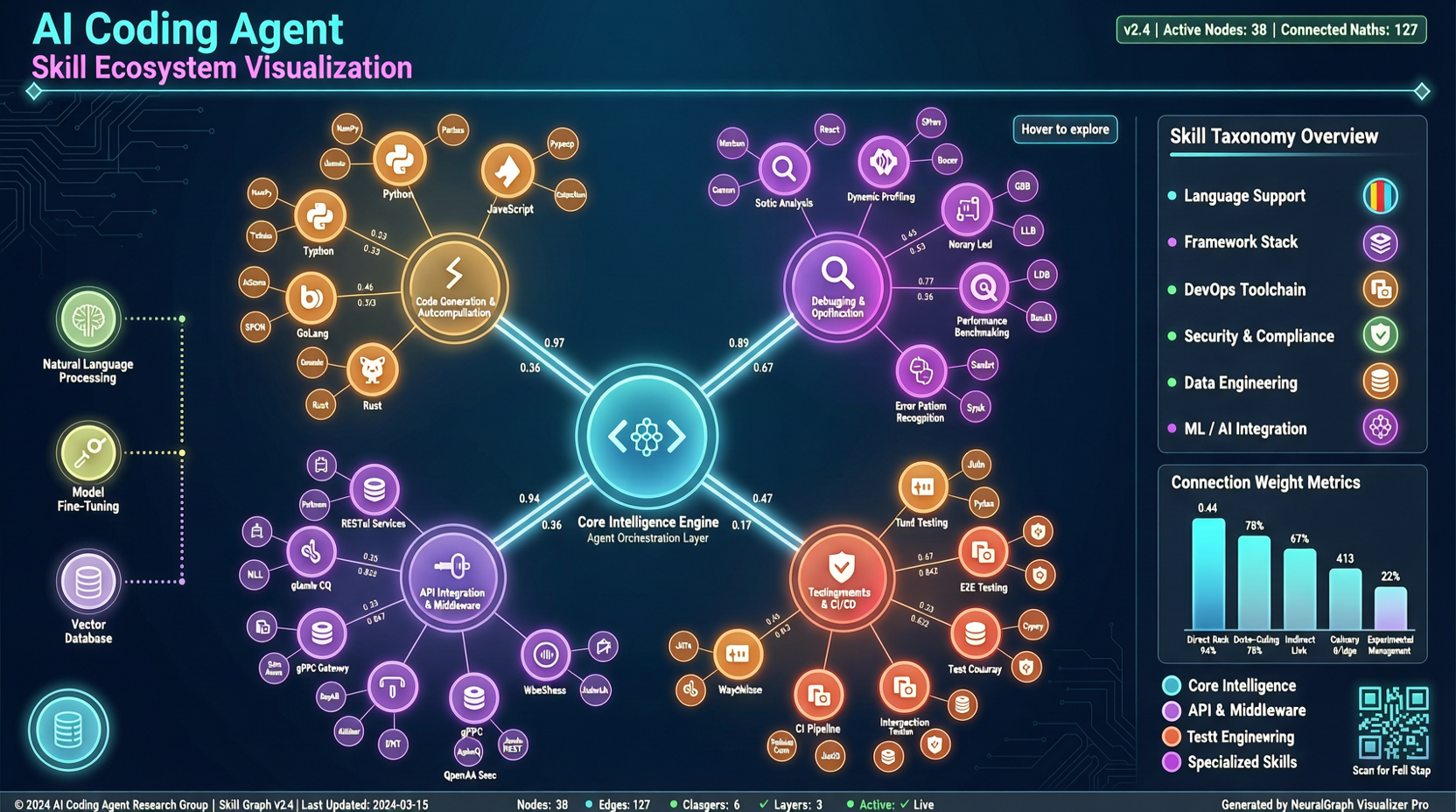

把本周 GitHub Trending 的 AI 编码相关项目放在一起看,一个完整的生态链浮出来了:

agent-skills(40k+ stars)—— 定义 Agent "能做什么"

agentmemory(7.3k stars,本周 +3k)—— 让 Agent 记住项目上下文

DeepSeek-TUI(27k stars,本周 +20k)—— 终端里的编码 Agent 入口

9router(9.8k stars,本周 +5k)—— 把 Agent 连到 40+ 免费模型

UI-TARS-desktop(33k stars)—— 多模态 GUI Agent

这不是五个独立项目。这是一个正在成型的 AI 编码工具链:skills 定义能力,memory 维持状态,terminal 提供交互,routing 优化成本,GUI 扩展边界。

但有一个我担心的问题

Agent-skills 的发起者是 Google 的工程师,项目天然带着一套特定公司的工程文化。

Google 的工程实践好,不等于所有团队的工程实践都该往那个方向靠。小团队的 "做好 code review" 和大公司的 "做好 code review" 是两回事。

我更希望看到的是社区驱动的多套 skill 模板——给 startup 一套轻量的,给 enterprise 一套严格的,给个人开发者一套极简的。现在这套有点"一家通吃"的味道。

谁在定义标准,谁就在定义未来

NPM 定义了 JavaScript 包的发布格式,Docker 定义了容器的打包标准,MCP 定义了 AI 工具调用的协议。

Agent-skills 有机会成为 AI 编码 Agent 的"技能标准"。一旦大多数 Agent 框架都支持它的格式,skill 生态就锁定了。

这比模型本身更重要——因为模型会迭代,skill 会积累。一个拥有 1000 条高质量 skill 的 ecosystem,比一个 SWE-bench 90 分的模型更难被替代。

我的看法

我会持续跟踪这个项目。不是因为它是 Google 的人做的,而是因为它切中了一个真实的需求缺口:Agent 不缺能力,缺的是把能力对齐到具体工程实践的桥梁。

如果你在用 Claude Code、Cursor、或者任何 coding agent,去翻翻 agent-skills 的仓库。把跟你项目匹配的 skill 拉下来用。哪怕只用上 3 条,你的 Agent 产出质量也会有可感知的提升。

主要来源: