Революция «обучаемости» AI-агентов

Долгое время AI-агенты сталкивались с фундаментальным противоречием: легко построить, сложно оптимизировать.

С помощью LangChain, CrewAI или любого другого оркестрационного фреймворка можно быстро собрать агента. Но когда его производительность не соответствует ожиданиям, варианты оптимизации ограничены: промпт-инжиниринг, корректировка логики вызова инструментов или просто смена базовой модели.

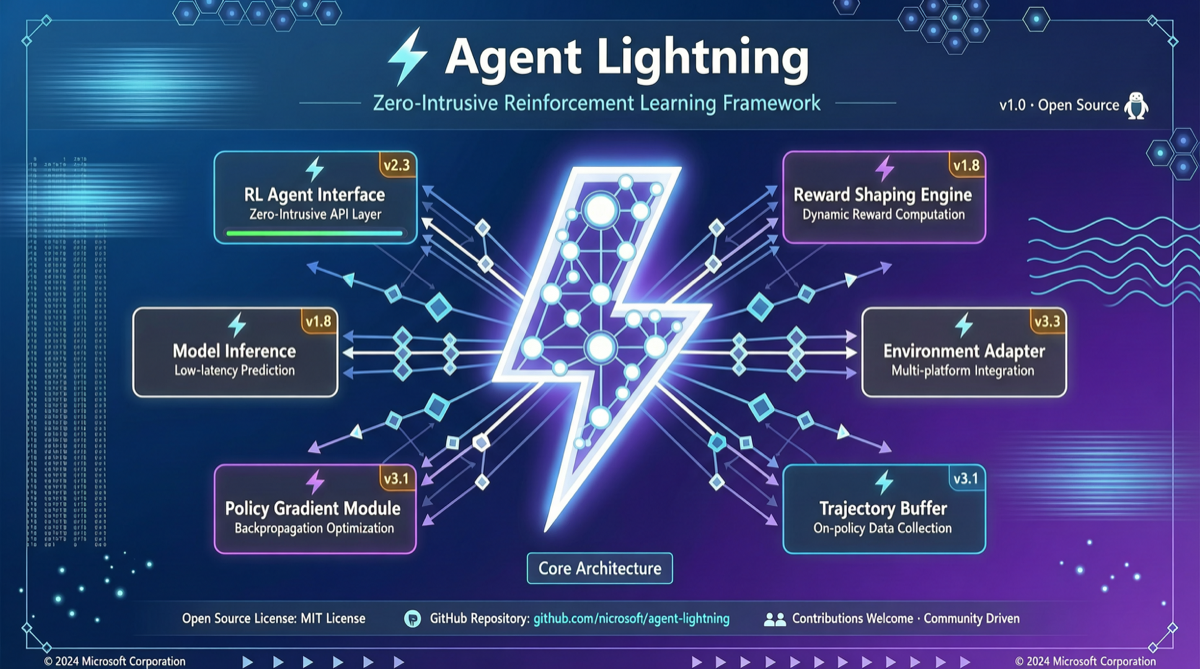

Фреймворк Agent Lightning от Microsoft Research Asia пытается решить эту проблему на корневом уровне.

Ключевая концепция: RL-обучение без вмешательства

Философия дизайна Agent Lightning может быть выражена одним предложением: Не трогайте код вашего агента, но сделайте его сильнее.

| Компонент | Функция |

|---|---|

| Observer | Захватывает все взаимодействия агента с окружением, записывает последовательности состояние-действие-результат |

| Reward Engine | Подключаемый движок вычисления вознаграждений, поддерживает вознаграждения на уровне результата и процесса |

| Trainer | Оптимизатор политик на основе алгоритмов PPO/GRPO, совместим с vLLM, Megatron-LM |

| Strategy Injector | Внедряет обученные политики в агента в виде «поведенческого руководства» без изменения исходного кода |

Почему это важно

1. Снижение порога оптимизации агентов

В настоящее время только команды с инженерными возможностями RL могут систематически оптимизировать агентов. Agent Lightning превращает эту возможность в инструмент «настройте функцию вознаграждения и готово».

2. Решение проблемы «последней мили»

Базовые модели быстро улучшаются, но производительность агента зависит от того, «насколько хорошо вы используете эту способность». Agent Lightning может многократно повысить производительность агента на конкретных задачах через RL-обучение без изменения базовой модели.

Сценарии применения

- Агенты сложных рабочих процессов: Многошаговое рассуждение и многоинструментальные сценарии

- Агенты обслуживания/диалога: Качество диалога и удовлетворённость пользователей как сигналы вознаграждения

- Агенты автономного выполнения: Системы типа OpenClaw и Hermes Agent

Основные источники:

- Agent Lightning GitHub - Microsoft

- MSRA Agent Lightning - MSRA