Есть задача, которая давно доставляет головную боль: чтобы создать AI-маньхуа или анимационный короткий ролик, нужно отдельно решить раскадровку сценария, согласованность персонажей, генерацию кадров, видео-интерполяцию, наложение субтитров — и всё это сопровождается вызовами API нескольких моделей и тонкой настройкой промптов.

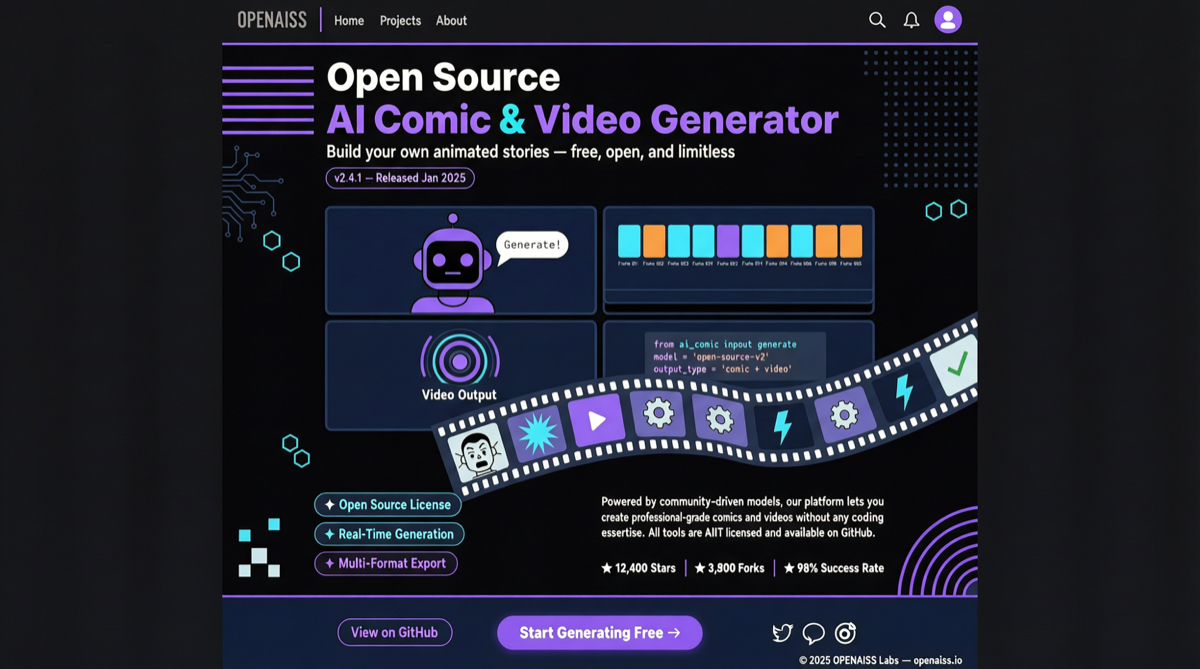

Недавно я нашёл открытый проект, который связывает все эти шаги в единый конвейер: загружаешь TXT-файл, а на выходе получаешь анимационное видео с субтитрами.

От сценария до видео — полная автоматизация

Главное преимущество AIComicBuilder (GitHub) не в том, что какой-то отдельный этап работает особенно хорошо, а в том, что весь конвейер выстроен от начала до конца:

Загрузка TXT/DOCX/PDF → AI-анализ сценария → извлечение персонажей и генерация визуальных описаний → создание четырёх проекций каждого персонажа (фас/профиль/спина/три четверти) → интеллектуальная разбивка на раскадровку → генерация ключевых начального и конечного кадров → AI-генерация промптов для видео → интерполяция между кадрами для создания видеоклипов → склейка и встраивание субтитров.

Каждый этап можно запускать отдельно или выполнять пакетно. Страница раскадровки имеет режим списка и канбан-режим, где колонки автоматически распределяются по статусу генерации — похоже на рабочий процесс Trello.

Согласованность персонажей — вот где настоящая сложность

Все, кто занимался AI-видео, знают: самая большая проблема не «нарисовать одну хорошую картинку», а «чтобы один и тот же персонаж выглядел одинаково в разных кадрах».

Решение AIComicBuilder довольно прямое: сначала для каждого персонажа генерируются референсные изображения в четырёх проекциях, и при последующей генерации всех кадров и ключевых изображений эти референсы подключаются. Это как подключить «внешнюю память» для модели изображений, сообщая ей: «Этот человек выглядит так, его зовут Чжан Сань, и в следующем кадре он должен выглядеть точно так же».

Судя по результатам, это гораздо надёжнее, чем полагаться исключительно на текстовое описание внешности персонажа в промпте.

Несколько поставщиков моделей — без привязки к одному

Технологический стек весьма практичный:

- Текстовые модели: OpenAI, Gemini

- Модели изображений: DALL-E, Gemini Imagen, Kling, Tongyi Wanxiang

- Видео-модели: Seedance (ByteDance), Kling (Kuaishou), Veo (Google), UCloud Seedance

На каждом этапе можно настроить своего поставщика. Например, текст — через Gemini, изображения — через Tongyi Wanxiang, видео — через Seedance. Комбинируйте, выбирая лучшие результаты от каждого.

Фронтенд построен на Next.js 16 + React 19 + Tailwind CSS 4, база данных — SQLite + Drizzle ORM, менеджер пакетов — pnpm. В проекте 417 коммитов, последнее обновление было 3 недели назад.

Низкий порог развёртывания

Запуск в Docker — одна команда:

docker run -d \

--name ai-comic-builder \

-p 3000:3000 \

-v ./data:/app/data \

-v ./uploads:/app/uploads \

--platform linux/amd64 \

twwch/aicomicbuilder:latest

После запуска настройте API-ключи AI-моделей на странице настроек, и всё готово. Данные хранятся в локальной SQLite, достаточно смонтировать два тома — ./data и ./uploads.

Практические наблюдения

Я скачал проект и запустил его — установка и развёртывание прошли гладко (при pnpm install возникла проблема со сборкой нативного модуля, которая решилась настройкой allowBuilds в pnpm-workspace.yaml). Локально на localhost:3000 интерфейс чистый, на китайском языке, есть всё — от создания проекта до управления сериями, персонажами и редактирования раскадровки.

Однако для полного прохождения конвейера генерации необходимо настроить API-ключи хотя бы для одной модели изображений и одной видео-модели. Seedance и Tongyi Wanxiang удобны для пользователей из Китая — ключа DashScope достаточно одновременно для моделей изображений Tongyi Wanxiang и видео Wan.

Для чего это можно использовать

Это не замена профессиональному производству анимации, а инструмент для:

- Массового производства контента для коротких драм/story-аккаунтов: есть текст романа или рассказа — автоматически разбивается на видео-маньхуа

- Обучающих/научно-популярных анимаций: запишите знания в виде сценария и пакетно генерируйте анимации

- Быстрой проверки прототипов: хотите увидеть, как будет выглядеть анимация определённой сцены, не дожидаясь работы художников и монтажеров

На Bilibili уже есть несколько демо-видео, включая «Кулак души: Последний раунд», сгенерированное с помощью Seedance 2.0 — можно оценить результат.

Источник: AIComicBuilder GitHub · Лицензия Apache 2.0