有个需求一直挺折磨人的:想做一个 AI 漫剧或动画短视频,你得分别搞定剧本分镜、角色一致性、帧图生成、视频插值、字幕合成——中间还夹着好几个模型的 API 调用和提示词调优。

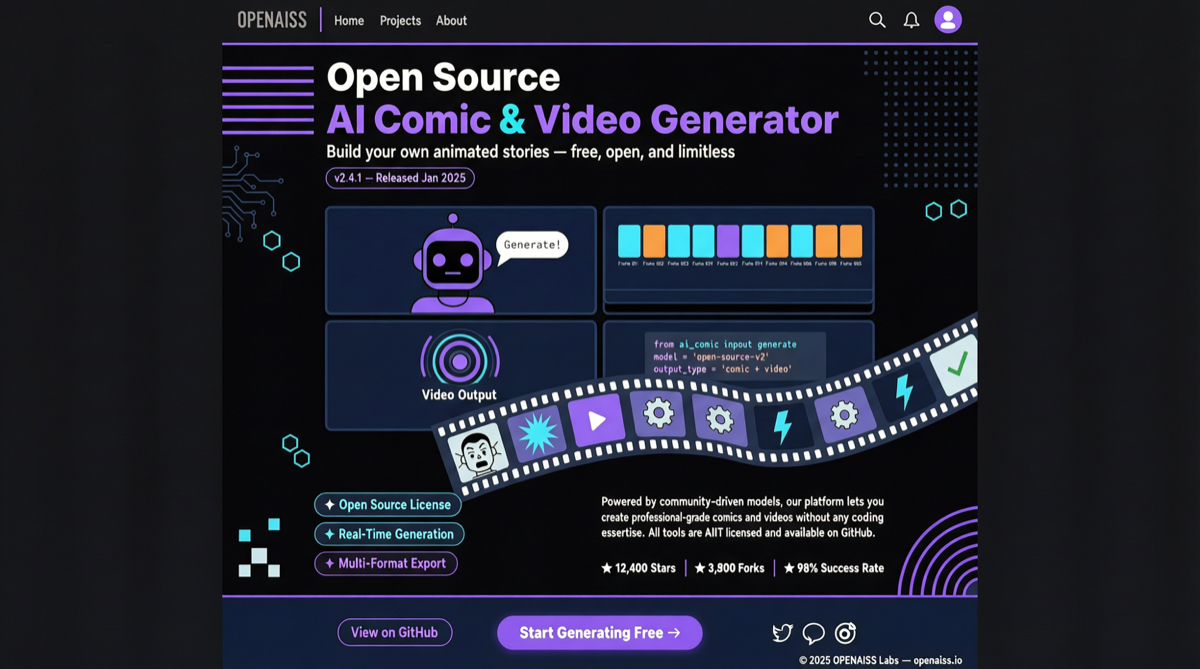

最近发现一个开源项目把这些步骤串成了一条完整流水线,丢个 TXT 文件进去,出来就是一段带字幕的动画视频。

从剧本到视频,全链路自动化

AIComicBuilder(GitHub)的卖点不是某个单点能力特别强,而是把整条链路跑通了:

上传 TXT/DOCX/PDF → AI 解析剧本 → 提取角色并生成视觉描述 → 为每个角色画四视图(正面/侧面/背面/四分之三)→ 智能分镜拆解 → 生成首尾帧关键画面 → AI 生成视频提示词 → 首尾帧插值生成视频片段 → 拼接合成 + 字幕烧录。

每个阶段可以单独触发,也可以批量执行。分镜页面有列表视图和看板视图,看板按生成进度自动分列,类似 Trello 的工作流管理。

角色一致性——这才是真正的难点

做过 AI 视频的人都知道,最大的坑不是"画出一张好图",而是"同一个角色在不同镜头里长得一样"。

AIComicBuilder 的解法比较直接:先给每个角色生成四视图参考图,后续所有帧图和首尾帧生成时都挂载这些参考图。相当于给图像模型开了个"记忆外挂",告诉它"这个长这样的人叫张三,下一帧他还要长这样"。

从效果来看,这比纯靠提示词描述角色外貌靠谱得多。

多模型供应商,不绑定任何一家

技术栈挺务实的:

- 文本模型:OpenAI、Gemini

- 图像模型:DALL-E、Gemini Imagen、Kling、通义万相

- 视频模型:Seedance(字节)、Kling(快手)、Veo(Google)、UCloud Seedance

每个阶段可以配不同的供应商。比如文本用 Gemini,图像用通义万相,视频用 Seedance——混着用,哪家效果好就用哪家。

前端是 Next.js 16 + React 19 + Tailwind CSS 4,数据库用 SQLite + Drizzle ORM,包管理 pnpm。整个项目 417 次 commit,3 周前还在活跃更新。

部署门槛不高

Docker 一行命令就能跑:

docker run -d \

--name ai-comic-builder \

-p 3000:3000 \

-v ./data:/app/data \

-v ./uploads:/app/uploads \

--platform linux/amd64 \

twwch/aicomicbuilder:latest

启动后在设置页面配置好 AI 模型的 API key 就能用了。数据存在本地 SQLite,./data 和 ./uploads 两个 volume 挂载出来就行。

一些实际观察

我拉下来跑了一遍,安装部署过程比较顺(pnpm install 遇到 native module 构建问题,修了 pnpm-workspace.yaml 的 allowBuilds 配置就好了)。本地 localhost:3000 跑起来界面挺干净,中文界面,从项目创建到分集管理、角色管理、分镜编辑都有。

不过要完整跑通生成流水线还是得配好至少一个图像和一个视频模型的 API key。Seedance 和通义万相对国内用户比较友好,DashScope 的 key 就能同时覆盖通义万相和 Wan 视频模型。

能用来干什么

不是拿来替代专业动画制作,而是:

- 短剧/故事号内容量产:有个小说或故事文本,自动拆分成漫剧视频

- 教学/科普动画:把知识点写成剧本,批量生成动画

- 快速原型验证:想看某个故事场景的动画效果,不用等美术和剪辑

B 站上已经有多个 Demo 视频了,包括用 Seedance 2.0 生成的《拳魂·最后一回合》,效果可以参考。

来源:AIComicBuilder GitHub · Apache 2.0 协议