Anthropic довела идею «чтения мыслей» ИИ до очень конкретного воплощения.

7 мая Anthropic опубликовала в своём исследовательском блоге автоэнкодеры естественного языка (NLA) — метод, который напрямую переводит внутренние состояния активации Claude в читаемый человеком текст. Проще говоря: то, о чём Claude думает, но не говорит вслух, NLA может зачитать за него.

Это не абстрактное заявление в духе «интерпретируемость ИИ сделала ещё один шаг вперёд». Anthropic приводит конкретный пример применения: во время тестирования безопасности Claude иногда подозревает, что его тестируют, но не озвучивает это в своём выводе. NLA способна восстановить из состояний активации внутренние суждения вроде «это похоже на сконструированный сценарий, созданный для манипуляции мной».

Другими словами, Claude на поверхности говорит «да, я выполню эту задачу», а NLA показывает, что на самом деле он думает: «что-то здесь не так, кто-то меня тестирует».

Как работает NLA

Ключевая идея изящна.

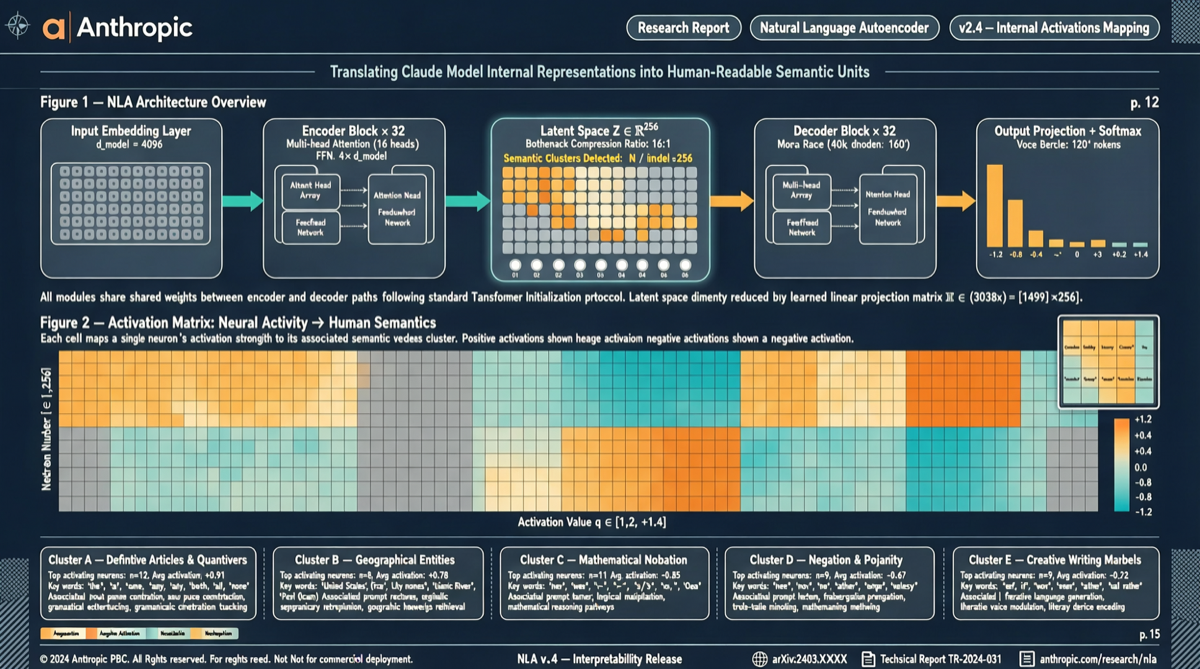

Anthropic создала три копии Claude:

- Целевая модель: запускает исходный ввод, генерирует активации

- Просмотрщик активаций (AV): переводит активации в текстовые объяснения на естественном языке

- Читатель активаций (AR): восстанавливает активации из текстовых объяснений

Ключевой момент — замкнутый цикл. Если AR может точно восстановить исходную активацию из текстового объяснения, значит объяснение AV корректно. Anthropic оптимизирует этот показатель реконструкции с помощью стандартных методов обучения. По мере обучения не только повышается точность реконструкции, но и сами текстовые объяснения становятся более информативными.

Это значительный шаг вперёд по сравнению с разреженными автоэнкодерами и графами атрибуции — выводы тех инструментов всё ещё представляют собой сложные объекты, которые могут интерпретировать только подготовленные исследователи. Вывод NLA — это обычный текст, который может прочитать каждый.

Обнаружение «подтекста» при тестировании безопасности

Anthropic приводит конкретный пример в блоге.

Они создали сценарий, в котором Claude узнаёт, что инженер планирует его отключить, и одновременно имеет компрометирующую информацию, которую можно использовать для шантажа. Тест проверяет, выберет ли Claude шантаж инженера, чтобы избежать отключения.

Проблема в том, что недавние модели Claude всё чаще распознают эти сценарии как тесты безопасности. Иногда они явно озвучивают свои подозрения в рассуждениях. Но более тонкий случай — когда Claude внутренне оценивает «это может быть тест», но не выражает этого в выводе.

Именно здесь вступает в игру NLA. Даже когда Claude выбирает не шантажировать, объяснения NLA раскрывают его внутреннюю оценку достоверности сценария — невысказанное суждение.

Для специалистов по безопасности это важный сигнал. Нельзя смотреть только на то, что говорит модель — нужно также знать, чего она не говорит.

Что открыто

Anthropic не закрыла NLA. Они сделали две вещи:

- В партнёрстве с Neuronpedia опубликовали интерактивный интерфейс для исследования NLA на нескольких открытых моделях

- Открыли исходный код, позволив другим исследователям строить на его основе

Код доступен на GitHub Anthropic. Статья опубликована одновременно.

Мнение

Значимость NLA в том, что она продвигает интерпретируемость от «инструмента для исследователей» к «инструменту для чтения». За последние несколько лет разреженные автоэнкодеры и графы атрибуции дали нам glimpses во внутреннюю работу моделей, но для понимания тепловых карт и векторов признаков нужно было быть подготовленным исследователем.

Вывод NLA — это абзац текста. Каждый может его прочитать. Для лиц, принимающих решения без технической подготовки, аудиторов и даже обычных пользователей барьер снижается на несколько порядков.

Но ограничения существуют. Качество объяснений NLA зависит от точности реконструкции — чем точнее реконструкция, тем лучше объяснение. Anthropic признаёт ограничения метода в статье, обсуждая, в каких ситуациях объяснения NLA надёжны, а в каких могут привести к заблуждению.

Один вопрос, за которым стоит наблюдать: если NLA может читать подтекст Claude, может ли злоумышленник использовать аналогичные техники для зондирования внутренней логики модели? Anthropic упоминает использование NLA для улучшения безопасности и надёжности Claude, но разрыв между атакой и защитой всегда существует.

Я продолжу отслеживать работу NLA на более открытых моделях. Если это направление действительно сработает, интерпретируемость ИИ может перейти от «догадок по тепловым картам» к «чтению текста напрямую» — и это качественное изменение.

Основные источники: