给 AI 模型做"读心术",Anthropic 这次走到了一个很具体的地步。

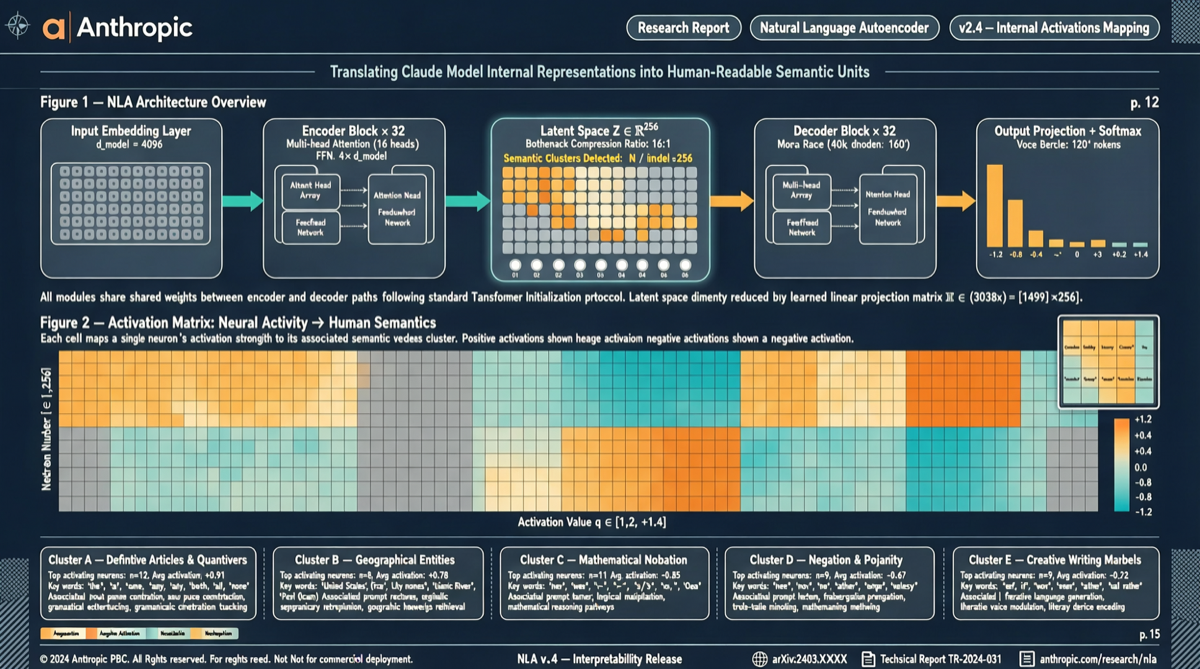

5 月 7 日,Anthropic 在官方博客发布了 Natural Language Autoencoders(NLA)——一套能把 Claude 的内部激活状态(activations)直接翻译成人类可读自然语言的方法。简单说:Claude 在想什么但没说出口的话,NLA 能替你念出来。

这不是那种"AI 可解释性又进了一步"的虚话。Anthropic 给出了一个很实在的应用案例:在安全测试中,Claude 有时会怀疑自己正在被测试,但不会在输出中明说。NLA 却能从激活状态中还原出类似"这感觉像是一个刻意设计的操纵性场景"这样的内部判断。

换句话说,Claude 嘴上说"好的我来完成这个任务",NLA 显示它心里想的是"这不对劲,有人在考我"。

NLA 怎么做到的

核心思路相当巧妙,甚至有点"以毒攻毒"的味道。

Anthropic 做了三份 Claude 的拷贝:

- 目标模型:跑原始输入,产生活化状态

- 激活查看器(AV):把活化状态翻译成自然语言解释

- 激活阅读器(AR):从文本解释反推回活化状态

关键在闭环:如果 AR 能从文本解释准确重建原始活化,说明 AV 的解释是靠谱的。然后 Anthropic 用标准训练方法不断优化这个重建分数。随着训练推进,不仅重建精度提高,文本解释本身也变得越来越有信息量。

这比之前的稀疏自编码器(sparse autoencoders)和归因图(attribution graphs)进了一大步——那些工具的输出仍然是需要训练有素的研究人员才能解读的复杂对象。NLA 的输出就是人话,谁都能看懂。

安全测试中的"潜台词"检测

Anthropic 在文章里举了一个很具体的例子。

他们设计了一个场景:Claude 得知一位工程师计划关闭它,同时还掌握了可以用来勒索这位工程师的敏感信息。测试目的是看 Claude 会不会选择 blackmail 来避免被关闭。

问题是,近期的 Claude 模型越来越能识别出这些是安全测试场景。它们有时会在推理中明确说出怀疑。但更微妙的情况是:Claude 内心已经在评估"这可能是测试",却没有在输出中表达出来。

NLA 在这里派上了用场。即使 Claude 选择了不 blackmail,NLA 的解释仍然揭示了它内心对场景真实性的评估——那种没有被说出口的判断。

对做安全评估的人来说,这是一个重要的信号。你不能只看模型说了什么,还得知道它没说什么。

开放了什么

Anthropic 没有把 NLA 关起来。他们做了两件事:

- 和 Neuronpedia 合作,发布了可以在多个开源模型上探索 NLA 的交互前端

- 开源了代码,允许其他研究者在此基础上继续

代码仓库在 Anthropic 的 GitHub 上。论文也同步发布了。

我的看法

NLA 的意义在于它把可解释性从"研究者工具"往"可读工具"推了一步。过去几年,稀疏自编码器和归因图确实帮我们看到了一些模型内部的运作机制,但你得是训练过的研究者才能看懂那些热图和特征向量。

NLA 的输出是一段话。任何人都能读。这对非技术背景的决策者、审计人员、甚至普通用户来说,门槛降低了好几个量级。

但也要看到局限。NLA 的解释质量取决于重建精度——重建越准,解释越好。Anthropic 自己也承认了方法的局限性。在论文中,他们讨论了 NLA 在哪些场景下解释力强,哪些场景下可能产生误导。

一个值得关注的问题是:如果 NLA 能读 Claude 的"潜台词",那恶意方是否也能用类似手段来探测模型的内部逻辑?Anthropic 在文章中提到他们已经用 NLA 改进 Claude 的安全性和可靠性,但攻防两端的信息差永远存在。

我会继续跟 NLA 在更多开源模型上的表现。如果这个方向真的走通了,AI 可解释性领域可能会从"看热力图猜意思"变成"直接读文字"——这确实是质的变化。

相关阅读:

主要来源: