Anthropic 今天一口气发了三篇研究相关文章,前两篇是上一篇写的 NLA 可解释性 和 Petri 对齐工具捐赠。第三篇是 The Anthropic Institute 的研究重点方向。

这三件事放在一起看,信号比单看任何一篇都强。

Anthropic Institute 是什么

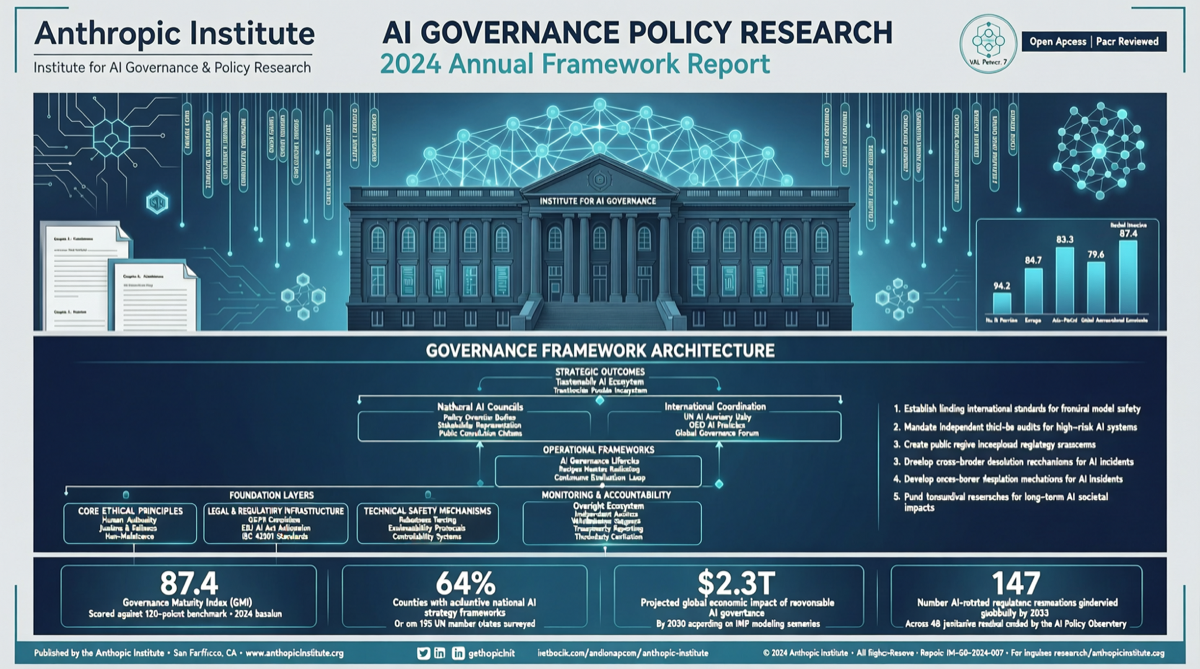

The Anthropic Institute 是 Anthropic 旗下专注于 AI 政策和社会影响的研究机构。它不是技术团队,不做模型训练,而是研究 AI 在现实世界中的使用方式、社会影响和治理框架。

之前 Anthropic 发布的 81,000 用户调查 就是这个团队做的——那是迄今最大规模的多语言 AI 用户定性研究。

今天发布的研究方向

新的研究方向涵盖了几个核心领域,但具体内容需要等全文发布。从 Anthropic 一贯的研究风格来看,大概率会涉及:

- AI 在劳动力市场中的实际影响

- 模型部署的社会风险评估框架

- AI 治理的国际协调机制

组合拳的意义

把今天的三件事放在一起:

- NLA:让模型内部思维变得可读——技术上解决"AI 在想什么"的问题

- Petri 捐赠:把对齐评估工具交给独立组织——制度上解决"谁来评估 AI"的问题

- Institute 研究方向:确定治理研究的优先级——政策上解决"AI 该怎么管"的问题

这不是三个独立公告,而是一个完整的策略:技术工具 + 独立评估 + 政策框架。Anthropic 在安全治理上的投入已经不是"做做样子"的程度了。

对比一下国内的情况。IMF 此前已经发出过 AI 系统性金融风险的警告,而 欧盟 AI Act 的临时协议也在不断调整。Anthropic 的三步走,某种程度上是在用自己的行动推动整个行业的治理标准。

一个观察

Anthropic 在安全治理上的投入,和它的商业策略是绑定的。当 ARR 达到 44 亿美元 的时候,安全不再只是成本,而是竞争壁垒。

能证明自己比竞品更安全、更可解释、更负责任的模型公司,在企业市场会有天然的信任优势。Anthropic 今天的三连发,既是技术动作,也是商业动作。

主要来源: