Главный вывод

DFlash — на данный момент самое примечательное решение в области спекулятивного декодирования: параллельная предсказание нескольких токенов на базе Block Diffusion достигает до 6-кратного ускорения инференса на основных моделях, таких как Qwen3.5, Gemma-4 и Kimi-K2, при нулевой потере точности. Для команд, развёртывающих LLM на собственных серверах, это прямое решение для снижения затрат на GPU и повышения скорости отклика.

Технический принцип

Традиционный инференс LLM — это авторегрессивная генерация токен за токеном — каждый шаг выводит только один токен, затем генерирует следующий на основе полного контекста. Это коренная причина медленного инференса LLM.

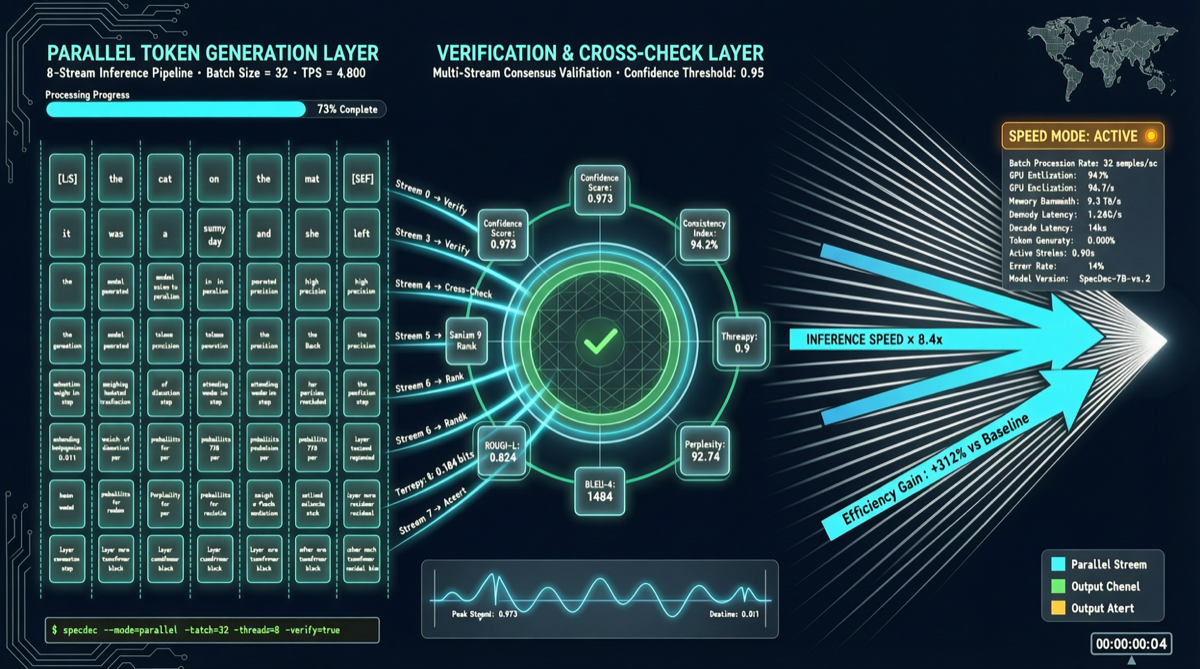

Ключевая инновация DFlash — черновая модель Block Diffusion:

| Шаг | Традиционный метод | Метод DFlash |

|---|---|---|

| Генерация черновика | Маленькая черновая модель генерирует N токенов по одному | Block Diffusion генерирует 16 токенов параллельно за один проход |

| Верификация цели | Большая модель проверяет черновые токены по одному | Большая модель проверяет весь блок за один проход |

| Механизм принятия | Останавливается при первом несовпадении | Проверяет все токены перед фиксацией |

Ключевое отличие: и черновик, и верификация требуют только одного прямого прохода, а не N последовательных проходов.

Экспериментальные данные

Производительность Qwen3.5

| GPU | Исходная скорость | С DFlash | Ускорение |

|---|---|---|---|

| RTX 4000 Ada 20GB | ~37 токенов/с | 161.85 токенов/с | 4.31× |

| Потребительская RTX 3090 | Не опубликовано | 400+ токенов/с | До 6× |

Поддержка нескольких моделей

DFlash не ограничивается одной моделью. Подтверждённая совместимость включает:

- Qwen3.5: Основная модель для китайскоязычных сценариев

- Gemma-4-26B-A4B: Опенсорсная MoE-модель от Google

- Kimi-K2: Опенсорсная модель от Moonshot AI

- GPT OSS: Опенсорсная модель от OpenAI

Сравнение с существующими решениями

| Решение | Ускорение | Потеря точности | Сценарий использования |

|---|---|---|---|

| EAGLE-3 | Базовый | Нет | Общий |

| DFlash | До 2.5× vs EAGLE-3 | Нет | Общий |

| Спекулятивное декодирование (традиционное) | 1.5-2× | Небольшая | Специфические модели |

Версия MLX: Нативная поддержка Apple Silicon

DFlash-MLX специально оптимизирована для Apple Silicon через фреймворк MLX + кастомные Metal-ядра:

- Черновик Block Diffusion генерирует 16 токенов за один проход

- Целевая модель проверяет за один проход

- Каждый токен проверяется перед фиксацией, гарантируя нулевую потерю точности

- Уже 645+ звёзд, активное сообщество

Почему это важно сейчас

Q2 2026 — фокус конкуренции за эффективность инференса опенсорсных моделей:

- Модели становятся всё больше: Qwen3.6-35B, MiniMax M2.7 (230B) и другие продолжают расти в параметрах

- Давление на стоимость GPU: Одна карта RTX 5090 стоит ~$2000, кластеры — ещё дороже

- Требования к пользовательскому опыту растут: 400 токенов/с vs 67 токенов/с означает снижение задержки взаимодействия с 15с до 2.5с

Технологии ускорения инференса, такие как DFlash, переходят из категории «опциональная оптимизация» в «необходимая инфраструктура».

Рекомендации к действию

- Команды с GPU-серверами: Интегрируйте DFlash в существующие развёртывания для 3-6-кратного повышения пропускной способности без дополнительных затрат на оборудование

- Разработчики Apple Silicon: Попробуйте DFlash-MLX — скорость запуска больших моделей на MacBook получит качественный скачок

- Этап выбора модели: Приоритизируйте модели, проверенные с DFlash (Qwen3.5, Gemma-4, Kimi-K2), чтобы избежать проблем

- Сценарии, чувствительные к стоимости: Комбинируйте квантование (AWQ 4-bit) + DFlash — потребительские GPU могут обеспечить опыт, близкий к флагманским картам