Обучение модели с триллионом параметров на основе обучения с подкреплением — самая сложная часть не прямое вычисление, а то, как синхронизировать обновлённые веса со всеми узлами.

29 апреля 2026 года команда LMSYS опубликовала технический блог, в котором представлен новый подход к обновлению весов: P2P-передача на базе RDMA как дополнение к традиционной NCCL-трансляции.

Заголовок прямолинеен: «Обновление 1T параметров за секунды». Не преувеличение — синхронизация действительно достигнута на уровне секунд.

Почему NCCL-трансляция недостаточна

При крупномасштабном распределённом RL-обучении синхронизация весов напрямую влияет на эффективность обучения. Традиционный подход использует операцию broadcast от NCCL — один узел обновляет веса, затем транслирует всем остальным узлам.

Проблема: когда модели достигают масштаба триллиона параметров, трансляция становится瓶颈. Все узлы ждут завершения передачи одного узла.

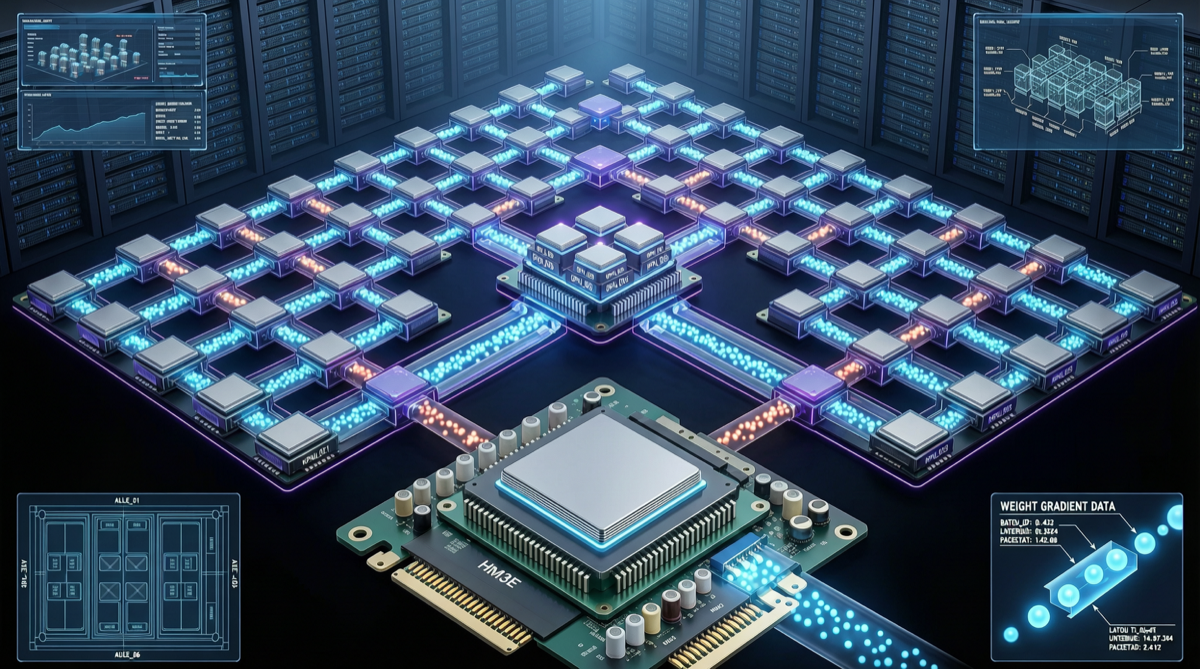

P2P-подход меняет логику: каждый узел общается только с теми узлами, которые ему нужны, а не с полной трансляцией. Использование RDMA для обхода CPU и ОС, прямой передачи данных между памятью GPU.

Что это значит на практике

Согласно описанию LMSYS, этот подход имеет несколько характеристик:

Совместимость со всеми основными моделями с открытым исходным кодом: Не пользовательская оптимизация для одной конкретной модели, а возможность на уровне фреймворка в SGLang.

Дополнение, а не замена: P2P не пытается заменить NCCL-трансляцию — он предлагает другой вариант.

Синхронизация за секунды: Обновление весов для моделей с триллионом параметров сжато с минут до секунд.

Основные источники: