训练一个万亿参数的强化学习模型,最头疼的不是前向推理,而是怎么把更新后的权重同步到所有节点。

LMSYS 团队在 4 月 29 日发布了一篇技术博客,介绍了一种新的权重更新方案——基于 RDMA 的点对点(P2P)传输,作为传统 NCCL 广播的补充。

标题很直白:「Updating 1T parameters in seconds」。不是夸张,是真做到了秒级。

为什么 NCCL 广播不够用

在大规模分布式 RL 训练中,权重的同步方式直接影响训练效率。传统方案用 NCCL 的 broadcast 操作——一个节点更新完权重,广播给所有其他节点。

问题在于:当模型达到万亿参数量级,广播会变成瓶颈。所有节点都等一个节点发完才能开始下一轮,这就是典型的树状广播的局限性。

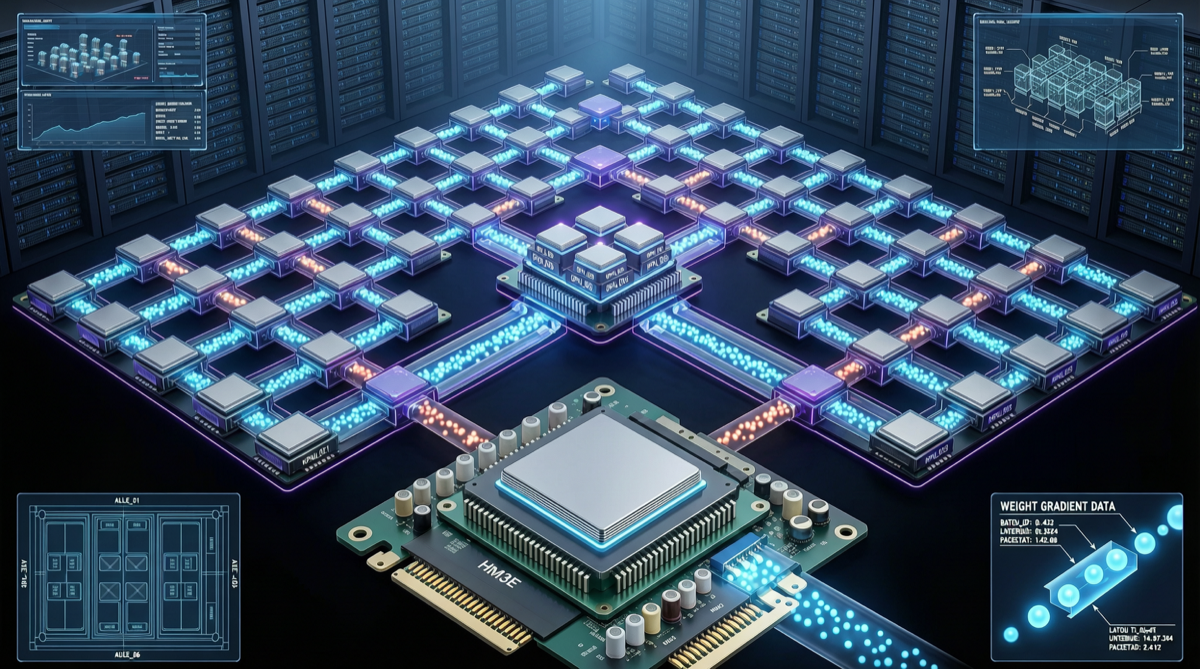

P2P 方案换了个思路:每个节点只和自己需要的节点通信,不是全量广播。用 RDMA(远程直接内存访问)绕过 CPU 和操作系统,直接在 GPU 内存之间传输数据。

类比一下:NCCL 广播像是一个人在台上讲话,所有人等他讲完;P2P 像是每个人同时和自己旁边的人交换信息,不需要排队。

实际效果

按照 LMSYS 的描述,这个方案有几个特点:

兼容所有主流开源模型:不是某个特定模型的定制优化,而是 SGLang 框架层面的通用能力。这意味着 DeepSeek-V4、Qwen 系列这些开源 MoE 模型都可以直接用。

作为补充而非替代:P2P 不是要取代 NCCL 广播,而是提供另一种选项。在不同网络拓扑、不同集群规模下,两种方案各有优劣。用户可以根据实际硬件环境选择。

秒级同步:万亿参数的权重更新从分钟级压缩到秒级。对于 RL 训练来说,这意味着每一轮迭代的时间大幅缩短,训练效率直接提升。

这个方案的价值在哪

RLHF(基于人类反馈的强化学习)已经成为大模型后训练的标准流程。从 GPT-4 到 Claude 到 Qwen,几乎每个前沿模型都用过 RL。但 RL 训练的基础设施一直是个瓶颈——尤其是当模型规模达到万亿参数时。

现有的开源 RL 训练框架(比如 Miles、veRL)在权重同步上基本都依赖 NCCL。当集群规模扩大、模型参数增加,NCCL 的广播模式就会出现明显的性能瓶颈。

LMSYS 这个 P2P 方案提供了一条不同的路径。它不是某个公司的内部优化,而是开源社区的工具。任何用 SGLang 做大规模 RL 训练的团队都可以直接用。

和 SGLang 生态的关系

SGLang 现在已经是大模型推理和训练基础设施的核心组件之一。从 Day-0 支持 DeepSeek-V4,到 GB300 上的推理优化,再到现在的 P2P 权重传输,SGLang 的定位越来越清晰:开源模型的基础设施层。

这个趋势其实挺有意思的。开源模型的能力越来越接近闭源,但基础设施一直是个短板。SGLang 在填补这个短板。

P2P 权重传输的具体技术细节——RDMA 的使用方式、拓扑优化策略、容错机制——博客里没有完全展开。不过对于已经在用 SGLang 做 RL 训练的团队来说,这个更新意味着可以直接体验到性能提升,不需要等论文发表。

主要来源: