Самый горячий AI-пост на Hacker News сегодня — не о выпуске модели, а статья-мнение: «Локальный AI должен стать нормой» (Local AI needs to be the norm). 727 очков, 342 комментария.

Этот уровень внимания сигнализирует о тренде: разработчики начинают уставать от нарратива «всё в облаке».

Пять сигналов, что локальный AI — не пустые слова

Сигнал первый: возможности вывода на потребительском оборудовании растут экспоненциально.

Qwen3.6-27B на RTX 3090, 95% SimpleQA. M4 Mac mini с 128 ГБ ОЗУ, запуск 200B параметрических моделей локально. Новый Halo Box от AMD, 128 ГБ общей памяти, от $2000 — и можно запускать большие модели.

Два года назад для этих сценариев нужны были облачные A100. Теперь ваш десктоп справляется.

Сигнал второй: локальные тулчейны созревают.

Ollama стал де-факто стандартом. llama.cpp поддерживает почти все основные модели. local-deep-research переносит глубокое исследование на локальный уровень. rapid-mlx на Mac работает в 4,2 раза быстрее Ollama.

Инструменты больше не демо-хак — они готовы к продакшену.

Сигнал третий: давление приватности и комплаенса растёт.

Закон ЕС об AI, китайский закон о безопасности данных, руководство по безопасности AI-агентов от Five Eyes — всё больше регуляций требуют локализации данных. Для здравоохранения, финансов и юриспруденции «отправка данных в облако для AI-обработки» стоит всё дороже с точки зрения комплаенса.

Локальный AI переходит из «опционального» в «обязательный».

Сигнал четвёртый: экономика начинает сходиться.

Облачные API-вызовы кажутся дешёвыми — несколько центов за раз. Но если вызывать тысячи раз в день, это сотни долларов в месяц. Разовые затраты на локальное оборудование обычно окупаются за 2-6 месяцев.

Для малых и средних команд эта математика становится очевидной.

Сигнал пятый: офлайн-работа становится необходимостью.

Разработчик на HN поделился опытом завершения клиентского проекта во время 11-часового международного рейса без сети. На локальных моделях + локальном тулчейне. Это не хвастовство — для удалённых работников и часто путешествующих разработчиков это реальная потребность.

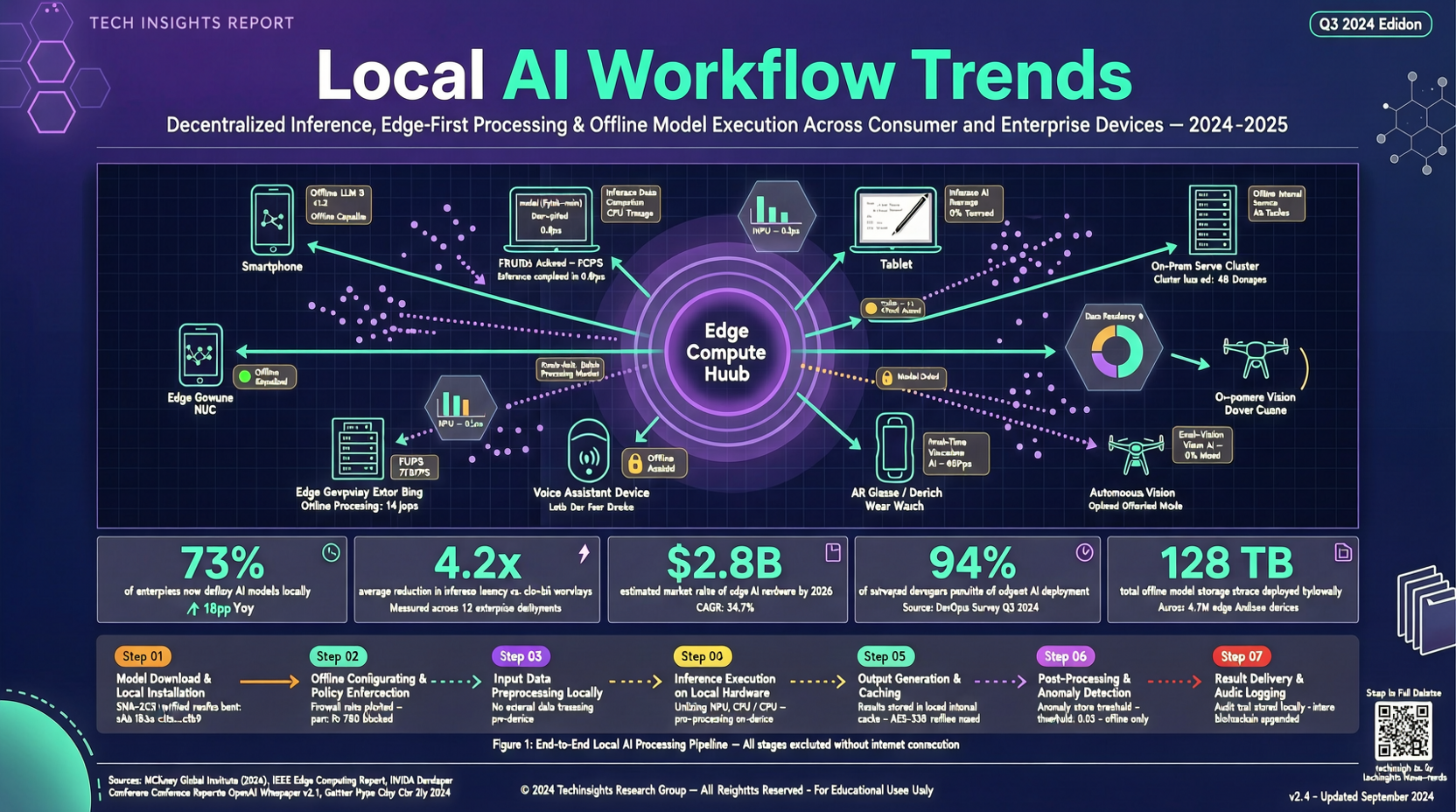

Практический локальный AI-воркфлоу

Основываясь на текущей экосистеме инструментов, реализуемый локальный AI-воркфлоу выглядит примерно так:

Базовый слой: Ollama или llama.cpp как среда выполнения моделей. Выберите открытую модель 7B-27B в зависимости от вашего оборудования.

Слой кодирования: Локальные агенты для кодирования (типа DeepSeek-TUI) или VS Code + плагин Continue. Облачный API не нужен.

Слой исследования: local-deep-research для глубокого исследования, с поддержкой поиска arXiv и PubMed.

Повседневный слой: Локальные LLM для суммаризации документов, черновиков писем, протоколов встреч. Приватность остаётся на устройстве.

Недостатки локального AI

Но не увлекайтесь энтузиазмом. У локального AI есть несколько серьёзных ограничений:

- Ограниченные возможности обучения. Вывод можно локализовать, но обучение больших моделей остаётся облачной территорией

- Доступ к последним знаниям. У локальных моделей есть дата отсечки обучающих данных; хотя поиск помогает, реальное время уступает облаку

- Мультимодальные возможности. Генерация видео, понимание изображений — эти тяжёлые задачи пока не по силам потребительскому оборудованию

- Проблемы коллаборации. Как делиться локально запущенными моделями с командой? У каждого может быть своя версия

Моя оценка

Локальный AI не заменит облачный AI. Он станет его дополнением — в одних сценариях первый выбор, в других — запасной вариант.

Для индивидуальных разработчиков и малых команд ROI локального AI начинает превышать облачный. Для сценариев, требующих последних возможностей моделей и масштабных вычислений, облако остаётся единственным выбором.

Но тренд ясен: локальный AI переходит из «игрушки гиков» в «инструмент инженеров».

Основные источники:

- Hacker News - "Local AI needs to be the norm" — Горячий пост на 727 очков

- Hacker News - "Running local models on an M4 with 24GB memory" — 165 очков

- GitHub Trending weekly — Несколько локальных AI-проектов в тренде