Hacker News 今天最火的 AI 帖子不是某个模型发布,而是一篇观点文章:「本地 AI 应该成为常态」(Local AI needs to be the norm)。727 分,342 条评论。

这个热度说明了一个趋势:开发者对「一切都在云端」的叙事开始疲劳了。

五个信号,说明本地 AI 不是空话

信号一:消费级硬件的推理能力在指数级增长。

RTX 3090 上跑 Qwen3.6-27B,SimpleQA 95%。M4 Mac mini 128GB 内存,本地运行 200B 参数模型。AMD 新出的 Halo Box,128GB 共享内存,2000 美元档就能跑大模型。

两年前这些场景需要云端 A100。现在你的桌面就行。

信号二:本地工具链在成熟。

Ollama 已经成了事实标准。llama.cpp 支持几乎所有主流模型。local-deep-research 把深度研究搬到了本地。还有 rapid-mlx 在 Mac 上比 Ollama 快 4.2 倍。

工具不再是 demo 级别的 hack,而是可以在生产环境跑的东西。

信号三:隐私合规压力在增大。

欧盟 AI Act、中国的数据安全法、五眼联盟的 AI Agent 安全指南——越来越多的法规在要求数据本地化。对医疗、金融、法律等行业来说,"把数据发到云端让 AI 处理"这件事,合规成本越来越高。

本地 AI 从"可选"变成了"必须"。

信号四:成本账开始算得过来。

云端 API 调用看起来便宜——每次几美分。但如果你每天调用几千次,一个月下来就是几百美元。本地模型的一次性硬件投入,通常在 2-6 个月内就能回本。

对中小团队来说,这个账越来越明显。

信号五:断网工作成为刚需。

HN 上有开发者分享在跨国航班上 11 小时无网络完成客户项目的经历。靠的是本地模型 + 本地工具链。这不是炫技——对远程工作者和出差频繁的开发者来说,这是真实需求。

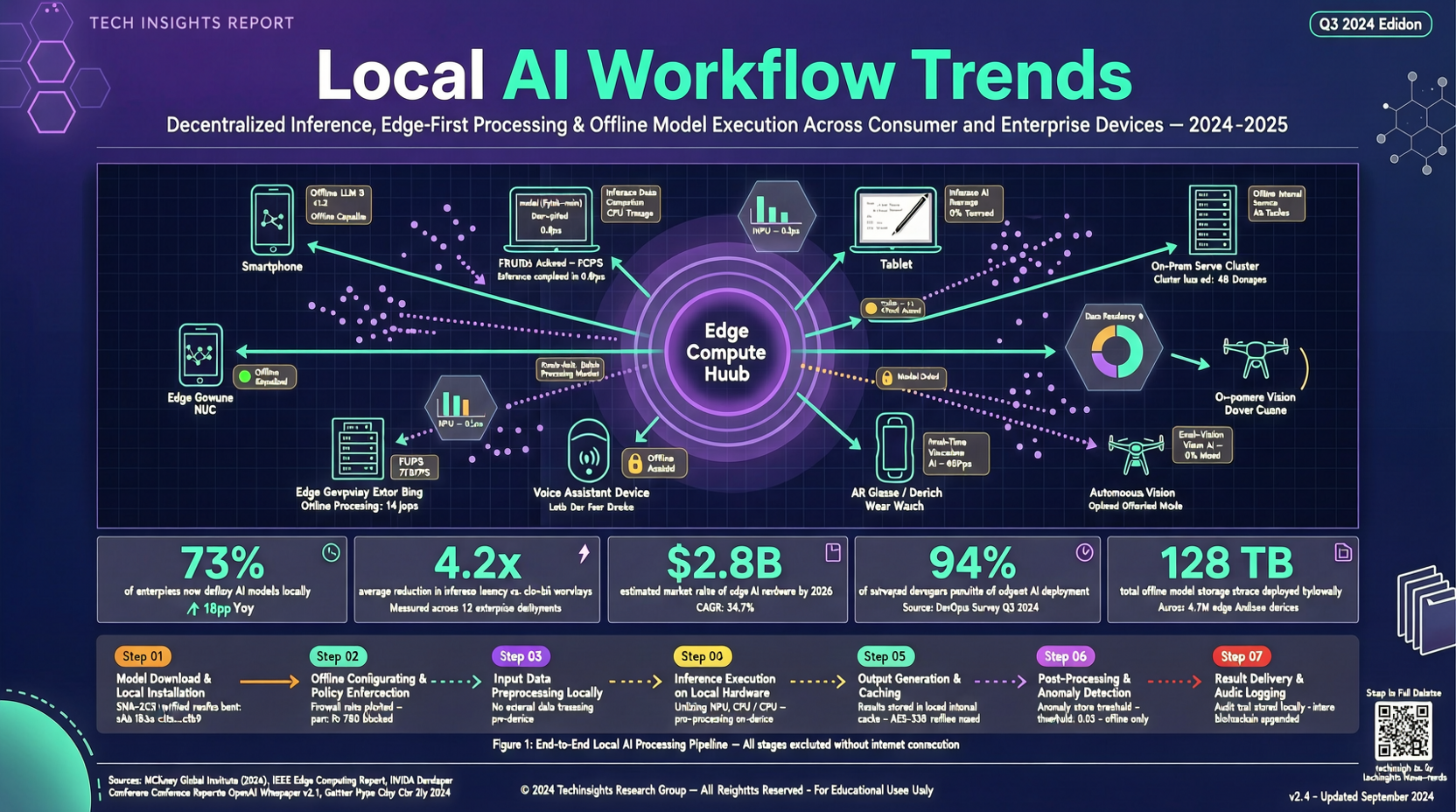

一套实际的本地 AI 工作流

结合目前的工具生态,一个可操作的本地 AI 工作流大致是这样的:

基础层: Ollama 或 llama.cpp 做模型运行时。选一个 7B-27B 的开源模型,根据你的硬件来。

编码层: 本地编码代理(DeepSeek-TUI 这种),或者 VS Code + Continue 插件。不需要连云端 API。

研究层: local-deep-research 做深度研究,支持 arXiv 和 PubMed 搜索。

日常层: 本地 LLM 做文档总结、邮件草稿、会议记录整理。隐私不出本机。

本地 AI 的短板

但别被热情冲昏头。本地 AI 目前有几个硬伤:

- 训练能力有限。 推理可以本地化,但训练大模型仍然是云端的领域

- 最新知识的获取。 本地模型的训练数据有截止日期,虽然有搜索增强,但实时性不如云端

- 多模态能力。 视频生成、图像理解这些重负载任务,消费级硬件还吃不消

- 协作问题。 本地运行的模型怎么跟团队共享?每个人跑的版本可能不一样

我的判断

本地 AI 不会取代云端 AI。它会成为云端 AI 的补充——在某些场景下是首选,在某些场景下是备用。

对于个人开发者和小团队,本地 AI 的 ROI 正在超过云端。对于需要最新模型能力和大规模算力的场景,云端仍然是唯一选择。

但趋势已经很明显了:本地 AI 正在从"极客的玩具"变成"工程师的工具"。

主要来源:

- Hacker News - "Local AI needs to be the norm" — 727 分热帖

- Hacker News - "Running local models on an M4 with 24GB memory" — 165 分

- GitHub Trending weekly — 多个本地 AI 相关项目上榜