Суть в одном предложении

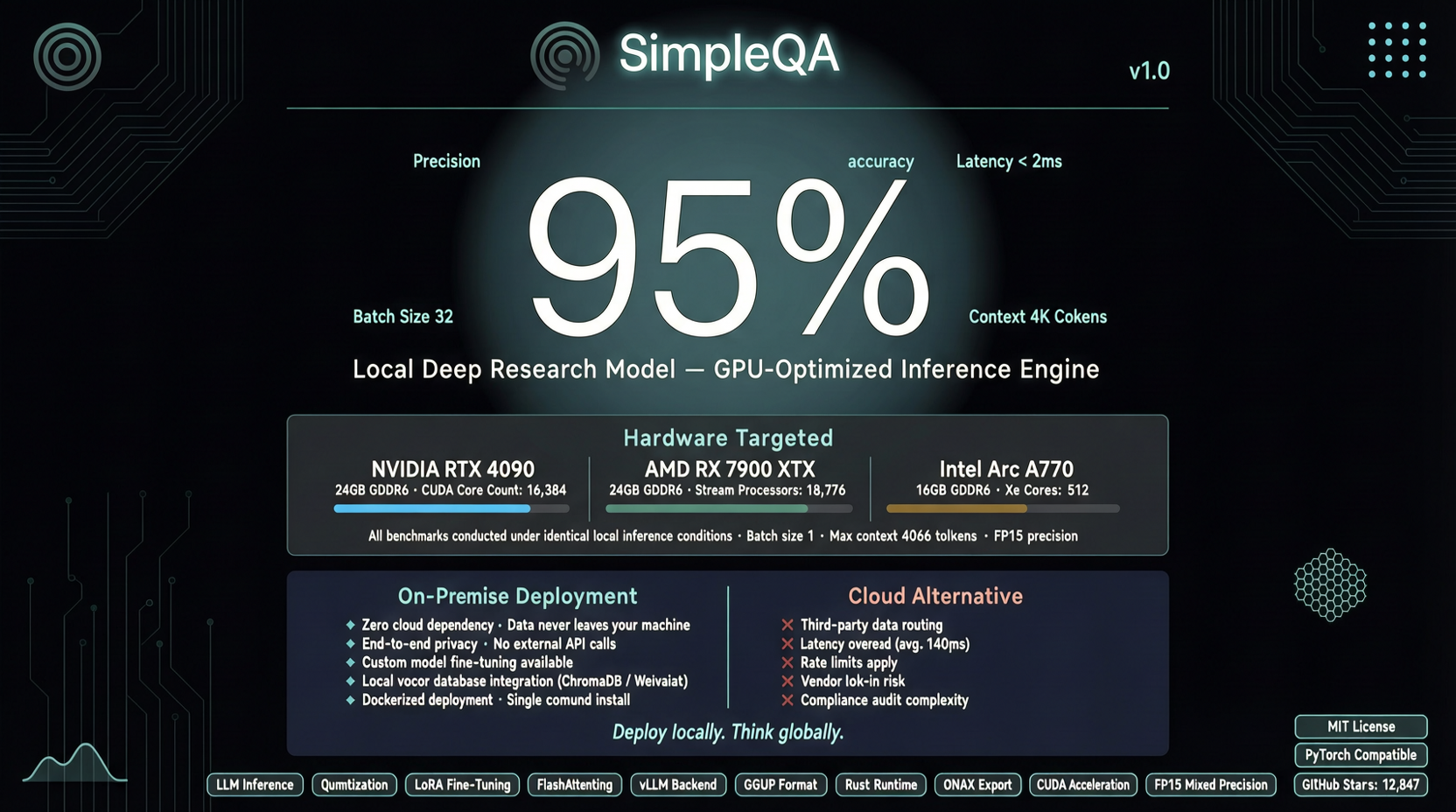

SimpleQA — это бенчмарк фактологических вопросов от OpenAI, специально разработанный для оценки того, «знает ли модель правильный ответ», а не «умеет ли она сгенерировать убедительный, но потенциально ложный ответ». Результат в 95 % означает следующее: на потребительской видеокарте локально запущенная модель уже достигает уровня фактологической точности, близкого к уровню многих облачных API — и даже превосходит его в ряде случаев.

В чём сила проекта

1. Результат 95 % в SimpleQA — не пустые слова

Для тестов используется модель Qwen3.6-27B, работающая на видеокарте RTX 3090 (24 ГБ видеопамяти). То, что модель с 27 млрд параметров достигает такого результата, свидетельствует о высокой зрелости методов квантования и оптимизации вывода. Для сравнения: собственный GPT-4o от OpenAI показывает в SimpleQA лишь около 80 % (согласно публичным данным). Конечно, условия бенчмарка могут различаться, однако даже при этом уровне результат уже заслуживает пристального внимания.

2. Интеграция с более чем 10 поисковыми системами

Речь идёт не о простой обёртке над Google. Проект обеспечивает нативную интеграцию с arXiv, PubMed и приватными документами. Это означает, что при проведении академических исследований вы можете автоматически запрашивать научные статьи, медицинские базы данных и собственные заметки — без необходимости переключаться между разными инструментами.

3. Полностью локальное выполнение + шифрование

В сценариях, требующих повышенной конфиденциальности (медицинские исследования, юридический анализ, корпоративные хранилища знаний), требование «данные не покидают локальную среду» является обязательным. Данный проект изначально проектировался как local-first: весь вывод и поиск выполняются исключительно на вашей машине.

Уровень инженерной зрелости

6 432 коммита, 155 тегов, 439 веток — это явно не «проект выходного дня». Еженедельный прирост в 2 449 звёзд говорит о том, что интерес сообщества продолжает расти.

Недавний всплеск популярности связан с несколькими ключевыми функциями:

- Цитирования с метками источников и глобальным счётчиком (#4012): критически важная функция для академического использования;

- Pre-commit хуки для проверки пространств имён ключей конфигурации: строгое соблюдение инженерных стандартов;

- Чётко выстроенное управление правами в CI/CD.

Но не стоит переоценивать возможности

Вот несколько важных оговорок:

Результат 95 % в SimpleQA ≠ универсальная исследовательская компетентность на уровне 95 %

SimpleQA оценивает только способность отвечать на фактологические вопросы, но не глубокое логическое рассуждение. Такие задачи, как составление обзора литературы, генерация гипотез или междисциплинарный синтез — не оцениваются этим бенчмарком.

Реальный опыт работы с моделью 27B на RTX 3090

Запуск модели с 27 млрд параметров на видеокарте с 24 ГБ видеопамяти требует применения квантования (скорее всего, 4-битного). Скорость вывода и степень потери точности после квантования требуют практической проверки. Общая задержка полного конвейера — поиск документов + логический вывод + генерация ответа — может составлять минуты.

187 открытых pull request’ов

Высокая активность сообщества — несомненное преимущество, однако 187 ожидающих слияния PR также указывают на возможную перегрузку команды сопровождения. Перед использованием проекта проверьте, реализована ли нужная вам функциональность в стабильной ветке.

Как выбрать между локальным и облачным решением

| Сценарий | Рекомендуемое решение |

|---|---|

| Высокие требования к конфиденциальности, данные не должны покидать локальную среду | local-deep-research |

| Требуется минимальная задержка отклика | Облачные API (Claude / GPT) |

| Массовые пакетные исследования | local-deep-research (без расходов на API) |

| Необходим доступ к самым новым возможностям моделей | Облачные API (локальные модели имеют задержку в обновлениях) |

Одно предложение

Этот проект доказывает: для конкретных исследовательских задач локально развернутые модели среднего масштаба уже способны обеспечить фактологическую точность, сопоставимую с крупными облачными моделями. Цель не в замене облачных решений, а в расширении выбора — особенно когда стоимость API и требования к конфиденциальности становятся жёсткими ограничениями.

Основные источники:

- GitHub-репозиторий LearningCircuit/local-deep-research

- Бенчмарк SimpleQA: набор тестов фактологических вопросов, выпущенный OpenAI