直接说重点

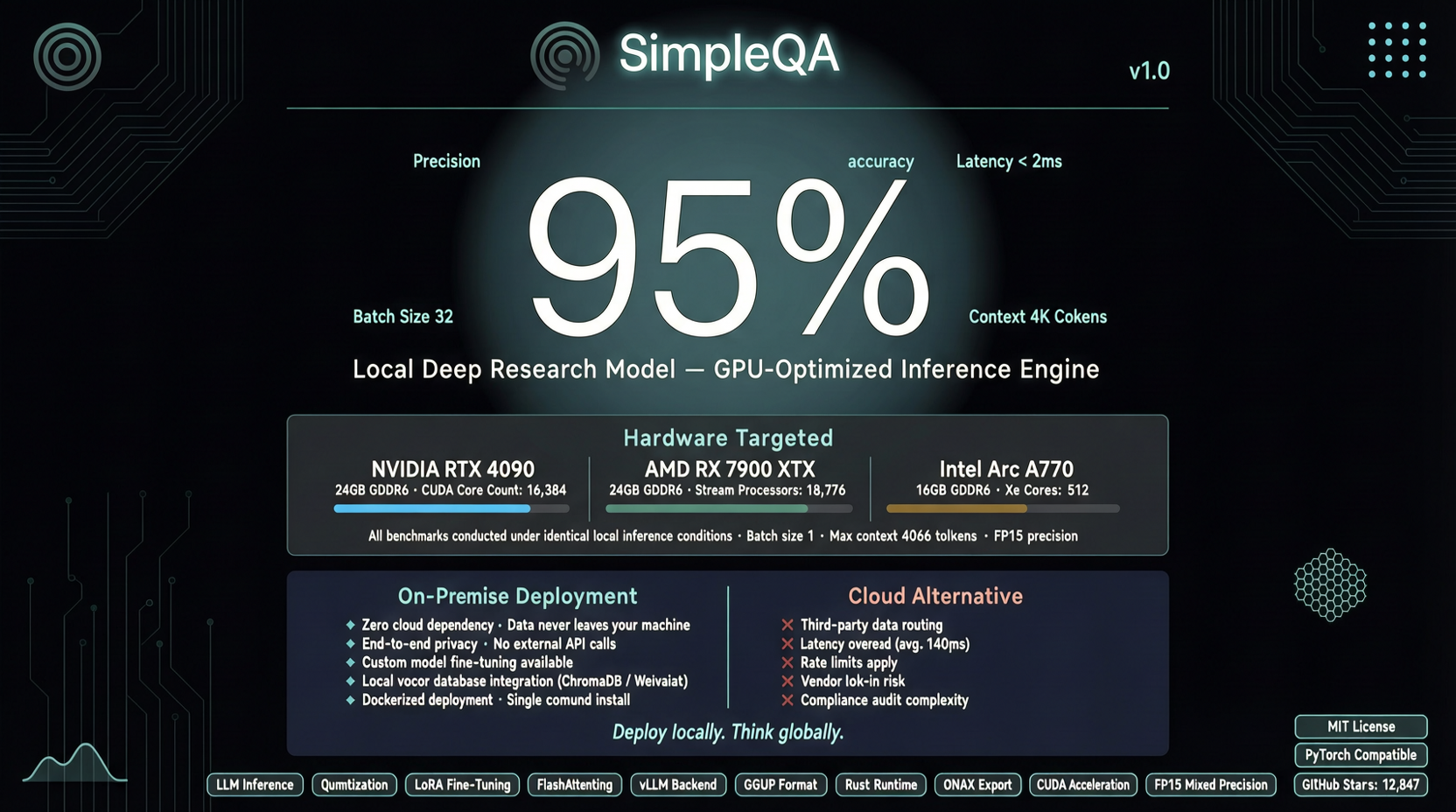

SimpleQA 是 OpenAI 出的事实性问答 benchmark,专门测模型"知不知道正确答案"而不是"能不能编一个听起来合理的答案"。95% 的成绩意味着什么?意味着在一个消费级 GPU 上,本地运行的模型在事实准确性上已经接近甚至超过很多云端 API。

项目到底强在哪

1. 95% SimpleQA 不是空口说的

项目用的是 Qwen3.6-27B,跑在 RTX 3090(24GB 显存)上。27B 参数量的模型能做到这个成绩,说明量化和推理优化已经非常成熟。对比一下:OpenAI 自己的 GPT-4o 在 SimpleQA 上也才 80% 出头(根据公开数据)。当然 benchmark 条件可能不同,但这个量级的成绩已经足够引起注意。

2. 10+ 搜索引擎集成

不是简单的 Google 搜索封装。它集成了 arXiv、PubMed、私有文档等多种数据源。这意味着做学术研究时,你可以让它自动检索论文库、医学数据库和你自己的笔记——而不需要手动切换工具。

3. 完全本地 + 加密

在隐私敏感的场景(医学研究、法律分析、企业内部知识库),数据不出本地是硬性要求。这个项目从设计上就是 local-first 的,所有推理和检索都在本地完成。

工程成熟度

6,432 个 commits、155 个 tags、439 个 branches——这不是一个 weekend project。周增 2,449 星说明社区热度还在上升。

最近的热度来自几个关键 feature:

- source-tagged citations with global counter(#4012):引用带来源标记,对学术场景很重要

- pre-commit hooks 验证 settings key namespaces:工程规范很到位

- CI/CD 权限管理完善

但也别太乐观

几个需要注意的点:

95% SimpleQA ≠ 通用研究能力 95%

SimpleQA 测的是事实性问答,不是深度推理。做文献综述、假设生成、跨领域综合分析——这些能力 SimpleQA 不测。

27B 模型在 3090 上的实际体验

24GB 显存跑 27B 模型需要量化(大概率是 4-bit)。量化后的推理速度和精度损失需要实际测试。论文检索 + 推理 + 生成的完整 pipeline 延迟可能是分钟级的。

187 个 open PRs

社区活跃度高是好事,但 187 个待合并 PR 也意味着维护者可能忙不过来。用之前看看你需要的 feature 是否已经在 stable 分支里。

和云端方案怎么选

| 场景 | 推荐方案 |

|---|---|

| 隐私敏感、数据不出本地 | local-deep-research |

| 需要最快响应速度 | 云端 API(Claude/GPT) |

| 大规模批量研究 | local-deep-research(无 API 费用) |

| 需要最新模型能力 | 云端 API(本地模型有滞后) |

一句话

这个项目证明了:对于特定的研究场景,本地部署的中等规模模型已经能够提供接近云端大模型的事实准确性。不是要替代云端方案,而是给了你多一个选择——特别是在 API 成本和隐私成为硬约束的时候。

主要来源:

- LearningCircuit/local-deep-research GitHub

- SimpleQA benchmark: OpenAI 发布的事实性问答测试集