Сдвиг, который уже происходит

В мае 2026 года пост в социальных сетях вызвал широкое обсуждение:

«Выбор ИИ-моделей в 2026 году изменился. Речь больше не о том, чтобы „выбрать сильнейшую”, а о том, чтобы „подобрать оптимальную для каждой задачи”: Кодирование/исправление багов → Claude Opus 4.7 Многошаговые рассуждения/Агент → GPT-5.5 Анализ длинных документов → DeepSeek V4-Pro (1 миллион токенов) Большой объём/экономия → DeepSeek V4-Flash В эпоху мульти-модельной маршрутизации умение orchestrировать важнее, чем умение использовать.»

Ключевое понимание этого поста: рынок моделей перешёл от «единого чемпиона» к «распределению труда по сценариям».

Почему происходит этот сдвиг?

1. Разрыв в возможностях сокращается, разрыв в ценах растёт

Когда баллы Intelligence Index у Kimi K2.6 и DeepSeek V4 Pro приближаются к GPT-5.5 (в пределах 6-8 баллов), но стоят лишь 1/10 от цены, «использовать самую дорогую» больше не является рациональным выбором.

| Сценарий | Рекомендуемая модель | Ежемесячная стоимость (интенсивное использование) |

|---|---|---|

| Генерация/ревью кода | Claude Opus 4.7 | $150-300 |

| Сложные цепочки рассуждений | GPT-5.5 | $200-500 |

| Саммаризация длинных документов | DeepSeek V4 Pro | $20-40 |

| Пакетные задачи агентов | DeepSeek V4 Flash | $5-15 |

| Китайский длинный контекст | Kimi K2.6 | $15-30 |

Выполнение комплексного рабочего процесса, включающего ревью кода, анализ документов и пакетную обработку, с использованием单一 GPT-5.5 может стоить $500+/месяц, тогда как мульти-модельная маршрутизация позволяет уложиться в $100.

2. Созревание дифференциации отечественных моделей

В 2025 году конкуренция отечественных моделей всё ещё находилась на стадии «у кого выше баллы бенчмарков». Но к 2026 году каждая компания сформировала чёткое дифференцированное позиционирование:

- Zhipu GLM-5.1: Стабильная производительность в вертикальных сценариях, таких как обработка счетов и извлечение структурированных данных, подписка $80/месяц с безлимитными вызовами

- Moonshot Kimi K2.6: Контекст в 1 миллион токенов + архитектура Agent Swarm, параллельная обработка 300 суб-агентов, идеально подходит для крупномасштабной совместной работы агентов

- DeepSeek V4 Pro: 1.6T MoE + контекст миллионного уровня, лучшее соотношение стоимости и производительности при выводе, адаптировано к чипам Huawei Ascend

- MiniMax M2.7: Механизм самоэволюции, демонстрирующий уникальные преимущества в рабочих процессах агентов

- ModelBest MiMo V2.5 Pro: 1T MoE + лицензия MIT с открытым исходным кодом, нулевой барьер для коммерческого использования

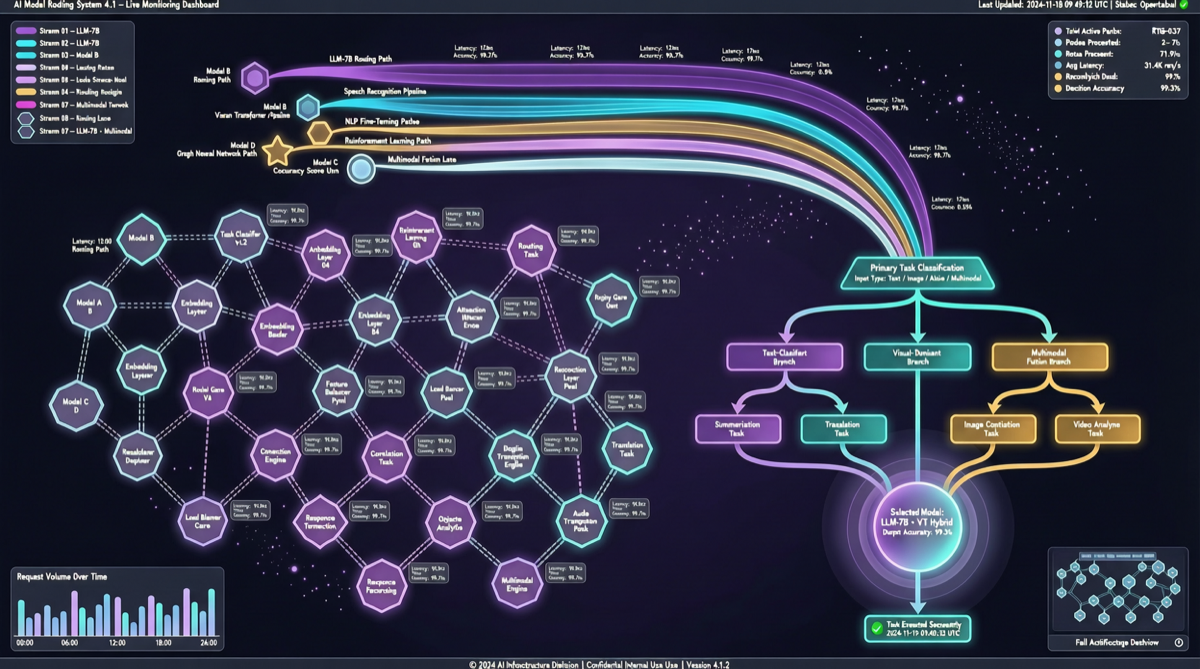

3. Фреймворки агентов упрощают мульти-модельную оркестрацию

Созревание фреймворков с открытым исходным кодом, таких как OpenClaw и Hermes Agent, сделало мульти-модельную маршрутизацию больше не инженерной проблемой. Разработчики просто указывают модель для разных задач в файле конфигурации, а фреймворк автоматически обрабатывает маршрутизацию, fallback и оптимизацию затрат.

На практике: ежедневная маршрутизация типичного разработчика

9:00 — Ревью кода

├── Задача: Проверить качество кода для 15 PR

├── Модель: Claude Opus 4.7

├── Причина: Лучшая глубина понимания кода, наименьшая частота ложных срабатываний

└── Стоимость: ~$8

11:00 — Анализ требований

├── Задача: Проанализировать 200-страничный документ требований продукта, извлечь ключевые ограничения

├── Модель: DeepSeek V4 Pro (контекст 1 миллион токенов)

├── Причина: Возможность обработки длинных документов + низкая стоимость

└── Стоимость: ~$3

14:00 — Пакетные задачи агентов

├── Задача: Сгенерировать автоматические тесты для 50 репозиториев

├── Модель: DeepSeek V4 Flash

├── Причина: Высокая пропускная способность + бесплатный лимит покрывает

└── Стоимость: ~$0

16:00 — Сложные рассуждения

├── Задача: Разработать план архитектуры системы, требуется многошаговое рассуждение

├── Модель: GPT-5.5

├── Причина: Лучшая связность в многошаговых цепочках рассуждений

└── Стоимость: ~$12

20:00 — Генерация контента на китайском

├── Задача: Создать китайскую версию документации продукта

├── Модель: Kimi K2.6

├── Причина: Понимание китайского контекста + длинный контекст

└── Стоимость: ~$2

Итого за день: ~$25

Единая модель (GPT-5.5) для эквивалентных задач: ~$120+

Экономия: примерно 80%Как построить собственную мульти-модельную маршрутизацию?

Шаг 1: Инвентаризация типов задач

| Тип задачи | Ключевое требование | Подходящие модели |

|---|---|---|

| Генерация/ревью кода | Глубина понимания кода | Claude Opus 4.7, DeepSeek V4 Pro |

| Многошаговые рассуждения | Связность цепочки рассуждений | GPT-5.5 |

| Обработка длинных документов | Большое окно контекста | DeepSeek V4 Pro, Kimi K2.6 |

| Пакетный агент | Стоимость + пропускная способность | DeepSeek V4 Flash, Kimi K2.6 |

| Китайский контент | Китайский контекст | Kimi K2.6, GLM-5.1 |

| Ежедневное общение | Скорость ответа | DeepSeek V4 Flash, GLM-5.1 |

Шаг 2: Выбор инструмента маршрутизации

- OpenClaw: Поддерживает автоматическое переключение между несколькими моделями, настраиваемые стратегии fallback

- Hermes Agent: Платформа агентов десктопного уровня, нативно поддерживает мульти-модельную маршрутизацию

- LiteLLM: Прокси-слой с открытым исходным кодом, унифицированный API-интерфейс, автоматическая маршрутизация к оптимальной модели

- Собственная маршрутизация: Простой if-else или движок правил для распределения по типу задачи

Шаг 3: Мониторинг и оптимизация

Мульти-модельная маршрутизация — это не одноразовая настройка. Еженедельная проверка рекомендуется:

- Фактическое потребление токенов каждой моделью vs бюджет

- Процент выполнения задач (не привёл ли выбор «дешёвой» модели к повторным попыткам?)

- Отзывы о удовлетворённости пользователей (в некоторых сценариях разница в возможностях ощутима)

Оценка ландшафта

Мульти-модельная маршрутизация — это не «трюк для экономии денег», это парадигмальный сдвиг.

Когда рынок моделей переходит от «один чемпион забирает всё» к «множество поставщиков сотрудничают по разделению труда», самым большим победителем становится не какой-либо отдельный поставщик моделей, а разработчики, умеющие orchestrировать модели.

Конкурентоспособность ИИ в 2026 году больше не зависит от того, какую модель вы используете, а от того, можете ли вы выбрать правильную модель, в правильное время, для правильной задачи.

Рекомендации к действию

- Индивидуальные разработчики: начните с бесплатного лимита DeepSeek V4 Flash, постепенно добавляйте Claude или GPT для критических сценариев — ежемесячные расходы можно удержать в пределах $20

- Корпоративные команды: создайте документ стратегии маршрутизации моделей, определив модели по умолчанию, fallback-модели и лимиты затрат для каждого сценария

- Выбор инструментов: отдавайте приоритет фреймворкам агентов, поддерживающим мульти-модельную маршрутизацию (OpenClaw, Hermes Agent), чтобы избежать привязки к单一 поставщику