Выводы

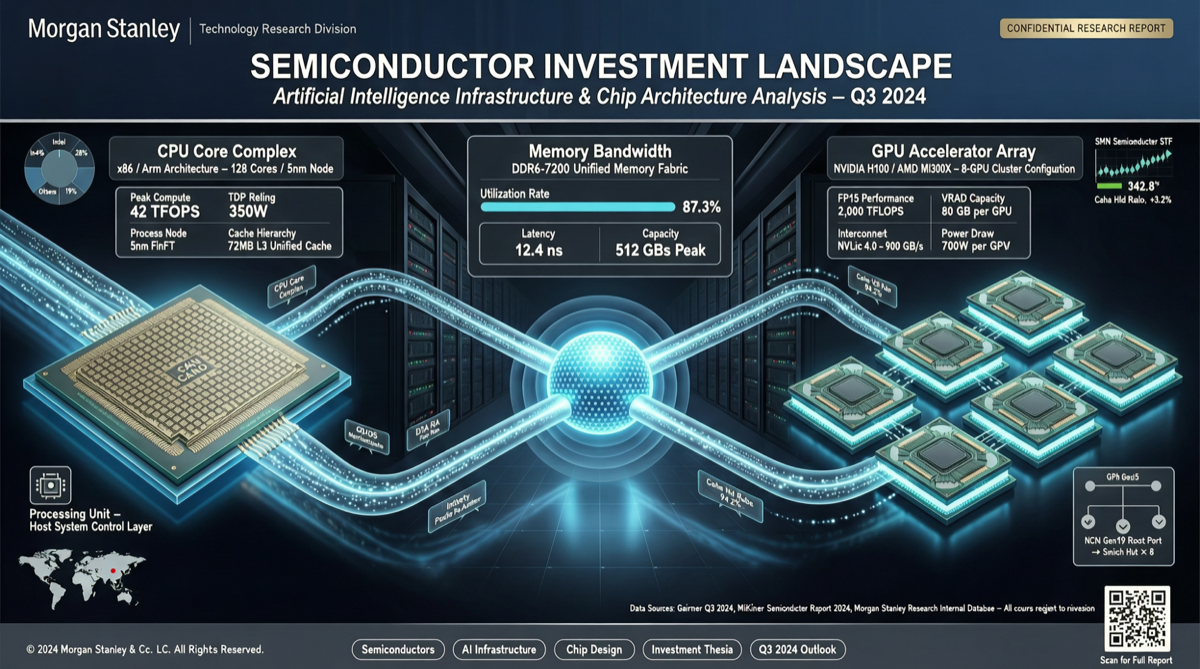

Уолл-стрит пересматривает инвестиционную логику инфраструктуры ИИ: по мере перехода ИИ от «единичного инференса» к «автономной работе» центр вычислительных потребностей смещается от GPU к CPU и памяти.

Это не просто кабинетные теории аналитиков. Контекст в миллион токенов DeepSeek V4, круглосуточная работа локальных агентов OpenClaw, ежедневное сканирование данных Gemini Daily Brief — эти сценарии использования потребляют огромные объёмы вычислительной мощности CPU и пропускной способности памяти, а не только параллельные вычислительные мощности GPU.

Ключевые тезисы отчёта

Почему эпоха агентов требует больше CPU и памяти

| Тип рабочей нагрузки | Основное оборудование | Тренд |

|---|---|---|

| Обучение моделей | GPU (NVIDIA H200/B200) | Продолжающийся рост |

| Единичный инференс (чат) | GPU | Растущий |

| Автономная работа агентов | CPU + память | Взрывной рост |

| Управление контекстом (миллион токенов) | Память | Взрывной рост |

| Локальное развёртывание моделей | CPU + память | Быстрый рост |

Ключевая логика:

- Агентам нужна непрерывная работа: В отличие от одноразовых чат-запросов, агентам необходимо постоянно мониторить, принимать решения и выполнять действия в фоновом режиме — для этого CPU должны оставаться онлайн длительное время

- Контекстные окна раздуваются: DeepSeek V4 поддерживает контекст в 1 млн токенов, который должен находиться в памяти

- Edge-инференс набирает силу: Тенденция локального развёртывания (как у OpenClaw) означает, что больше инференса происходит на CPU, а не на облачных GPU

Список компаний-бенефициаров

CPU и ускорители:

- NVIDIA (не только GPU, линейка CPU также расширяется)

- AMD (серверный CPU EPYC + ускоритель MI300)

- Intel (серверный CPU Xeon + ускоритель Gaudi)

- Arm (лицензирование архитектуры, используется практически во всех мобильных и edge AI)

Память:

- Micron (спрос на HBM и DDR5 резко растёт)

- Samsung (расширение мощностей HBM3E)

- SK hynix (лидер рынка HBM, основной поставщик NVIDIA)

Производство чипов и оборудование:

- TSMC (лидер передового процесса литейного производства)

- ASML (монополия на EUV-литографию)

Подтверждающие данные

Несколько ключевых данных подтверждают этот тренд:

- DeepSeek V4: контекст в 1 млн токенов означает, что каждый разговор требует примерно 2 ГБ памяти для хранения состояния контекста

- OpenClaw: 320 тысяч звёзд на GitHub, в основном развёрнут на персональных устройствах (преимущественно CPU-инференс)

- Huawei Ascend: ожидаемый доход от AI-чипов в 2026 году — $12 млрд, большая часть — в архитектурах CPU-сопроцессор

Оценка ландшафта

Влияние на NVIDIA

NVIDIA остаётся абсолютным гегемоном AI-чипов, но этот отчёт напоминает нам:

- Ров NVIDIA находится в обучении на GPU

- На стороне работы агентов (CPU + память) доля рынка NVIDIA не столь доминирующа, как в обучении

- Grace CPU + BlueField DPU от NVIDIA — это стратегия ответа, но она всё ещё на ранних стадиях

Возможности для AMD и Intel

- Комбинация EPYC + MI300 от AMD имеет преимущество в стоимости на стороне инференса

- Ускоритель Gaudi 3 от Intel захватывает часть рынка инференса

- Обе компании делают ставку на концепцию «AI PC» — локальный CPU-инференс является ключевым аргументом продаж

Влияние на компании памяти

HBM (память с высокой пропускной способностью) — самая определённая история роста полупроводников 2025-2026 годов:

- SK hynix лидирует в HBM3E

- Samsung догоняет

- Выход HBM у Micron улучшается

Рекомендации к действию

- Инвесторы: если вы держите только NVIDIA, рассмотрите распределение в акции памяти и CPU помимо GPU, чтобы диверсифицировать инвестиционные риски в вычислениях в эпоху агентов

- Разработчики: локальное развёртывание агентов (как OpenClaw) требует гораздо больше CPU и памяти, чем ожидалось — не смотрите только на GPU при выборе оборудования

- Специалисты чиповой индустрии: оптимизация чипов для инференса агентов (ускорение CPU-инференса, оптимизация пропускной способности памяти) может стать следующей технологической горячей точкой