Заключение

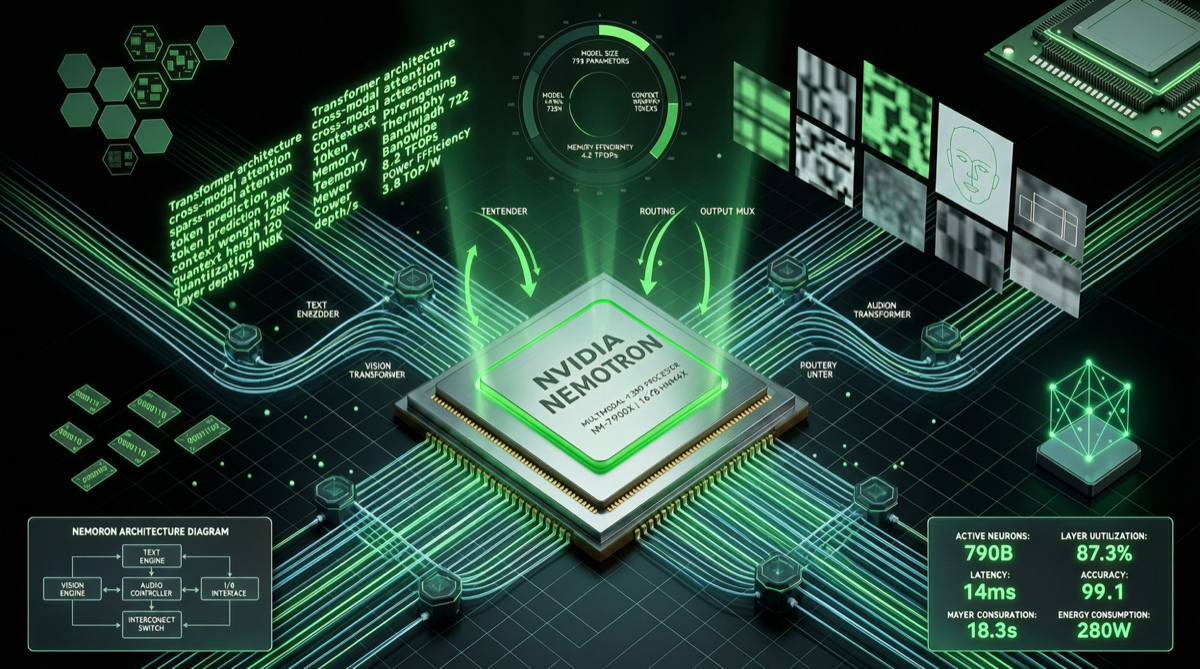

NVIDIA официально выпустила серию открытых AI-моделей Nemotron 3 29 апреля — включающую три масштаба: Nano, Super и Ultra. Версия Nano Omni привлекает наибольшее внимание: мультимодальная (текст + изображение), оптимизированная для агентов, запускаемая на потребительских GPU.

Сигнал от этого релиза предельно ясен: разработка AI Agent-приложений требует специализированных моделей, и универсальные LLM больше не достаточны.

Серия Nemotron 3: полный обзор

| Модель | Позиционирование | Особенности | Целевые сценарии |

|---|---|---|---|

| Nano Omni | Лёгкая мультимодальная | Мультимодальный ввод/вывод, оптимизация FP8 | Разработка агентов, периферийное развёртывание |

| Super | Средний масштаб | Баланс производительности и стоимости | Корпоративные приложения |

| Ultra | Флагманская | Наивысшая точность и глубина рассуждений | Сложные цепочки задач агентов |

Технические особенности Nano Omni

1. Мультимодальная поддержка

Ключевое преимущество Nano Omni — одновременное понимание и генерация текста и изображений. Это означает, что агент может:

- Понимать скриншоты пользователей и реагировать на них

- Генерировать визуальные результаты (графики, диаграммы)

- Свободно переключаться между текстовым и визуальным рассуждением

Для сценариев агентов, требующих мультимодального взаимодействия (обслуживание клиентов, ревью кода, анализ данных), это жёсткая необходимость.

2. Глубокая оптимизация FP8-инференса

Новая модель глубоко оптимизирована для FP8-инференса на архитектурах Hopper и Blackwell. FP8 может почти удвоить пропускную способность инференса по сравнению с FP16, одновременно сокращая потребление VRAM вдвое.

Что ещё важнее, она также совместима с потребительскими видеокартами RTX 5090 и робототехнической платформой Jetson Thor. Это означает:

- Индивидуальные разработчики могут запускать мультимодальных агентов на RTX 5090

- Робототехнические сценарии могут выполняться локально на Jetson Thor

3. Нативная дизайн для агентов

В отличие от универсальных LLM, серия Nemotron 3 с самого начала была спроектирована для сценариев Agent-приложений:

- Оптимизация вызова инструментов: Специализированное обучение форматам и точности function calling

- Стабильность многораундовых диалогов: Способность следовать инструкциям в длинных разговорах значительно превосходит универсальные модели

- Цикл рассуждение-действие: Оптимизация под специфический для агентов цикл «наблюдение → рассуждение → действие → наблюдение»

Стратегия NVIDIA

Логика NVIDIA в этом вопросе предельно ясна:

- Агенты — это следующая волна AI-приложений — требующая специализированных моделей

- Специализированные модели нуждаются в специализированной аппаратной оптимизации — Nemotron + NVIDIA GPU это оптимальная комбинация

- Открытый код может установить стандарты экосистемы — точно так же, как CUDA сделала это для GPU-программирования

Этот релиз с открытым кодом по сути определяет референсную архитектуру для AI Agent-моделей — в будущем, когда третьи стороны будут разрабатывать агентов, Nemotron, вероятно, станет моделью «по умолчанию».

Практическое влияние на разработчиков агентов

Если вы разрабатываете агентов с помощью фреймворков Hermes Agent, OpenClaw или LangChain:

- Преимущество по стоимости: Модели уровня Nano означают радикальное снижение стоимости API-вызовов (или почти нулевую предельную стоимость при развёртывании на собственном GPU)

- Мультимодальная способность: Нет необходимости связывать несколько моделей (одну для зрения, одну для текста) — Nano Omni справляется со всем в одной модели

- Локальное развёртывание: Совместимость с потребительскими GPU делает «локальных агентов» по-настоящему жизнеспособными

Связь с конкуренцией больших моделей

Тайминг релиза Nemotron 3 весьма интересен — он практически совпадает с окнами релизов OpenAI GPT-5.5 и DeepSeek V4.

Предыдущий этап конкуренции больших моделей по сути был борьбой за «потолок способностей». Вступая в 2026 год, фокус конкуренции смещается в сторону «эффективности приложений» и «стоимости развёртывания».

Стратегия NVIDIA умна: вместо прямой конкуренции с OpenAI/Anthropic по универсальной способности моделей, они открывают новое поле боя на уровне Agent-приложений, создавая ров через открытый код + аппаратную привязку.

Возможности для китайских моделей

Китайские модели (Qwen, DeepSeek, GLM) уже догнали или превзошли многие западные модели по универсальным способностям, но в нишевом треке специализированных Agent-моделей раскладка ещё недостаточно плотная.

Если отечественные компании-разработчики моделей смогут продвинуться в следующих направлениях, они могут сформировать дифференцированное преимущество:

- Оптимизация под китайские Agent-сценарии: Специфические отечественные сценарии применения (государственное управление, финансы, электронная коммерция) требуют специализированных обучающих данных

- Адаптация к отечественным чипам: Nemotron глубоко привязан к аппаратному обеспечению NVIDIA; комбинация китайских моделей + отечественных чипов (Muxi, Hygon и др.) имеет стратегическую ценность

- Экосистема сообщества открытого кода: Следуя стратегии открытого кода Nemotron для установления отечественных стандартов открытого кода для Agent-моделей

Одним словом

Релиз NVIDIA Nemotron 3 с открытым кодом сигнализирует о том, что AI Agent-модели официально стали новым треком, отдельным от универсальных LLM — и конкурентные измерения на этом треке уже сместились от «кто умнее» к «кто эффективнее, дешевле и проще в развёртывании».