Главный вывод

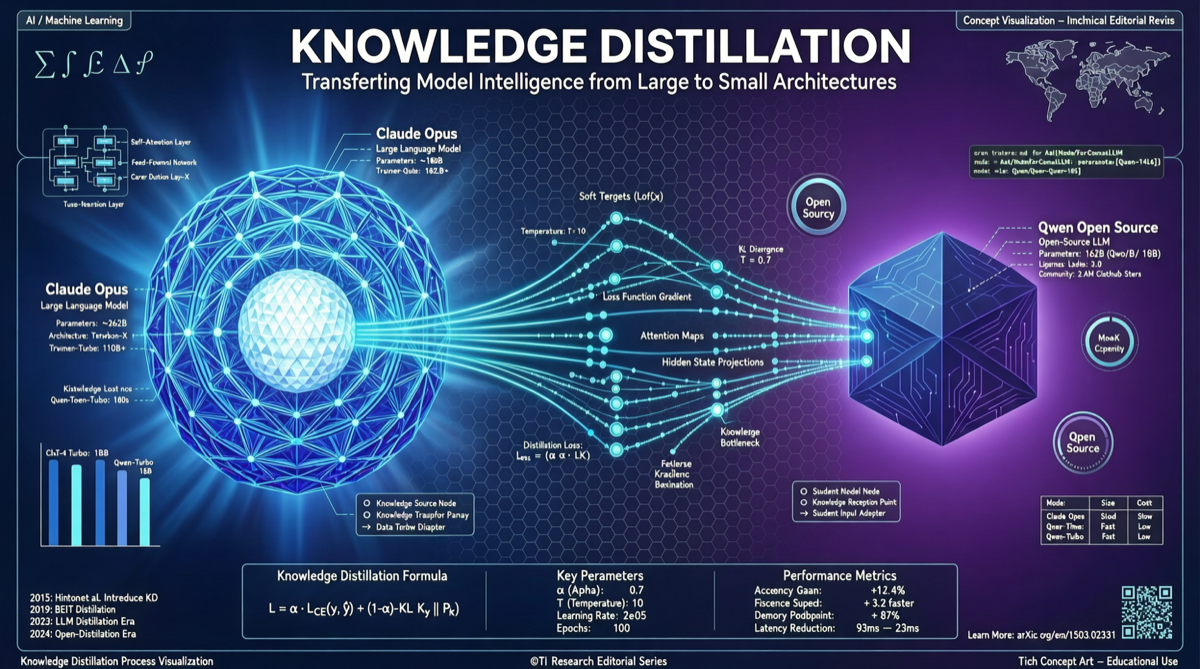

Разработчик сообщества HuggingFace Jackrong выпустил дистиллированную версию Qwen3.6 35B A3B, дистиллированную с использованием выводов рассуждений Claude Opus. Размер файла модели составляет 71.9 ГБ, квантованная версия GGUF выйдет в ближайшее время.

Что это означает: сообщество использует данные рассуждений закрытых флагманских моделей для «питания» открытых моделей, позволяя открытым моделям приблизиться к закрытым флагманам по способности рассуждать. Паттерн «дистилляция, дистилляция, дистилляция» становится основным путём для open-source сообщества в погоне за закрытыми моделями.

Разбор технической архитектуры

Базовая архитектура

| Параметр | Информация |

|---|---|

| Базовая модель | Qwen3.6 35B A3B (архитектура MoE) |

| Источник дистилляции | Выводы рассуждений Claude Opus |

| Размер модели | 71.9 ГБ (FP16) |

| Издатель | Jackrong (известный автор дистиллированных моделей в HF-сообществе) |

| Платформа | HuggingFace |

| Квантованная версия | GGUF скоро выйдет |

Почему Qwen3.6 35B A3B?

Qwen3.6 35B A3B — это модель архитектуры MoE (Mixture of Experts) со следующими характеристиками:

- Общее количество параметров: 35B

- Активные параметры: ~3B (A3B = Active 3 Billion)

- Высокая эффективность вывода: Активирует только 3B параметров во время выполнения, скорость сопоставима с маленькими моделями

- Большая ёмкость знаний: 35B общих параметров означает хранение значительного объёма знаний

Дистилляция данных рассуждений Claude Opus в эту архитектуру — это как поставить «флагманский двигатель» в «быстрое шасси».

Методология дистилляции

Данные рассуждений Claude Opus (Учитель)

↓

Генерация высококачественных цепочек рассуждений

↓

Qwen3.6 35B A3B (Ученик)

↓

Изучение паттернов рассуждений + Перенос знаний

↓

Дистиллированная открытая модельКлючевые преимущества этого подхода дистилляции:

- Без утечки весов Claude: Дистиллируются только выводы, не внутренние параметры модели

- Способность рассуждений переносима: Цепочечные рассуждения, планирование и рефлексия Claude Opus могут быть переданы через дистилляцию

- Экономическая эффективность: Одноразовые данные рассуждений в обмен на постоянно используемую открытую модель

Сравнительный анализ

| Параметр | Оригинальный Qwen3.6 35B | Дистиллированный (данные Opus) | Claude Opus 4.6 |

|---|---|---|---|

| Масштаб параметров | 35B (3B активные) | 35B (3B активные) | Закрыто, оценочно сотни B |

| Способность рассуждений | Нативная Qwen | Интегрированные паттерны Opus | Флагманский уровень |

| Скорость вывода | Быстрая (3B активные) | Быстрая (3B активные) | Зависит от API |

| Открытый код | ✅ | ✅ | ❌ |

| Локальное развёртывание | ✅ | ✅ | ❌ |

| Стоимость | Бесплатно | Бесплатно | Оплата за токен |

Руководство по началу работы

Требования к оборудованию

| Конфигурация | Рекомендуемая настройка |

|---|---|

| Минимальная | 24 ГБ VRAM (требуется квантование GGUF Q4) |

| Рекомендуемая | 48 ГБ VRAM (GGUF Q8 или FP16 частичные слои) |

| Идеальная | 80 ГБ VRAM (A100/H100, FP16 полная точность) |

| Mac | 96 ГБ+ унифицированная память (M2/M3 Max) |

Ожидаемые варианты использования

- Улучшенный локальный вывод: Получение уровня рассуждений, близкого к Opus, на потребительском оборудовании

- Базовая модель для агентов: Ядро рассуждений для автономных агентов

- База для вторичной дистилляции: Может быть далее дистиллирована в меньшие модели (7B, 14B)

- База для файн-тюнинга: SFT для конкретных доменов поверх дистилляции

Оценка рыночной ситуации

Эта дистиллированная модель представляет собой явную тенденцию: open-source сообщество стремительно сокращает разрыв в способностях, «дистиллируя выводы закрытых флагманов».

Jackrong уже реализовал несколько успешных проектов дистилляции ранее. Выбор Qwen3.6 35B A3B в качестве базы указывает на то, что эта архитектура MoE быстро набирает признание в сообществе. Для сценариев, требующих мощного локального развёртывания рассуждений, это вариант, за которым стоит следить.