Методы обучения языковых моделей (ЯМ) переживают период интенсивной эволюции.

После DPO (Direct Preference Optimization — прямая оптимизация предпочтений) и RLVR (Reinforcement Learning with Verifiable Rewards — обучение с подкреплением на основе проверяемых вознаграждений) команда Tencent Hunyuan опубликовала на платформе Hugging Face Daily Papers новую научную статью, в которой представлена Listwise Policy Optimization (LPO) — метод, набравший 57 голосов «за».

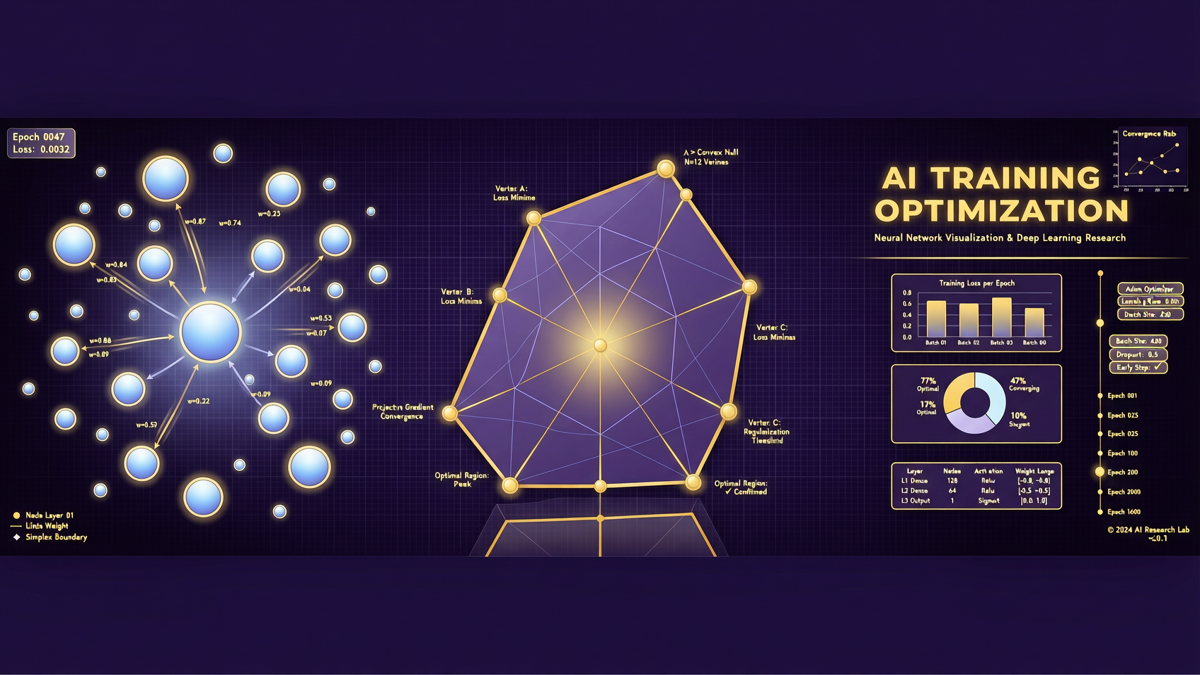

Основной вклад этой работы можно кратко выразить математически: оптимизация стратегии ЯМ в рамках обучения с подкреплением формулируется как задача проекции целевого распределения на симплекс ответов модели (Response Simplex).

Это звучит весьма академично, однако за формулой стоит чёткая и интуитивно понятная идея.

От pointwise к listwise: почему это принципиально важно

Современные подходы к обучению ЯМ с подкреплением в основном реализуются по pointwise-схеме:

- Модели подаётся запрос (prompt);

- Модель генерирует один ответ (response);

- Стратегия корректируется на основе оценки этого ответа, полученной от модели вознаграждения.

Таким образом, на каждом шаге обрабатывается лишь одна пара (prompt, response).

Однако при оценке качества ответов человек действует иначе. Сравнивая два варианта ответа, мы не присваиваем каждому из них независимую оценку, а затем не сравниваем эти оценки — мы непосредственно сопоставляем ответы друг с другом. Именно так работает подход listwise.

Метод LPO от Tencent Hunyuan основан именно на этом различии. Вместо того чтобы оптимизировать вероятность каждого отдельного ответа, LPO рассматривает несколько ответов, сгенерированных моделью на один и тот же запрос, как единую группу, и выполняет оптимизацию на пространстве их совместного распределения вероятностей — то есть на «симплексе ответов».

Что такое «симплекс ответов»

Симплекс (simplex) — это математическое понятие: множество точек, координаты которых неотрицательны и в сумме равны единице.

Применив его к ЯМ: для заданного запроса модель может сгенерировать множество различных ответов, каждый из которых имеет определённую вероятность. Сумма вероятностей всех возможных ответов равна единице — это и есть «симплекс ответов».

Идея LPO состоит в следующем: вместо прямой оптимизации вероятности отдельного ответа на симплексе определяется «целевое распределение», а текущее распределение стратегии проецируется на него.

Этот взгляд обладает важным преимуществом: он естественным образом поддерживает оптимизацию на уровне группы. Это позволяет явно задавать относительные предпочтения между ответами (например, «A лучше B», «B лучше C»), а не ограничиваться абсолютными оценками («A — 8 баллов», «B — 6 баллов»).

Связь с DPO и RLVR

У DPO и RLVR имеются как сильные стороны, так и ограничения:

- DPO: не требует отдельной модели вознаграждения и обучается напрямую на парах предпочтений. Однако он исходит из предположения о независимости предпочтений и игнорирует глобальные взаимосвязи между ответами.

- RLVR: использует проверяемые функции вознаграждения в рамках обучения с подкреплением, что обеспечивает высокую эффективность, но требует тщательной разработки функции вознаграждения.

LPO стремится объединить лучшее из обоих подходов:

- Как и DPO, LPO не требует явной модели вознаграждения — предпочтения кодируются неявно через целевое распределение;

- Как и RLVR, LPO поддерживает гибкое задание целей оптимизации — изменяя форму целевого распределения.

Вместе с тем вычислительная сложность LPO выше. Проекция на симплекс значительно сложнее, чем стандартное pointwise-обновление градиентов, особенно при большом количестве возможных ответов.

Практическое значение

Если LPO продемонстрирует свою эффективность при масштабном обучении, он может стать новым инструментом в арсенале методов обучения ЯМ.

Особенно перспективным он выглядит для сценариев, где требуется тонкое моделирование предпочтений, например:

- многоходовые диалоги;

- генерация кода (когда существует несколько корректных решений, различающихся по качеству);

- креативное письмо.

В таких случаях listwise-подход оказывается более естественным, чем pointwise.

Однако масштаб экспериментальной проверки в текущей работе пока недостаточен. В области обучения ЯМ распространена проблема: методы, показавшие отличные результаты на малых моделях и небольших наборах данных, зачастую теряют эффективность при переходе к моделям с миллиардами параметров и тренировке на триллионах токенов.

Сигнал общего тренда

С более широкой точки зрения LPO отражает ключевой тренд в развитии методов обучения ЯМ: смещение фокуса с вопроса «как оценить отдельный ответ?» на вопрос «как структурированно упорядочить группу ответов?»

Этот тренд проявляется в нескольких направлениях:

- DPO заменяет абсолютные оценки на пары предпочтений;

- GroupRelative Policy Optimization (GRPO) основана на относительном сравнении внутри группы;

- LPO осуществляет глобальную оптимизацию через проекцию на симплекс.

Если этот тренд сохранится, будущее обучения ЯМ будет всё больше напоминать обучение ранжированию (Learning to Rank), а не классическое обучение с подкреплением.

Основные источники:

- Hugging Face Daily Papers — 11 мая 2026 г.

- Tencent Hunyuan, «Listwise Policy Optimization: Group-based RLVR as Target-Projection on the LLM Response Simplex»