LLM 的训练方法正在经历一波密集迭代。

继 DPO(Direct Preference Optimization)和 RLVR(Reinforcement Learning with Verifiable Rewards)之后,腾讯混元团队在 Hugging Face Daily Papers 上发表了一篇新论文,提出了 Listwise Policy Optimization(LPO),57 upvotes。

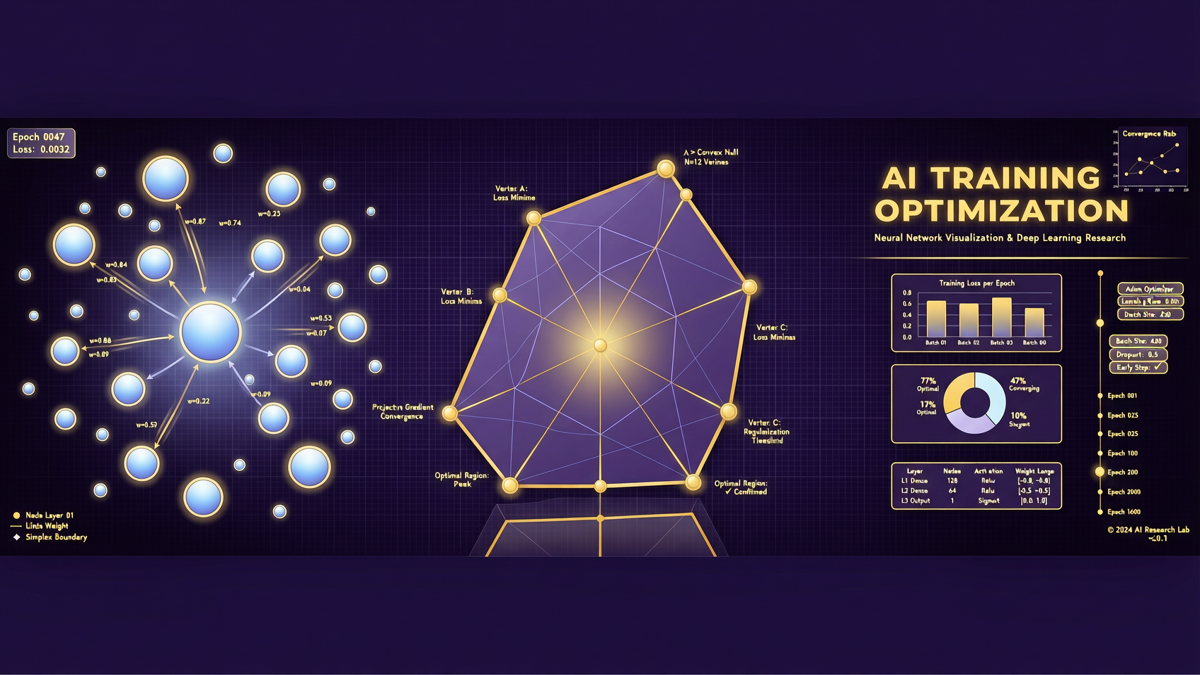

这篇论文的核心贡献可以用一个数学表述概括:把 LLM 的强化学习策略优化,建模为在 LLM 响应单纯形(Response Simplex)上的目标投影问题。

听起来很学术,拆开来说其实有一个很清晰的直觉。

从 Pointwise 到 Listwise:为什么这很重要

现在的 LLM 强化学习训练,主流做法是 pointwise 的:

- 给模型一个 prompt

- 模型生成一个 response

- 根据 reward model 的评分更新策略

每次只处理一个 (prompt, response) 对。

但人类做判断的时候不是这样的。当你要评价两个答案哪个更好时,你不是分别给它们打分然后比较——你是把它们放在一起,直接比较。这就是 listwise 的思路。

腾讯混元的 LPO 正是抓住了这个区别。它不再单独优化每个 response,而是把同一 prompt 的多个 response 当作一组来处理,在这组 response 的概率分布(即"响应单纯形")上做优化。

"响应单纯形"到底是什么

单纯形(Simplex)是数学里的一个概念。在一个单纯形上,所有点的坐标之和等于 1。

把它套到 LLM 上:对于一个给定的 prompt,模型可能生成很多不同的 response。每个 response 有一个概率。所有这些 response 的概率加起来等于 1——这就是"响应单纯形"。

LPO 的思路是:不直接优化单个 response 的概率,而是在整个单纯形上定义一个"目标分布",然后让策略分布向目标分布"投影"。

这个视角的妙处在于:它天然支持 group-level 的优化。你可以在一组 response 之间建立相对关系(A 比 B 好,B 比 C 好),而不是只能做绝对评分(A 是 8 分,B 是 6 分)。

跟 DPO、RLVR 的关系

DPO 和 RLVR 各有优缺点:

- DPO:不需要 reward model,直接用偏好对训练。但它假设偏好是独立的,忽略了 response 之间的全局关系

- RLVR:用可验证的 reward 做强化学习,效果好但需要设计 reward 函数

LPO 试图融合两者的优点:

- 像 DPO 一样,不需要显式的 reward model(通过目标分布隐式编码偏好)

- 像 RLVR 一样,支持灵活的优化目标(通过改变目标分布的形状)

但 LPO 的计算复杂度更高。在单纯形上做投影比 pointwise 的梯度更新要复杂得多,特别是在 response 数量多的时候。

实际影响

如果 LPO 能证明在大规模训练上的有效性,它可能会成为 LLM 训练工具箱里的一个新选项。

特别是对于那些需要 fine-grained 偏好建模的场景——比如多轮对话、代码生成(多个正确但有优劣之分的方案)、创意写作——listwise 的方法可能比 pointwise 更自然。

但论文目前的验证规模还需要更大。LLM 训练领域的一个常见问题是:在小模型、小数据集上有效的方法,到了千亿参数、万亿 token 的尺度上不一定还有效。

一个趋势信号

从更大的视角看,LPO 代表了 LLM 训练方法的一个趋势:从"如何给单个输出打分"转向"如何在一组输出之间建立结构化的偏好关系"。

这个趋势在几个方向上都有体现:

- DPO 用偏好对代替绝对评分

- GroupRelative Policy Optimization(GRPO)用组内相对比较

- 现在 LPO 用单纯形投影做全局优化

如果这个趋势继续发展,未来 LLM 的训练可能会更像"排序学习"(Learning to Rank),而不是传统的强化学习。

主要来源:

- Hugging Face Daily Papers - May 11, 2026

- Tencent Hunyuan, "Listwise Policy Optimization: Group-based RLVR as Target-Projection on the LLM Response Simplex"