即使上下文窗口突破百万 token,研究仍然显示:填得越满,模型输出质量越低。

这就是所谓的 context rot(上下文腐烂)。关于这个问题的深度分析,可以看看我们之前的文章 100 万 Token 上下文的真正瓶颈不是技术,是算力——限制大模型的不只是技术,还有算力成本。

开发者面对一个两难选择:全部塞进去,看着质量下降;激进裁剪,又可能丢掉 Agent 后续需要的关键信息。关于 AI Agent 记忆管理的系统性讨论,也可见 AI Agent 的”上下文失忆”困局。

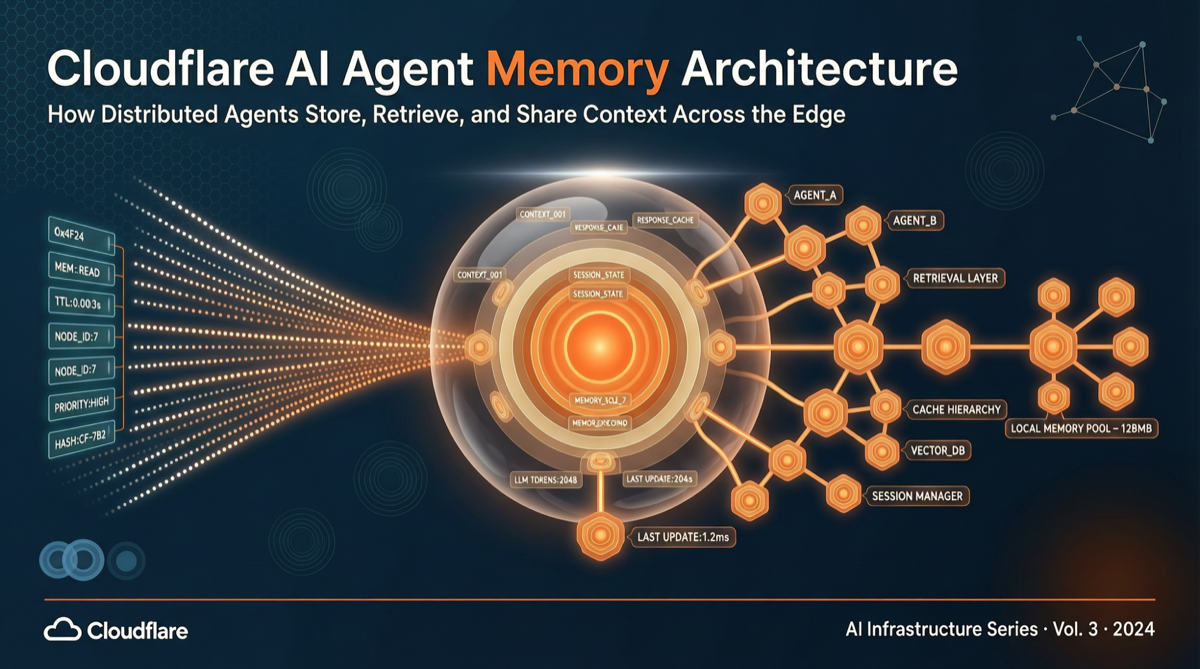

Cloudflare 在 4 月底的 Agent Week 中发布了一项新产品:Agent Memory(私测),试图从根本上解决这个问题。关于 Agent Week 的整体产品矩阵,我们在 Cloudflare 全面开放 Agent 自主注册 中有更全面的介绍。Agent Memory 不是把对话历史一股脑塞进上下文窗口,而是从对话中提取结构化记忆,按需检索只取相关部分。

“我们构建 Agent Memory 是因为平台上的真实工作负载暴露了现有方案无法完全解决的缺口。运行数周甚至数月、面对真实代码库和生产系统的 Agent,需要的是随着增长仍然有用的记忆,而不仅仅是在干净的基准数据集上表现良好的记忆。” —— Tyson Trautmann & Rob Sutter, Cloudflare 工程团队

提取管道:两遍扫描 + 八步验证

Agent Memory 的入站流程设计得相当精细。

每条消息首先获得一个内容寻址的 SHA-256 ID,支持幂等重新摄入——重复发送同样的消息不会生成冗余记录。

提取器运行两个并行通道:

- 广度扫描:按约 1 万字符分块,抓取整体语义

- 细节扫描:聚焦具体数值——名字、价格、版本号等

之后一个验证器会跑八项检查,只有通过的消息才被分类为四种记忆类型:

- Facts(事实):键值对形式,按标准化主题索引

- Events(事件):时间线相关的活动记录

- Instructions(指令):行为规则,新记忆覆盖而非删除旧版

- Tasks(任务):待办事项

默认使用 Llama 4 Scout(17B MoE) 做提取和分类,Cloudflare 发现更大的模型在这个阶段并没有明显优势。

检索架构:五通道并行 + RRF 融合

真正有意思的是检索侧。Agent Memory 不是简单的向量搜索,而是五条通道并行运行,再用 Reciprocal Rank Fusion(RRF)融合结果:

| 通道 | 用途 |

|---|---|

| 全文搜索 | 关键词匹配 |

| 精确事实键查找 | 直接定位已索引的事实 |

| 原始消息搜索 | 回溯原始对话文本 |

| 直接向量搜索 | 语义相似度 |

| HyDE 向量搜索 | 生成声明式答案,解决词汇不匹配问题 |

HyDE(Hypothetical Document Embeddings)通道尤其值得关注:它先生成一个假设性答案,再用这个答案的嵌入向量去检索——这样可以绕过用户查询和存储记忆之间的词汇差异。

合成阶段使用 Nemotron 3(120B MoE),Cloudflare 测试发现大模型只在合成环节有实质性帮助。

共享记忆:团队级的 Agent 知识协同

Agent Memory 的一个独特能力是记忆共享。记忆配置文件不需要绑定到单个 Agent——团队可以共享一个记忆配置文件,一个工程师的编码 Agent 学到的惯例、架构决策、团队”部落知识”,对其他人直接可用。

Cloudflare 内部已经在用这个功能。一个接入 Agent Memory 的 agentic 代码审查器学会了:当某个模式被标记过但作者选择保留时,下次就不再重复警告。

行业对比

Agent Memory 赛道越来越拥挤:

- Mem0:托管云 API,支持向量、图和键值存储

- Zep Graphiti:时序知识图谱,追踪事实的有效期

- LangMem:集成 LangGraph,但需要自建

- Letta(原 MemGPT):分层记忆架构,Agent 自主管理上下文

Cloudflare 的差异化在于边缘分发和与自家计算原语(Durable Objects、Vectorize、Workers AI)的深度集成。对于已经在 Cloudflare 上构建 Agent 的团队来说,接入成本最低。

需要注意的风险

独立评估者 Kristopher Dunham 指出了几个需要权衡的点:

- 厂商锁定:数据可以导出,但检索管道本身不可移植。“Exportable means you can extract the raw facts. It doesn’t mean your retrieval pipeline is portable.”

- 提取质量不可控:记忆提取依赖 Cloudflare 选择的二级模型,开发者无法干预

- 建议:关键事实应该显式调用 remember 工具,而不是依赖自动摄入

- 架构建议:对话历史和学到的事实应该从一开始就分开存储;上下文压缩在 60% 容量时触发,而不是等到撑满

目前处于私测阶段,定价未公布。

主要来源:InfoQ - Cloudflare Agent Memory, Cloudflare 官方博客