Agent 跑完了推理、调了工具、拿到了数据——然后呢?吐一串 JSON 给前端慢慢解析?

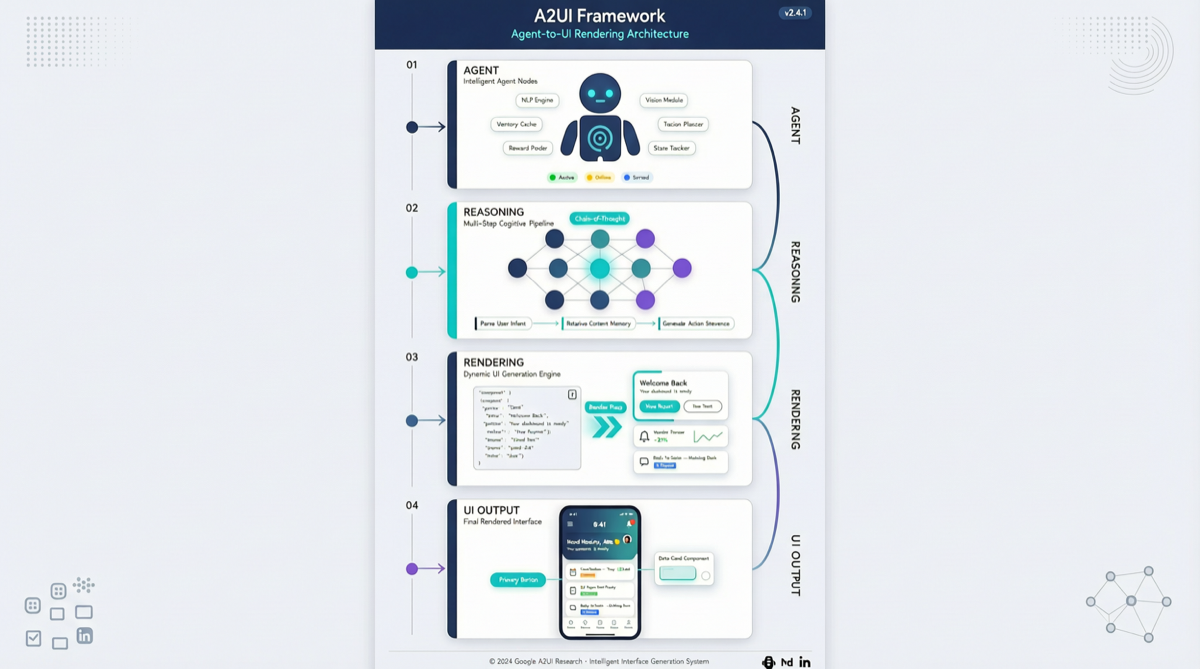

Google 的 A2UI(Agent-to-UI)给了一个更直接的答案:Agent 直接输出前端组件,浏览器拿到就能渲染。

这个仓库目前在 GitHub 上有 14.6k stars,来自 Google 官方团队(jacobsimionato、gspencergoog 等 Google 工程师在维护),支持 React 和 Angular 两个主流框架。

它解决什么问题

传统 Agent 输出流是这样的:

Agent → JSON → 前端解析 JSON → 手动构建 UI → 渲染

A2UI 把这个链路缩短了:

Agent → 结构化 UI 描述 → Renderer 直接渲染

区别在哪?前端不需要知道 Agent 的业务逻辑。 Agent 决定用什么组件、填什么数据、怎么排布,前端只负责执行渲染指令。

这对 CopilotKit、Vercel AI SDK 等"Generative UI"方案是一个直接的竞争者——但 A2UI 走的是开源、框架中立的路子,不绑定某个特定的云平台或框架。

架构看什么

从仓库结构能看出一些设计思路:

agent_sdks/:Agent SDK 目录,说明 Google 在推标准化的 Agent-to-UI 协议renderers/:渲染器目录,支持 React 和 Angular,且各自独立维护eval/:评测目录,说明项目有严谨的质量评估流程(不是那种丢个 README 就完事的开源项目)- 708 commits,最近 20 小时还在活跃更新,说明不是实验性项目,而是持续迭代的

一个值得注意的细节:React 渲染器的最近一次 commit 是 [react] Exclude SVG elements from CSS reset——这种粒度说明有人在真实场景中使用并反馈了 bug。

和 Generative UI 赛道的关系

Generative UI 是 2026 年 Agent 落地的核心瓶颈之一。Vercel 的 AI SDK、CopilotKit 的 AG-UI Protocol 都在做类似的事情——让 Agent 输出动态 UI。

A2UI 的不同之处在于:

- 框架中立:不是 React-only,Angular 支持也在

- Google 背书:不是创业公司项目,有 Google 工程师全职维护

- 协议化倾向:

agent_sdks/目录暗示他们在定义一个跨框架的 Agent-to-UI 标准

这有点像当年 Flutter 和 React Native 的博弈——最终胜出的不一定是技术上最好的,而是生态最完整的。A2UI 有 Google 的生态资源,但 Vercel 和 CopilotKit 有开发者社区的先发优势。

能不能用

现在就用?可以,但别急着把生产环境的 UI 渲染链路全换成它。

理由:

- 项目还在活跃迭代期(708 commits,2 个 tags),API 可能还不稳定

- 评测目录存在但没有公开的 benchmark 报告

- 目前只支持 React 和 Angular,Vue 用户暂时无缘

建议姿势:在自己的 Agent 项目里加一个 A2UI renderer,和现有的 JSON 输出并行跑一段时间,看看 UI 渲染的准确性和延迟表现。

关注什么

- Agent SDK 的标准化进展——如果 Google 能把 Agent-to-UI 做成一个跨框架的开放协议,这会改变 Generative UI 赛道的格局

- Vue 支持什么时候来——国内 Vue 用户基数不小

- 和 CopilotKit AG-UI Protocol 的互操作性——两个方案能不能打通,还是各玩各的

A2UI 不是又一个"Agent 框架"。它解决的是 Agent 落地的最后一公里——用户到底看到什么。这个问题不解决,Agent 再聪明也只是个后端 API。

主要来源: