Hugging Face 做了一个叫 nanowhale 的小模型。110M 参数。不到 DeepSeek-V4 的千分之一。

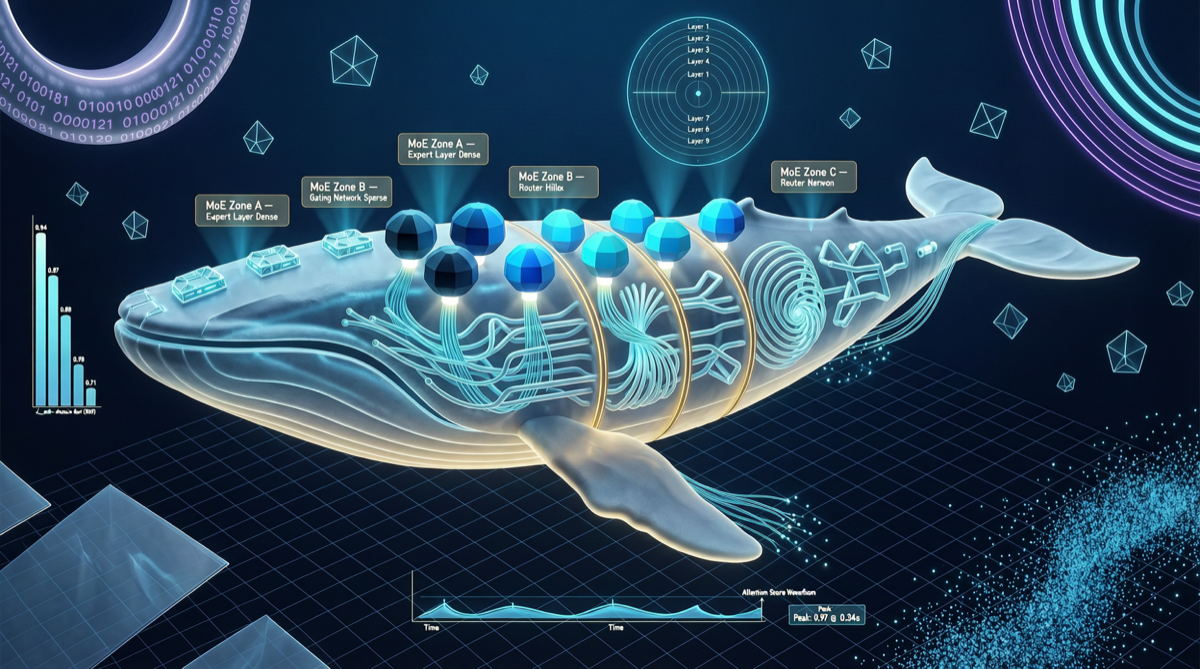

但别急着跳过——它复刻了 DeepSeek-V4 里几乎所有的关键架构组件:MLA(Multi-Head Latent Attention)、MoE(Mixture of Experts)、Hyper-Connections、MTP(Multi-Token Prediction)、SwiGLU 激活、RoPE + NoPE 位置编码。

换句话说,这是一台 DeepSeek-V4 架构的显微镜。

为什么需要这样一个"玩具模型"

做 LLM 研究最贵的一件事不是训练,是调试。

你改了一个注意力机制的参数,想在 671B 参数模型上跑个 ablation?不现实的。光是加载模型就需要几十张 H100,更别说迭代一轮要几天。

nanowhale 的思路很简单:把 DeepSeek-V4 的架构骨架完整保留,但把所有维度缩到极小。110M 参数意味着你在消费级 GPU 甚至 CPU 上就能跑 inference,几分钟就能训一轮。

这不是用来做 QA 的模型。你不能用它写代码,不能让它做翻译。它的用途只有两个:

架构研究。想试试把 MoE 的 expert 数量从 256 改成 512 会怎样?想验证 MLA 在小参数下是否仍然有效?用 nanowhale。

教育工具。开源社区一直缺一个"带全套现代架构但足够小"的教学模型。GPT-2 太老了,缺少 MoE 和 MLA;现在有了 nanowhale,学生可以在笔记本上跑一遍完整的 DeepSeek-V4 架构训练流程。

架构复刻到什么程度了

nanowhale 的架构映射基本是逐层对应的:

| DeepSeek-V4 组件 | nanowhale 实现 |

|---|---|

| MLA (128 head, latent dim 128) | MLA (4 head, latent dim 16) |

| 256 MoE experts (top-8 routing) | 8 MoE experts (top-2 routing) |

| Hyper-Connections (residual 替代) | Hyper-Connections (同结构) |

| MTP (multi-token prediction) | MTP (预测 2 个后续 token) |

| SwiGLU FFN | SwiGLU FFN |

| RoPE + NoPE | RoPE + NoPE |

比例缩放了,但拓扑结构没变。这意味着在 nanowhale 上观察到的架构行为变化——比如改变 routing 策略对训练稳定性的影响——有大概率可以线性外推到更大规模的模型上。

当然,"大概率"不等于"一定"。scaling law 的非线性特性众所周知,小模型上的发现需要在大模型上重新验证。但作为第一轮筛选工具,够用了。

社区已经怎么玩起来了

nanowhale 刚上 Hugging Face 不到 24 小时,已经有三个衍生方向冒出来:

- 量化实验。有人在测试 INT4 量化对 MoE routing 精度的影响——这种实验用大模型做成本太高。

- 架构消融。有人把 Hyper-Connections 换成传统残差,直接对比训练曲线差异。

- 教学 notebook。两个研究生已经在 Colab 上跑通了从零训练 nanowhale 的完整流程,GPU 时间不超过 2 小时。

我的看法

nanowhale 不会替代任何生产模型。但它在开源社区的定位类似 JAX 在深度学习框架中的位置——不是拿来用的,是拿来理解底层机制的。

如果你在做架构研究,或者想让学生理解 MoE + MLA + MTP 这套组合拳到底在干什么,nanowhale 是目前成本最低的路径。

值得跟的一个问题:Hugging Face 是否计划推出其他前沿架构的 micro clone?如果 Qwen3.6 的 MoE 变体或者 Kimi K2.6 的架构也能被缩到 100M 级别,那开源社区的实验能力会大幅跃升。

主要来源: