Hugging Face выпустила крошечную модель под названием nanowhale. 110M параметров. Меньше одной тысячной от DeepSeek-V4.

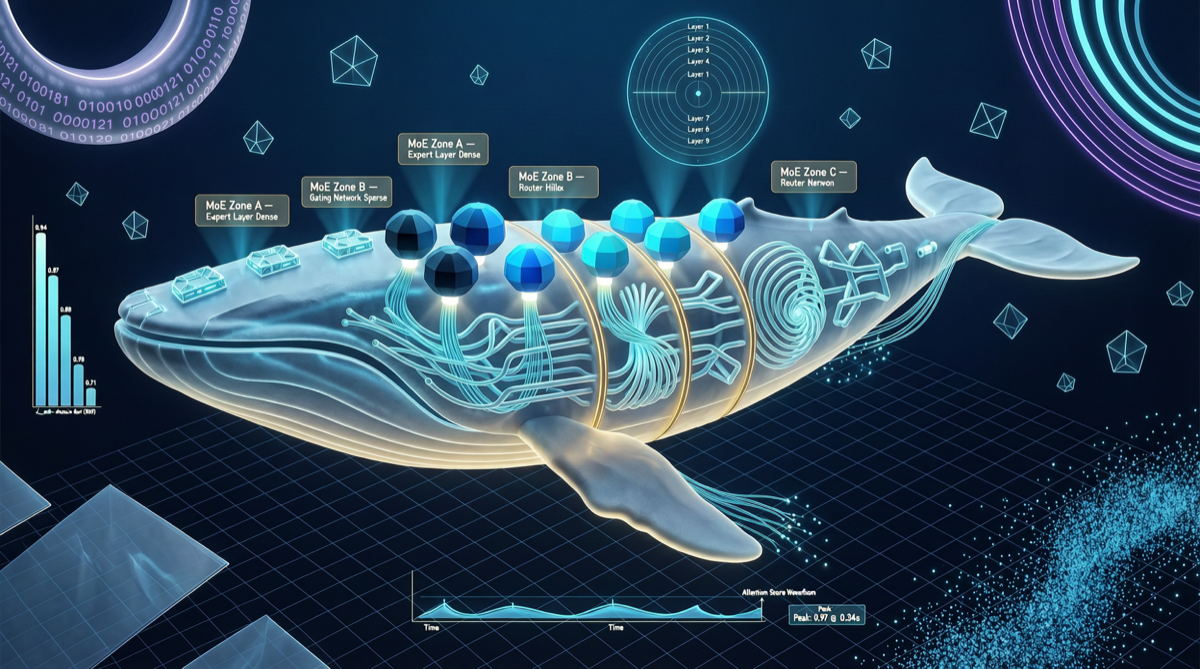

Но не пролистывайте слишком быстро. Она воспроизводит практически все ключевые архитектурные компоненты DeepSeek-V4: MLA (Multi-Head Latent Attention), MoE (Mixture of Experts), Hyper-Connections, MTP (Multi-Token Prediction), активацию SwiGLU и позиционное кодирование RoPE + NoPE.

Другими словами, это микроскоп для архитектуры DeepSeek-V4.

Зачем нужна такая маленькая модель

Самое дорогое в исследовании LLM — не обучение. Это отладка.

Вы изменили параметр механизма внимания и хотите запустить абляцию на модели с 671B параметров? Нереально. Только загрузка модели требует десятков H100, не говоря о том, что одна итерация занимает дни.

Подход nanowhale прост: сохранить архитектурный скелет DeepSeek-V4, но масштабировать все размеры до минимума. 110M параметров означают, что вы можете запускать инференс на потребительских GPU или даже CPU и провести раунд обучения за минуты.

Это не модель для QA. Вы не сможете использовать её для написания кода или перевода. У неё ровно два варианта применения:

Архитектурные исследования. Хотите узнать, что произойдёт, если изменить количество экспертов MoE с 256 на 512? Хотите проверить, работает ли MLA на малых параметрах? Используйте nanowhale.

Образование. Open source сообществу давно не хватало «достаточно маленькой, но с полной современной архитектурой» учебной модели. GPT-2 слишком стар, в нём нет MoE и MLA; теперь с nanowhale студенты могут запустить полный процесс обучения архитектуры DeepSeek-V4 на ноутбуке.

Насколько точно воспроизведена архитектура

Отображение архитектуры nanowhale — это по сути послойное соответствие:

| Компонент DeepSeek-V4 | Реализация в nanowhale |

|---|---|

| MLA (128 head, latent dim 128) | MLA (4 head, latent dim 16) |

| 256 MoE experts (top-8 routing) | 8 MoE experts (top-2 routing) |

| Hyper-Connections | Hyper-Connections (та же структура) |

| MTP | MTP (предсказывает 2 последующих токена) |

| SwiGLU FFN | SwiGLU FFN |

| RoPE + NoPE | RoPE + NoPE |

Пропорции масштабированы, но топология не изменилась. Это означает, что изменения в поведении архитектуры, наблюдаемые в nanowhale — например, как изменение стратегии маршрутизации влияет на стабильность обучения — вероятно, можно линейно экстраполировать на более крупные модели.

Разумеется, «вероятно» не означает «точно». Нелинейность законов масштабирования хорошо известна, и результаты на маленьких моделях нужно перепроверять на больших. Но как инструмент первичного скрининга — достаточно.

Что уже делает сообщество

nanowhale появилась на Hugging Face менее 24 часов назад, и уже появились три направления развития:

- Эксперименты с квантованием. Кто-то тестирует влияние INT4-квантования на точность маршрутизации MoE — такого рода эксперименты на больших моделях обходятся слишком дорого.

- Архитектурные абляции. Кто-то заменил Hyper-Connections на традиционные residual-соединения и напрямую сравнил различия кривых обучения.

- Учебные ноутбуки. Два аспиранта уже запустили полный процесс обучения nanowhale с нуля на Colab, затратив менее 2 часов GPU-времени.

Мнение

nanowhale не заменит ни одну продакшн-модель. Но её позиция в open source сообществе аналогична роли JAX во фреймворках глубокого обучения — не для использования, а для понимания механики под капотом.

Если вы занимаетесь архитектурными исследованиями или хотите, чтобы студенты поняли, что на самом делает комбинация MoE + MLA + MTP, nanowhale — сейчас самый недорогой путь.

Вопрос для наблюдения: планирует ли Hugging Face выпуск микро-клонов других фронтальных архитектур? Если MoE-вариант Qwen3.6 или архитектура Kimi K2.6 также будут масштабированы до уровня 100M, экспериментальные возможности open source сообщества значительно вырастут.

Основные источники: