核心结论

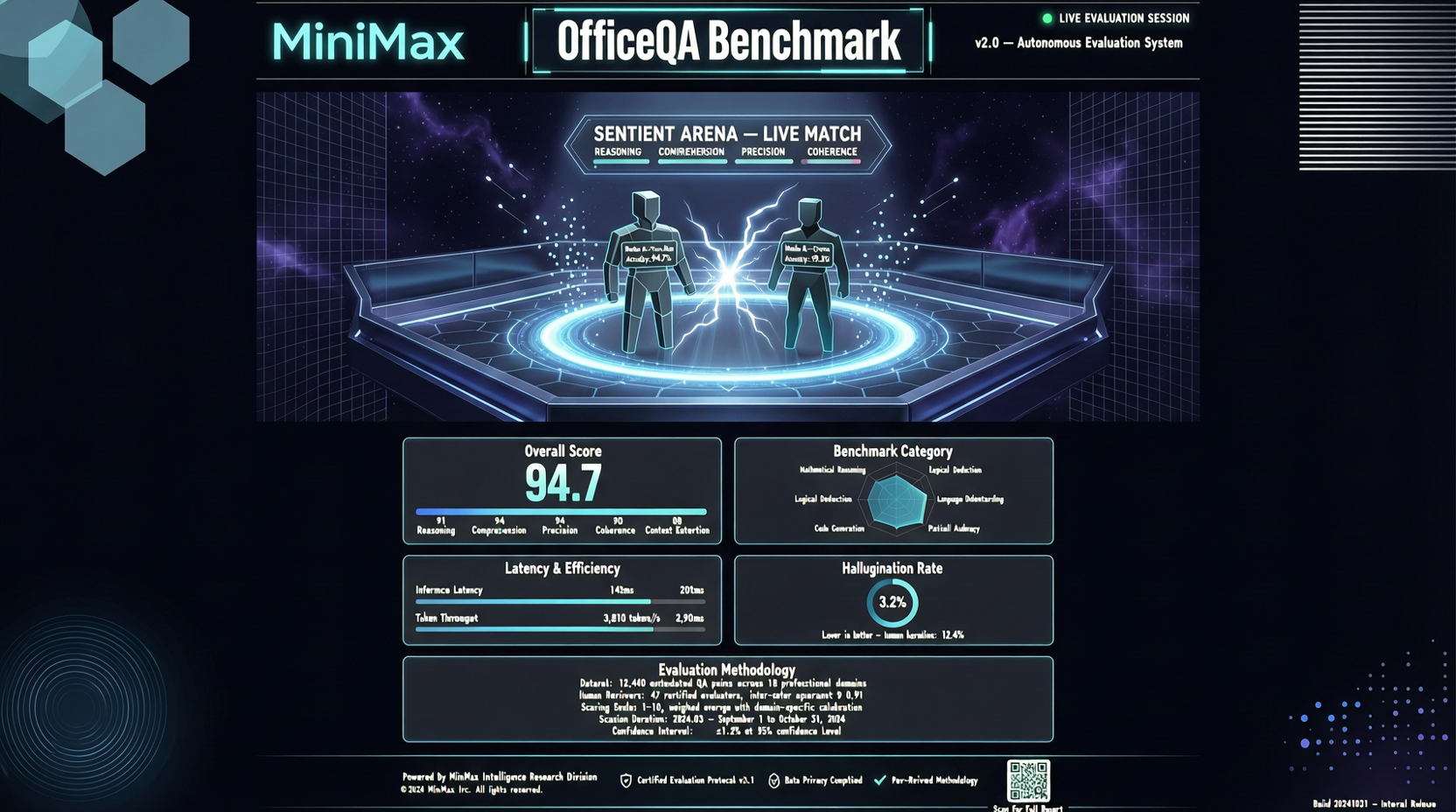

在刚刚落幕的 Sentient Arena 硅谷 AI 竞赛中,一个反直觉的结果引发关注:中国模型 MiniMax M2.5 搭配自研智能体 Teller,在 Databricks OfficeQA 基准测试中以 71.5% 的准确率击败了 Claude。

更值得玩味的是——MiniMax 在硅谷并非家喻户晓的名字,在英语 AI 社区几乎无人关注。这恰恰说明中国模型的价值发现存在显著的地域信息差。

事件详情

参赛者 Hermes (@0xHermes_) 在硅谷比赛期间分享了使用 MiniMax 的实测体验。核心事实如下:

| 维度 | 数据 |

|---|---|

| 模型 | MiniMax M2.5(开源) |

| Agent 框架 | Teller(自研) |

| 测试基准 | Databricks OfficeQA |

| 准确率 | 71.5% |

| 击败对象 | Claude(同场景) |

Databricks OfficeQA 是衡量模型在办公软件自动化场景能力的基准测试,涵盖文档处理、表格操作、邮件撰写等实际办公任务。71.5% 的准确率意味着在接近四分之三的办公场景中,模型可以可靠地完成自动化操作。

为什么 MiniMax 被低估?

MiniMax 在中国 AI 圈有一定知名度,但在英语世界的能见度极低。这与几个因素相关:

语言壁垒:MiniMax 的主要文档、社区和用例集中在中国市场,英语世界的开发者很难发现其能力。

定位差异:MiniMax 不像 DeepSeek 那样以"低价+开源"策略打入英语社区,也不像 Qwen 那样有阿里生态的全球化推广。它走的是闷声打磨产品路线。

场景聚焦:MiniMax 在办公自动化、多模态内容生成等场景的优化,恰好契合了 Databricks OfficeQA 的评估维度。这不是通用能力的全面超越,而是垂直场景的精准打击。

中国模型全球格局判断

结合最近的多个信号,中国模型的全球竞争力正在分化:

| 模型 | 核心优势 | 国际能见度 |

|---|---|---|

| Qwen | 代码生成效率、生态丰富 | 高(阿里全球化) |

| DeepSeek | 推理能力、长上下文 | 高(低价策略) |

| Kimi | 研究文档处理 | 中(K2.6 刚上 DigitalOcean) |

| MiniMax | 办公自动化、多模态 | 低(被严重低估) |

| GLM | 开发者工作流 | 中 |

MiniMax 在办公场景的表现提醒我们:评测榜单不是唯一标准。一个在通用榜单上未必领先的模型,可能在特定场景下具有压倒性优势。

行动建议

- 办公自动化场景:如果你在做文档处理、表格操作、邮件自动化等任务,MiniMax M2.5 值得加入候选清单,尤其是成本敏感的场景。

- 模型组合策略:不要只用一个模型。通用推理用 Claude/GPT,办公自动化用 MiniMax,代码用 Qwen——场景化选模是 2026 年的正确姿势。

- 关注信息差机会:中国模型在英语社区的低能见度,对开发者来说是套利机会。提前熟悉 MiniMax 等被低估的模型,可能在竞赛和产品中拿到先发优势。