结论

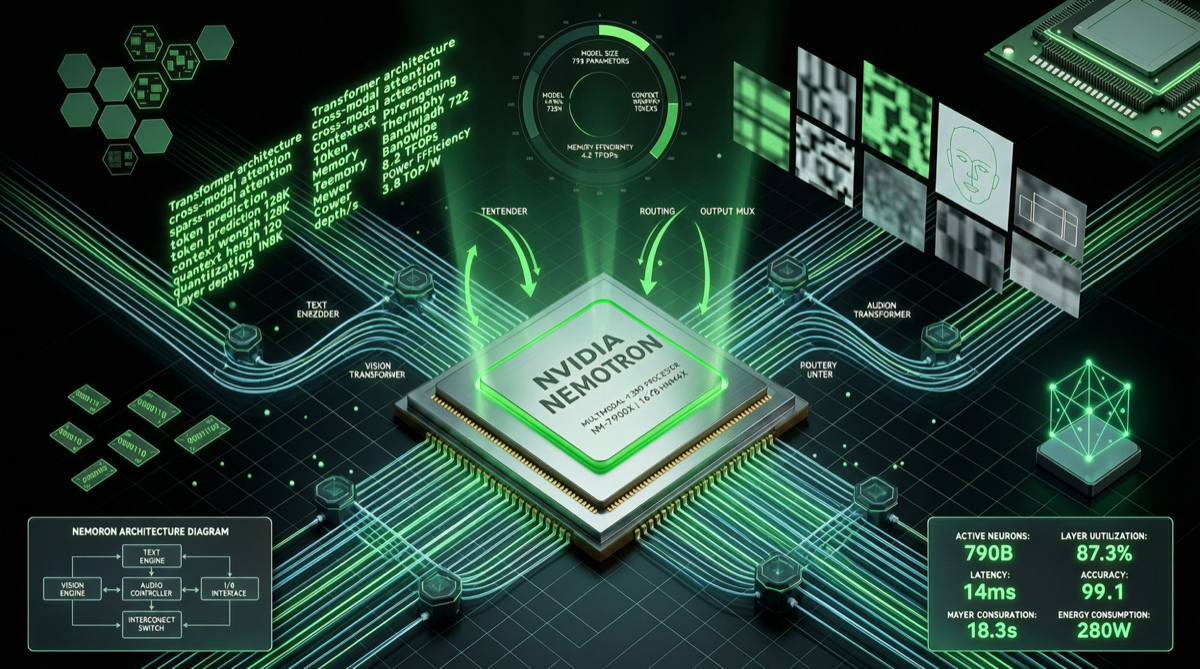

英伟达在 4 月 29 日正式发布了 Nemotron 3 系列开放 AI 模型——包含 Nano、Super 和 Ultra 三种规模。其中 Nano Omni 版本最受关注:全模态(文本+图像)、Agent 优化、消费级 GPU 可运行。

这次发布的信号非常明确:AI Agent 应用开发需要专门的模型,而通用 LLM 已经不够用了。

Nemotron 3 系列全景

| 型号 | 定位 | 特色 | 目标场景 |

|---|---|---|---|

| Nano Omni | 轻量全模态 | 多模态输入输出、FP8 优化 | Agent 开发、边缘部署 |

| Super | 中等规模 | 平衡性能与成本 | 企业级应用 |

| Ultra | 旗舰级 | 最高精度和推理深度 | 复杂 Agent 任务链 |

Nano Omni 的技术亮点

1. 全模态支持

Nano Omni 的核心卖点是同时理解和生成文本与图像。这意味着一个 Agent 可以:

- 看懂用户截图并做出响应

- 生成视觉化输出(图表、示意图)

- 在文本和图像之间自由切换推理

这对于需要多模态交互的 Agent 场景(客服、代码审查、数据分析)是刚需。

2. FP8 推理深度优化

新模型对 Hopper 和 Blackwell 架构的 FP8 推理做了深度优化。FP8 相比 FP16 可以将推理吞吐量提升近一倍,同时显存占用减半。

更重要的是,它也兼容 RTX 5090 等消费级显卡和 Jetson Thor 机器人平台。这意味着:

- 个人开发者可以用 RTX 5090 跑全模态 Agent

- 机器人场景可以在 Jetson Thor 上本地运行

3. Agent 原生设计

与通用 LLM 不同,Nemotron 3 系列从设计之初就瞄准了 Agent 应用场景:

- 工具调用优化:对 function calling 的格式和准确率做了专项训练

- 多轮对话稳定性:在长对话中的指令跟随能力显著优于通用模型

- 推理-行动循环:针对 Agent 特有的”观察→推理→行动→观察”循环做了优化

英伟达的算盘

英伟达做这件事的逻辑很清晰:

- Agent 是 AI 的下一波应用浪潮——需要专门的模型

- 专门的模型需要专门的硬件优化——Nemotron + NVIDIA GPU 是最佳组合

- 开源可以建立生态标准——就像 CUDA 之于 GPU 编程

这次开源本质上是在定义 AI Agent 模型的参考架构——未来第三方开发 Agent 时,Nemotron 很可能成为默认的”基准模型”。

对 Agent 开发者的实际影响

如果你在用 Hermes Agent、OpenClaw、LangChain 等框架开发 Agent:

- 成本优势:Nano 级别的模型意味着 API 调用成本大幅下降(如果部署在自有 GPU 上则边际成本接近零)

- 多模态能力:不用再接多个模型(一个做视觉、一个做文本),Nano Omni 一个模型搞定

- 本地部署:消费级 GPU 的兼容性让”本地 Agent”真正可行

与大模型竞争的关联

Nemotron 3 的发布时间点很有意思——几乎和 OpenAI GPT-5.5、DeepSeek V4 的发布窗口重叠。

上一阶段的大模型竞争本质是围绕”能力上限”的较量。进入 2026 年之后,竞争的焦点正在转向”应用效率”和”部署成本”。

英伟达的策略很聪明:不直接和 OpenAI/Anthropic 拼通用模型能力,而是在 Agent 应用层开辟新战场,用开源+硬件绑定的方式建立护城河。

国产模型的机会

国产模型(Qwen、DeepSeek、GLM)在通用能力上已经追平甚至超越了很多西方模型,但在 Agent 专用模型这个细分赛道上,布局还不够密集。

如果国内模型厂商能在以下方向发力,可能形成差异化优势:

- 中文 Agent 场景优化:国内特有的应用场景(政务、金融、电商)需要专门的训练数据

- 国产芯片适配:Nemotron 深度绑定 NVIDIA 硬件,国产模型 + 国产芯片(沐曦、海光等)的组合有战略价值

- 开源社区生态:参考 Nemotron 的开源策略,建立 Agent 模型的国内开源标准

一句话

英伟达 Nemotron 3 的开源发布,标志着 AI Agent 模型正式成为独立于通用 LLM 的新赛道——而且这个赛道的竞争维度已经从”谁更聪明”转向了”谁更高效、谁更便宜、谁更容易部署”。