推論1回あたり$0.02。

主流のLLM APIの典型的な価格だ。無視できるくらい安く聞こえる——合計を計算し始めるまでは。

$0.02 × 1日10,000,000リクエスト × 365日 = 年間$73,000,000

7300万ドル。推論だけ。トレーニング、ファインチューニング、ベクトルデータベース、キャッシュレイヤー、インフラオーバーヘッドは一切含まない。

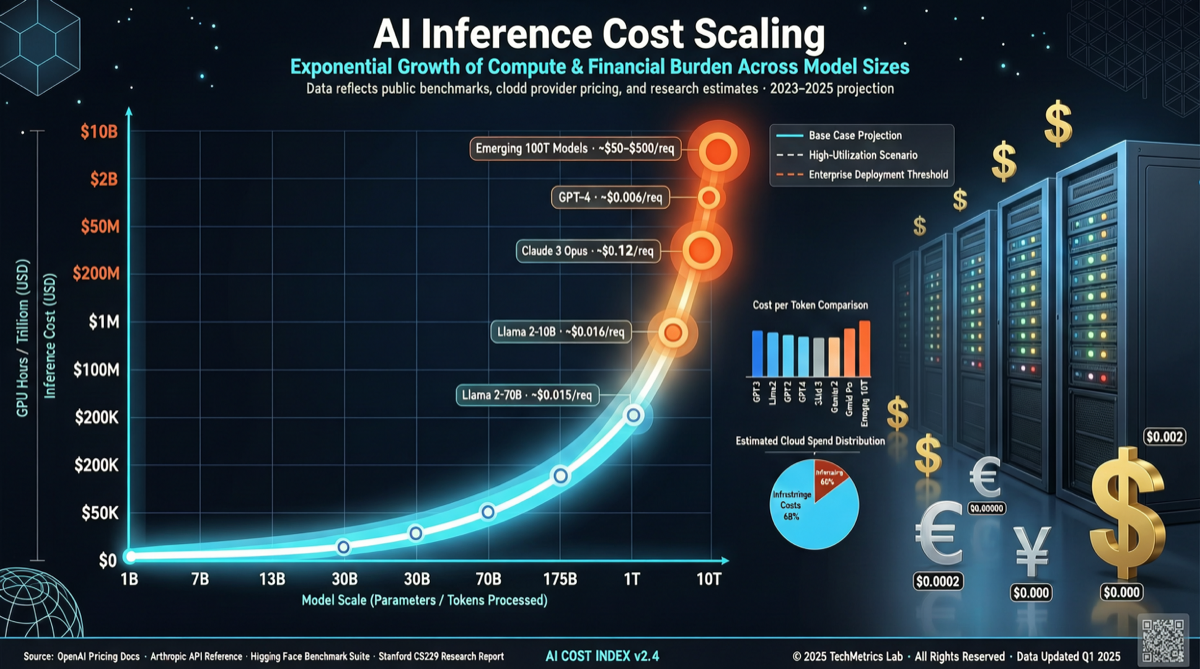

推論コストは線形な問題じゃない

従来のSaaSのコスト構造はきれいだった:サーバーはユーザー数に比例して拡張し、限界コストはゼロに近づく。利益率80%以上が業界標準。

AIプロダクトにはその特権がない。

ユーザーが増えればAPI呼び出しが増え、推論費用も増える。各新增ユーザーは実際の測定可能な限界コストを伴う。そして reasoning モデル(GPT-o1、Claudeのthinkingモード)が普及するにつれて、単位推論コストは実際に上昇している——同じリクエストを完了するためにより多くの計算ステップが必要だからだ。

一つ比較してみよう:GPT-4oの1回呼び出しコストはGPT-o1の十分の一かもしれない。しかし reasoning 能力が必要なら、その10倍の値段を払うことになる。

実際のコスト内訳

AIカスタマーサポートプロダクトを作っていると仮定しよう:

- ユーザーの質問:平均2,000トークン入力 + 500トークン出力

- モデル選択:reasoning能力が必要なのでo1-miniまたはClaude Sonnet with thinking

- 1回あたりのコスト:約$0.015-0.03

- 1日のリクエスト数:50,000回(中規模プロダクト)

- 月間推論コスト:$22,500-45,000

- 年間推論コスト:$270,000-540,000

もしプロダクトが$10/ユーザー/月で5,000人の有料ユーザーがいれば、月収$50,000。推論コストが収入の半分以上を食う。

しかもこれは以下の費用を含んでいない:ベクトルデータベース(月$5K-15K)、キャッシュ(Redis/Memcached)、モニタリングとログ、そして最も高い部分——ユーザーの行動が予想から逸脱したとき、ロングテールリクエストのコストは指数関数的に急増する。

業界はどう対応しているか

現在、AI企業が推論コストを制御する方法はいくつかある:

1. モデルルーティング。簡単な質問は安いモデル(GPT-4o-mini、Gemini Flash)に、複雑な問題はreasoningモデルに。良いルーティング戦略でコストを60%以下に抑えられるが、実装は難しい——「この質問にreasoningの金を払う価値があるか」を判断する分類器が必要だ。

2. キャッシュ層。同じまたは類似のリクエストはキャッシュ結果を返す。FAQシナリオには有効だが、パーソナライズされたシナリオ(各ユーザーのコンテキストが異なる)には基本的に使えない。

3. 自社デプロイ。オープンソースモデル(Llama、Gemma、Qwen)を自社のGPUで実行する。初期投資は大きいが、スケールすれば単位コストはAPIの1/5から1/10に圧縮できる。問題点は——推論インフラチームを雇う必要があるということだ。

4. レート制限とクォータ。最も直接的だがUXを最も傷つける方法。無料ユーザーは1日10回、有料ユーザーは100回。本質的にはコスト負担をユーザーの選択行動に転嫁している。

私の判断

推論コストの問題は2026年後半により深刻になる。理由は二つ:

第一に、ユーザーの期待が上がっている。GPT-o1とClaude reasoningを使ったユーザーは、シンプルモデルの出力品質では満足しない。製品側は体験を維持するためにより高いモデルを使わざるを得ない。

第二に、競争が使用量を押し上げている。競合が無料無制限のAI機能を提供しているとき、「今日は10回までしか使えません」とユーザーに言うのは難しい。

短期的には、モデルルーティング+キャッシュが最も現実的な組み合わせ。長期的には、自社で推論インフラを運営できる企業が構造的なコスト優位性を持つ——ただし、ほとんどのスタートアップにとってそれは3-5人のMLOpsエンジニアを雇うことを意味し、その人件費自体が参入障壁だ。

AIプロダクトを作っているなら、今すぐこの計算を始めるべきだ。月間の請求書が届いて利益率がマイナスだと気づくのを待ってはいけない。

主な情報源:

- X/Twitter コミュニティ議論(AIプロダクトコストスケーリングスレッド、2026-05-10)

- OpenAI API価格ページ

- Anthropic API価格ページ

- Google Cloud Vertex AI価格ページ