$0.02 за инференс.

Это типичная цена для мейнстримных LLM API. Звучит достаточно дёшево, чтобы игнорировать — пока вы не начнёте считать.

$0.02 × 10 000 000 запросов/день × 365 дней = $73 000 000/год

Семьдесят три миллиона долларов. Только инференс. Это без обучения, файн-тюнинга, векторных баз данных, кэширующих слоёв или любой инфраструктуры.

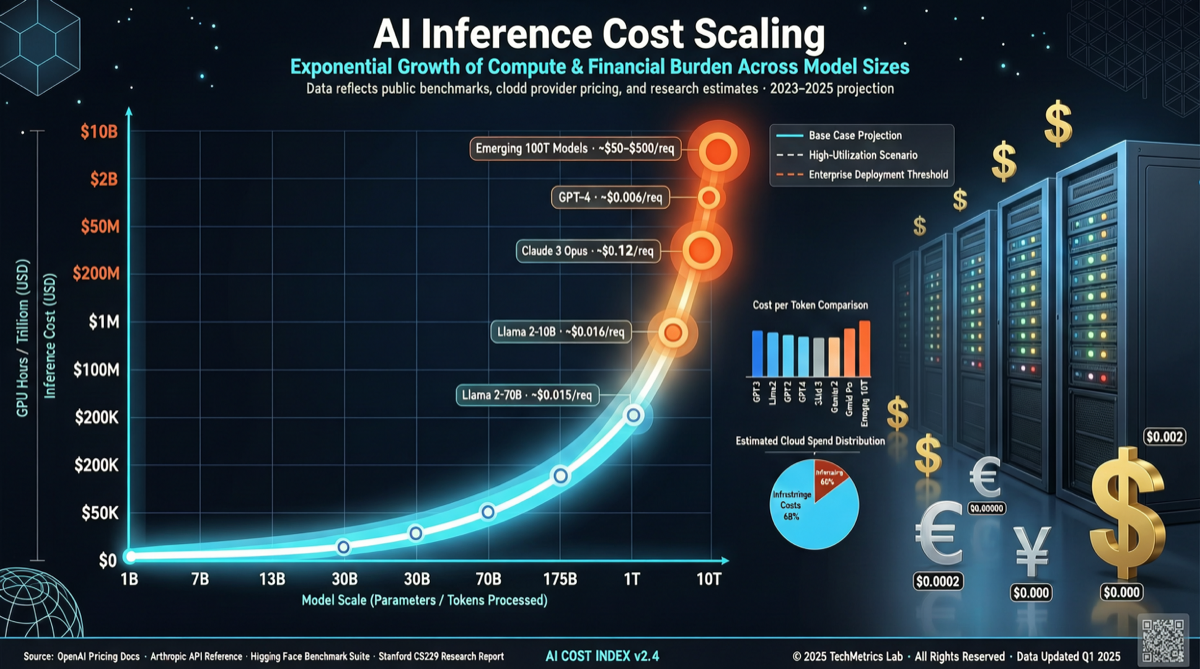

Стоимость инференса — не линейная проблема

Традиционный SaaS имеет чистую структуру затрат: серверы масштабируются линейно с пользователями, предельная стоимость стремится к нулю. 80%+ маржи — отраслевой стандарт.

AI-продукты не получают этой привилегии.

Больше пользователей — больше вызовов API — больше расходов на инференс. Каждый новый пользователь несёт реальную, измеримую предельную стоимость. И по мере распространения reasoning-моделей (GPT-o1, thinking-режим Claude) удельная стоимость инференса растёт — потому что reasoning-модели требуют больше вычислительных шагов для выполнения того же запроса.

Сравнение: один вызов GPT-4o может стоить в десять раз меньше вызова GPT-o1. Но если вам нужна reasoning-способность, вы платите эту десятикратную цену.

Реальный разбор затрат

Допустим, вы делаете продукт AI-поддержки клиентов:

- Запрос пользователя: в среднем 2 000 токенов ввода + 500 токенов вывода

- Выбор модели: нужен reasoning, значит o1-mini или Claude Sonnet с thinking

- Стоимость за запрос: примерно $0.015-0.03

- Ежедневные запросы: 50 000 (продукт среднего масштаба)

- Ежемесячная стоимость инференса: $22 500-45 000

- Годовая стоимость инференса: $270 000-540 000

Если ваш продукт стоит $10/пользователь/месяц и имеет 5 000 платных пользователей, это $50 000/месяц дохода. Инференс съедает больше половины.

И это без: векторных баз данных ($5K-15K/месяц), кэширования (Redis/Memcached), мониторинга и логов, и самой дорогой части — когда поведение пользователей отклоняется от ожидаемого, стоимость long-tail запросов растёт экспоненциально.

Как реагирует индустрия

Сейчас AI-компании контролируют затраты на инференс несколькими путями:

1. Маршрутизация моделей. Простые вопросы идут к дешёвым моделям (GPT-4o-mini, Gemini Flash), сложные — к reasoning-моделям. Хорошая стратегия маршрутизации может снизить затраты до 60%, но реализация сложна — нужен классификатор, который решает «стоит ли этот вопрос денег на reasoning?»

2. Кэширование. Идентичные или похожие запросы возвращают кэшированный результат. Работает для FAQ, бесполезно для персонализированных сценариев.

3. Самостоятельное размещение. Запуск open-source моделей (Llama, Gemma, Qwen) на собственных GPU. Высокие начальные инвестиции, но при масштабе удельная стоимость падает до 1/5–1/10 от цены API. Проблема — нужна команда инфраструктуры инференса.

4. Ограничение скорости и квоты. Самый прямой, но наиболее вредящий UX подход. Бесплатные пользователи получают 10/день, платные — 100. По сути, перекладывание затрат на выбор пользователя.

Мой вывод

Проблема стоимости инференса обострится во второй половине 2026 года по двум причинам:

Во-первых, ожидания пользователей растут. Те, кто попробовал GPT-o1 и Claude reasoning, не согласятся на качество вывода простых моделей.

Во-вторых, конкуренция подталкивает объём использования. Когда конкуренты предлагают бесплатные безлимитные AI-функции, трудно сказать пользователям «сегодня можно использовать только 10 раз».

В краткосрочной перспективе: маршрутизация моделей + кэширование — наиболее практичная комбинация. В долгосрочной: компании, управляющие собственной инфраструктурой инференса, будут иметь структурное преимущество по затратам — но для большинства стартапов это означает найм 3-5 MLOps-инженеров, и эта зарплата сама по себе является барьером.

Если вы создаёте AI-продукт, начинайте считать сейчас. Не ждите ежемесячного счёта, чтобы обнаружить, что ваша маржа отрицательная.

Источники:

- Обсуждения в X/Twitter (трэд о масштабировании затрат AI-продуктов, 2026-05-10)

- Страница цен API OpenAI

- Страница цен API Anthropic

- Страница цен Google Cloud Vertex AI