$0.02 一次推理。

这是目前主流 LLM API 的典型价格。听起来便宜到可以忽略不计——直到你开始算总量。

$0.02 × 10,000,000 次/天 × 365 天 = $73,000,000/年

七千三百万美元。光是推理费用。这还不算训练、微调、向量数据库、缓存层、或者任何基础设施开销。

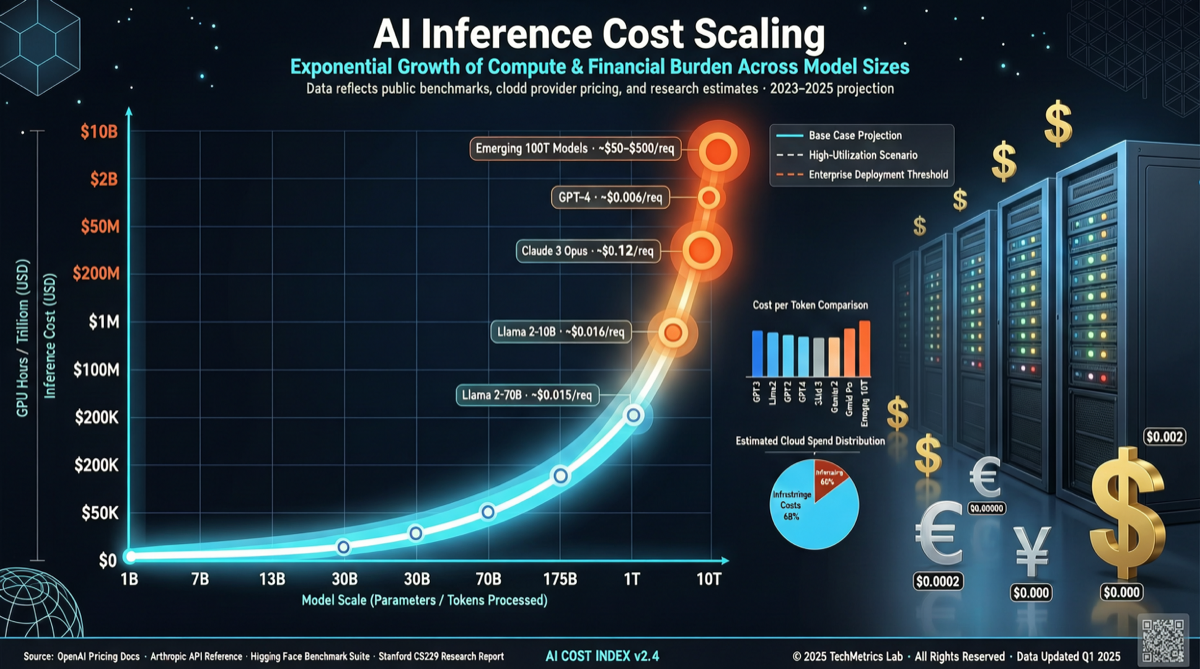

推理成本不是线性问题

传统 SaaS 的成本结构很干净:服务器按用户数线性扩展,边际成本趋近于零。多一个用户,多几美分的 hosting 费用。毛利 80%+ 是行业标准。

AI 产品不享受这个特权。

你的用户越多,调用的 API 次数越多,推理费用越高。每个新增用户都带着真实的、可计量的边际成本。而且随着 reasoning 模型(GPT-o1、Claude 的 thinking 模式)的普及,单位推理成本还在涨——因为 reasoning 模型需要更多的计算步数来完成同一次请求。

一个对比:GPT-4o 的单次调用成本可能只有 GPT-o1 的十分之一。但如果你需要 reasoning 能力,你就得付那个十倍的价格。

真实的成本拆解

假设你在做一个 AI 客服产品:

- 用户提问:每次平均 2,000 tokens 输入 + 500 tokens 输出

- 模型选择:需要 reasoning 能力,选 o1-mini 或 Claude Sonnet with thinking

- 单次成本:约 $0.015-0.03

- 日均请求量:50,000 次(中等规模产品)

- 月度推理成本:$22,500-45,000

- 年度推理成本:$270,000-540,000

如果你的产品月费 $10/用户、有 5,000 个付费用户,月收入 $50,000。推理成本吃掉了一半以上的收入。

这还没算上:向量数据库($5K-15K/月)、缓存(Redis/Memcached)、监控和日志、以及最贵的部分——当用户行为偏离预期时,长尾请求的成本会指数级飙升。

行业正在怎么应对

目前来看,AI 公司控制推理成本有几条路:

1. 模型路由。简单问题用便宜模型(GPT-4o-mini、Gemini Flash),复杂问题才用 reasoning 模型。好的路由策略可以把成本压到 60% 以下,但实现难度大——你需要一个分类器来判断"这个问题值不值得花 reasoning 的钱"。

2. 缓存层。相同或相似的请求直接返回缓存结果。对于 FAQ 类场景有效,但对个性化场景(比如每个用户的上下文不同)基本没用。

3. 本地部署。用 Llama、Gemma、Qwen 等开源模型跑在自己的 GPU 上。初期投入大,但规模起来后单位成本可以压到 API 的 1/5 到 1/10。问题是——你需要养一个推理基础设施团队。

4. 限流和配额。最直接但也最伤用户体验的方式。免费用户每天 10 次,付费用户 100 次。本质上是把成本转嫁给用户的选择行为。

我的判断

推理成本问题在 2026 年下半年会变得更尖锐,原因有两个:

第一,用户预期在涨。用过 GPT-o1 和 Claude reasoning 的用户不会满足于简单模型的输出质量。这意味着产品方被迫用更贵的模型来维持体验。

第二,竞争在推高用量。当竞品提供免费无限次 AI 功能时,你很难对用户说"你今天只能用 10 次"。

短期来看,模型路由 + 缓存是最务实的组合。长期来看,能自己跑推理基础设施的公司会有结构性成本优势——但这对大多数创业公司来说意味着要招 3-5 个 MLOps 工程师,这笔人力成本本身就是个门槛。

如果你在做 AI 产品,现在就该开始算这笔账。别等到月度账单出来才发现毛利是负的。

主要来源:

- X/Twitter 社区讨论(AI product cost scaling 线程,2026-05-10)

- OpenAI API 价格页

- Anthropic API 价格页

- Google Cloud Vertex AI 价格页