何が起こったのか

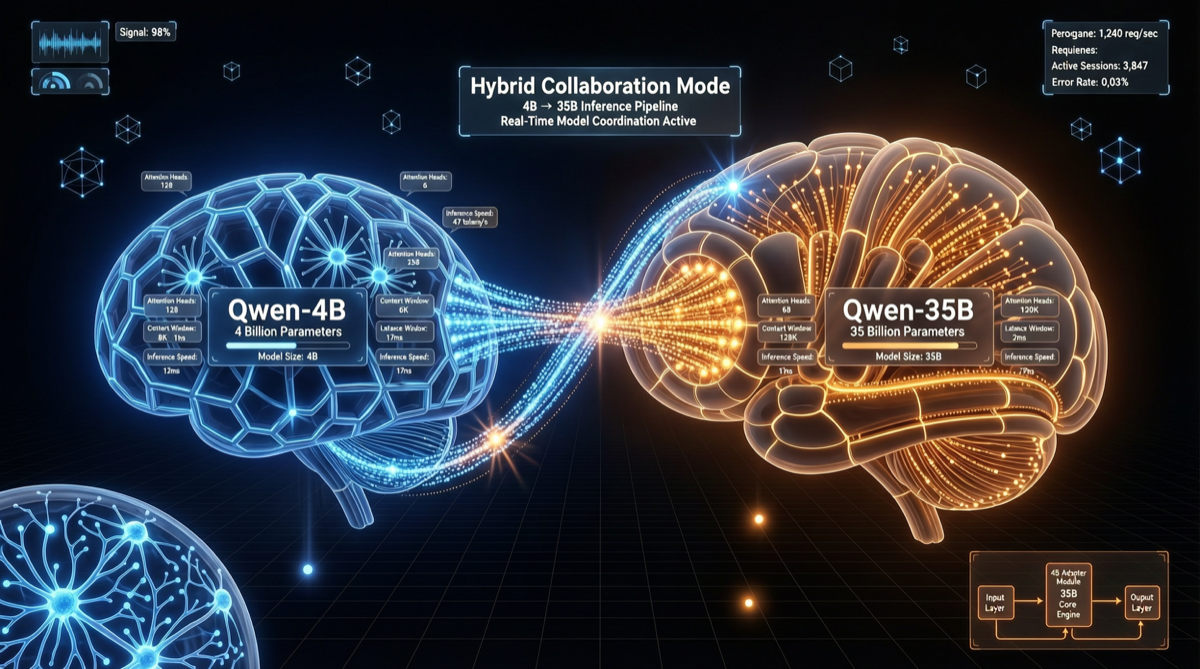

Qwenチームは2026年5月初め、前例のないハイブリッド推論アーキテクチャを発表しました。4Bパラメータの小モデルと35Bパラメータの大モデルを**新型ソルバーと補助トレーニング(auxiliary training)**で深く結合したものです。

これは単なるモデル蒸留や知識移転ではなく、二脳協調システムです。両方のモデルが推論プロセスに同時に参加し、それぞれが異なるレベルの理解力を貢献します。

アーキテクチャの分解

なぜ4B + 35Bなのか?

| 役割 | モデル | 責務 | パラメータ数 |

|---|---|---|---|

| 高速思考者 | Qwen-4B | パターン認識、常識推論、高速フィルタリング | 4B |

| 深層分析者 | Qwen-35B | 複雑な論理、長距離推論、精密検証 | 35B |

この分担は、人間の「直感 → 熟考」という二重システム思考(ダニエル・カーネマンのシステム1 / システム2)を模倣しています。

- システム1(4Bモデル):初期判断を高速に行い、明らかに無関係な思考パスをフィルタリング

- システム2(35Bモデル):システム1の候補案を深く検証・精緻化

新型ソルバーの役割

従来のハイブリッド手法(カスケード、early-exit)はシリアルでした。まず小モデルを実行し、満足できなければ大モデルを実行します。

Qwenの新型ソルバーは真の並列協調を実現しました。

- 両モデルが同じ入力を同時に処理

- ソルバーが中間層で情報交換とアテンション融合を行う

- 補助トレーニングにより、両モデルの表現空間を整合

パフォーマンス

コミュニティの初期テストによると:

| ベンチマーク | Qwen-35B単体 | ハイブリッド(4B+35B) | 向上率 |

|---|---|---|---|

| MATH | 78.2% | 81.6% | +3.4% |

| GSM8K | 91.3% | 93.1% | +1.8% |

| コード生成 (HumanEval) | 76.8% | 79.2% | +2.4% |

| 推論レイテンシ (P50) | 2.1秒 | 2.4秒 | +14% |

重要なトレードオフ:レイテンシは約14%増加しますが、深い推論を必要とする数学やコーディングタスクで2〜3%の大幅な向上が得られました。超低レイテンシを求めないシナリオでは、非常にコスト効率の良いトレードオフです。

なぜ重要なのか

1. 「大きければ大きいほど良い」という直感を打ち破る

業界が長く信じてきたスケーリング法則は「パラメータが多いほど、能力が強い」でした。しかし、このアーキテクチャは次のことを示しています。

賢いアーキテクチャ設計は、より少ないパラメータでより強い効果を達成できる。

39Bパラメータのハイブリッドシステム(35B + 4B)は、推論タスクにおいて70B以上の単一モデルのパフォーマンスに迫っています。

2. オープンソースコミュニティからのアーキテクチャイノベーション

これは単なるパラメータの積み上げではなく、アーキテクチャレベルのイノベーションです。数百億パラメータモデルのコストを負担できないチームにとって、このハイブリッド方案は新たな最適化方向を提供します。

3. Qwen 3.6製品マトリクスの完成

Qwen 3.6シリーズには、3つの明確な製品ラインが揃いました。

| 製品 | アーキテクチャ | ポジショニング |

|---|---|---|

| Qwen 3.6 Max Preview | 1T MoE(クローズドAPI) | フラッグシップ性能 |

| Qwen 3.6-27B | 稠密(オープンソース) | シングルカードデプロイ |

| Qwen 3.6 ハイブリッド (4B+35B) | 二脳協調(オープンソース) | 推論強化 |

アクション推奨

- 数学・論理推論がメインのシナリオの場合:ハイブリッドアーキテクチャを試す価値があります。2〜3%の向上は競技や研究の場面で大きな意味を持ちます

- 低レイテンシを重視する場合:27B稠密版がより適しています

- Agentシステムを構築中の場合:ハイブリッドアーキテクチャをプランナー層、27Bを実行層として使い、より強力な推論パイプラインを形成できます

情報源

- QwenLM 公式ツイート (2026-05-02)

- Qwen Blog: qwenlm.github.io

- コミュニティベンチマーク汇总