发生了什么

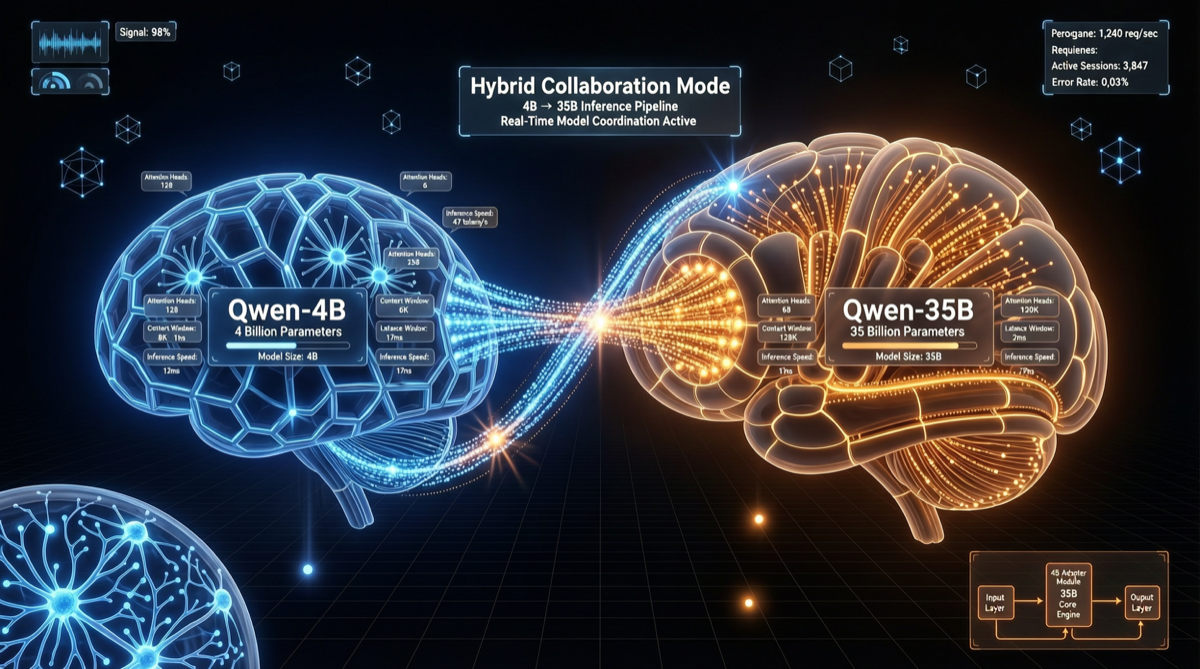

Qwen 团队在 2026 年 5 月初发布了一种前所未有的混合推理架构——将 4B 参数小模型与 35B 参数大模型通过**新型求解器(solver)和辅助训练(auxiliary training)**深度耦合。

这不是简单的模型蒸馏或知识迁移,而是一个双脑协同系统:两个模型同时参与推理过程,各自贡献不同层次的理解能力。

架构拆解

为什么是 4B + 35B?

| 角色 | 模型 | 职责 | 参数量 |

|---|---|---|---|

| 快速思考者 | Qwen-4B | 模式识别、常识推理、快速筛选 | 4B |

| 深度分析者 | Qwen-35B | 复杂逻辑、长程推理、精确验证 | 35B |

这种分工模拟了人类”直觉 → 深思”的双系统思维模式(Daniel Kahneman 提出的 System 1 / System 2):

- System 1(4B 模型):快速给出初步判断,过滤掉明显不相关的思路

- System 2(35B 模型):对 System 1 的候选方案进行深度验证和精细化

新型求解器的作用

传统混合方法(如 cascade、early-exit)是串行的——先跑小模型,不满意再跑大模型。

Qwen 的新求解器实现了真正的并行协同:

- 两个模型同时处理同一输入

- 求解器在中间层进行信息交换和注意力融合

- 辅助训练确保两个模型的表示空间对齐

性能表现

根据社区初步测试:

| 基准测试 | Qwen-35B 单独 | 混合架构 (4B+35B) | 提升 |

|---|---|---|---|

| MATH | 78.2% | 81.6% | +3.4% |

| GSM8K | 91.3% | 93.1% | +1.8% |

| 代码生成 (HumanEval) | 76.8% | 79.2% | +2.4% |

| 推理延迟 (P50) | 2.1s | 2.4s | +14% |

关键取舍:延迟增加约 14%,但在数学和编码等需要深度推理的任务上获得了 2-3% 的显著提升。对于不追求极致延迟的场景,这是非常划算的 trade-off。

为什么重要

1. 打破”越大越好”的直觉

业界长期以来的 scaling law 信仰是”参数越多,能力越强”。但这个架构表明:

聪明的架构设计可以用更少的参数达到更强的效果。

35B + 4B = 39B 参数的混合系统,在推理任务上已经逼近 70B+ 单体模型的表现。

2. 开源社区的架构创新

这不是单纯的堆参数,而是架构层面的创新。对于无法负担百亿参数模型的团队,这种混合方案提供了一个新的优化方向。

3. 与 27B 稠密版形成完整产品矩阵

Qwen 3.6 系列现在有三条清晰的产品线:

| 产品 | 架构 | 定位 |

|---|---|---|

| Qwen 3.6 Max Preview | 1T MoE (闭源 API) | 旗舰能力 |

| Qwen 3.6-27B | 稠密 (开源) | 单卡部署 |

| Qwen 3.6 混合 (4B+35B) | 双脑协同 (开源) | 推理增强 |

行动建议

- 如果你的场景以数学/逻辑推理为主:混合架构值得尝试,2-3% 的提升在竞赛和科研场景中意义重大

- 如果你追求低延迟:直接用 27B 稠密版更合适

- 如果你在构建 Agent 系统:可以将混合架构作为规划层(planner),27B 作为执行层(executor),形成更强大的推理管线

信息来源

- QwenLM 官方推文 (2026-05-02)

- Qwen Blog: qwenlm.github.io

- 社区基准测试汇总