Что произошло

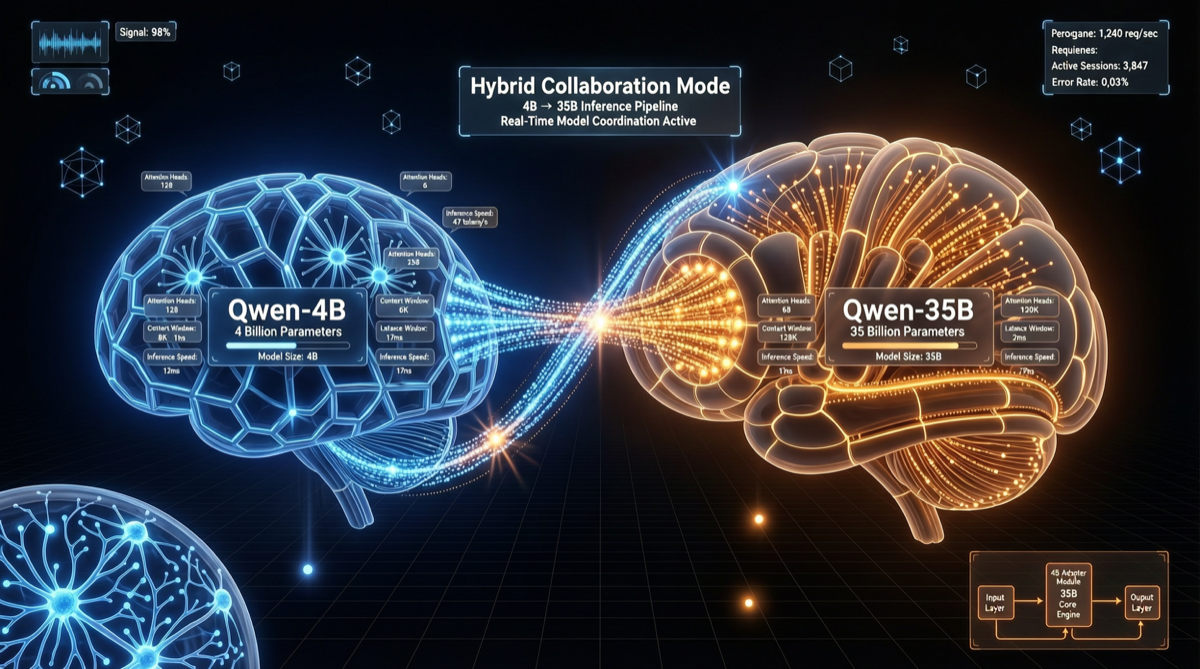

Команда Qwen в начале мая 2026 года выпустила не имеющую аналогов гибридную архитектуру вывода — объединение малой модели на 4B параметров и большой модели на 35B параметров через новый решатель (solver) и вспомогательное обучение (auxiliary training).

Это не простая дистилляция модели или перенос знаний, а двухмозговая коллаборативная система: обе модели участвуют в процессе рассуждения одновременно, каждая вносит свой уровень понимания.

Разбор архитектуры

Почему 4B + 35B?

| Роль | Модель | Задача | Параметры |

|---|---|---|---|

| Быстрый мыслитель | Qwen-4B | Распознавание паттернов, здравый смысл, быстрая фильтрация | 4B |

| Глубокий аналитик | Qwen-35B | Сложная логика, дальние рассуждения, точная верификация | 35B |

Такое разделение труда имитирует человеческое мышление «интуиция → обдумывание» по двойной системе (система 1 / система 2 Даниэля Канемана):

- Система 1 (модель 4B): Быстро даёт первоначальное суждение, отфильтровывает явно нерелевантные пути

- Система 2 (модель 35B): Глубоко проверяет и уточняет кандидатные решения Системы 1

Роль нового решателя

Традиционные гибридные методы (каскад, early-exit) являются последовательными — сначала запускается малая модель, затем, при неудовлетворённости, большая.

Новый решатель Qwen обеспечивает настоящую параллельную коллаборацию:

- Обе модели одновременно обрабатывают один и тот же ввод

- Решатель обменивается информацией и объединяет внимание на промежуточных слоях

- Вспомогательное обучение гарантирует согласованность пространств представлений обеих моделей

Производительность

По данным предварительных тестов сообщества:

| Бенчмарк | Только Qwen-35B | Гибрид (4B+35B) | Улучшение |

|---|---|---|---|

| MATH | 78,2% | 81,6% | +3,4% |

| GSM8K | 91,3% | 93,1% | +1,8% |

| Генерация кода (HumanEval) | 76,8% | 79,2% | +2,4% |

| Задержка вывода (P50) | 2,1 с | 2,4 с | +14% |

Ключевой компромисс: задержка увеличивается примерно на 14%, но при этом достигается значительное улучшение на 2-3% в задачах математики и программирования, требующих глубокого рассуждения. Для сценариев, не требующих ультранизкой задержки, это весьма выгодный компромисс.

Почему это важно

1. Разрушение интуиции «чем больше, тем лучше»

Долгое время отрасль верила в закон масштабирования: «больше параметров — больше возможностей». Но эта архитектура демонстрирует:

Умное архитектурное проектирование может достичь более сильных результатов с меньшим количеством параметров.

Гибридная система на 39B параметров (35B + 4B) уже приближается к производительности одиночных моделей на 70B+ в задачах рассуждения.

2. Архитектурная инновация от сообщества открытого кода

Это не просто накопление параметров, а инновация на уровне архитектуры. Для команд, которые не могут позволить себе модели со сотнями миллиардов параметров, этот гибридный подход предоставляет новое направление оптимизации.

3. Завершение продуктовой линейки Qwen 3.6

Серия Qwen 3.6 теперь имеет три чёткие продуктовые линии:

| Продукт | Архитектура | Позиционирование |

|---|---|---|

| Qwen 3.6 Max Preview | 1T MoE (закрытый API) | Флагманские возможности |

| Qwen 3.6-27B | Плотная (открытый код) | Развёртывание на одной карте |

| Qwen 3.6 Гибрид (4B+35B) | Двухмозговое сотрудничество (открытый код) | Усиление рассуждений |

Рекомендации к действию

- Если ваш сценарий сосредоточен на математике/логическом рассуждении: Гибридная архитектура заслуживает внимания — улучшение на 2-3% имеет большое значение в соревнованиях и исследованиях

- Если вы приоритизируете низкую задержку: Версия 27B более подходит

- Если вы строите Agent-системы: Используйте гибридную архитектуру как слой планировщика, а 27B как слой исполнителя для более мощного конвейера рассуждений

Источники

- Официальный твит QwenLM (2026-05-02)

- Блог Qwen: qwenlm.github.io

- Сводка бенчмарков сообщества