核心结论

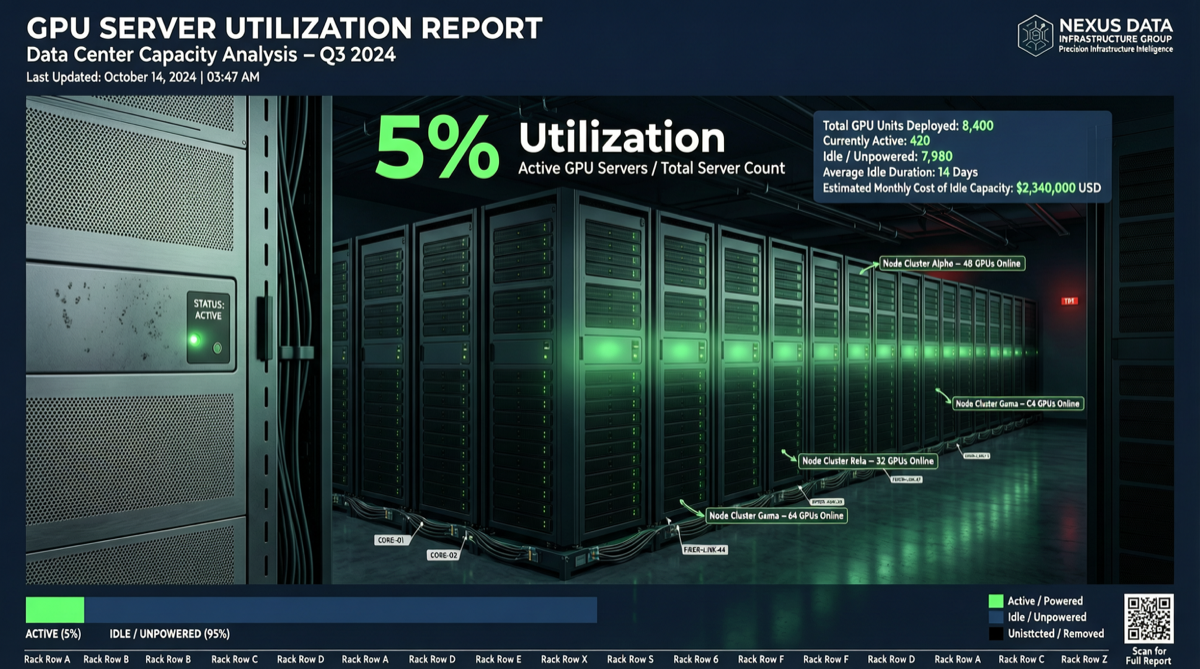

Cast AI 对约 23,000 个 Kubernetes 集群的分析揭示了一个令人震惊的事实:企业 GPU 平均利用率仅为 5%。换句话说,95% 的 GPU 算力处于闲置状态。与此同时,CPU 利用率为 8%,内存利用率为 20%。

这不是某个小样本的异常——这是整个行业的系统性浪费。

数据全景

资源利用率对比

| 资源类型 | 平均利用率 | 闲置比例 | 浪费等级 |

|---|---|---|---|

| GPU | 5% | 95% | 🚨 极度浪费 |

| CPU | 8% | 92% | 🚨 极度浪费 |

| 内存 | 20% | 80% | ⚠️ 严重浪费 |

为什么会出现这种现象?

恐惧驱动的配置(Fear-Based Provisioning):企业害怕错过 GPU 分配、害怕性能瓶颈、害怕被业务团队投诉,于是大规模超额配置。这种心态类似于疫情期间的卫生纸抢购——不是因为需要,而是因为”怕没有”。

关键发现拆解

1. GPU 利用率 5% 意味着什么

假设一家企业购买了 100 张 H100 GPU,每小时成本约 $30-40。按 5% 利用率计算:

- 实际有效算力:相当于 5 张 H100 全速运行

- 浪费的算力:相当于 95 张 H100 在空转

- 年化浪费成本:约 250-320 万美元

这还不包括配套的 CPU、内存、网络、冷却等基础设施成本。

2. CPU 与 GPU 的新型失衡

另一个被忽视的趋势:GPU 性能的提升速度远超 CPU。这意味着每单位 AI 算力所需的 CPU 配套资源正在滞后。实验室正在与超大规模云厂商直接竞争 x86 CPU 产能,进一步推高了整体成本。

3. 多资源同时闲置

GPU、CPU、内存同时处于低利用率状态,说明问题不在某个单一资源的配置错误,而是整体资源规划方法论的系统性失效。

为什么重要

对企业的直接影响

- 成本黑洞:每年数亿美元的 GPU 预算中,95% 是纯粹浪费

- 竞争力下降:同等预算下,高效企业可以获得 20 倍于低效企业的实际算力

- 环境影响:闲置 GPU 仍然消耗电力和产生碳足迹

行业层面的信号

| 信号 | 含义 |

|---|---|

| GPU 供不应求是假象 | 真实需求远低于表面需求 |

| 云厂商 GPU 定价权可能被削弱 | 当企业意识到浪费后,采购策略会改变 |

| 资源优化工具市场爆发 | 自动伸缩、混部调度、GPU 分时复用将成刚需 |

行动建议

企业 CTO/技术负责人

- 立即审计 GPU 利用率:使用 Prometheus + NVIDIA DCGM 监控实际 GPU 使用率

- 实施 GPU 分时复用(MIG):将单张 GPU 切分为多个实例,提升并发利用率

- 引入自动伸缩策略:根据实际负载动态调整 GPU 分配,而非静态分配

- 建立成本问责机制:将 GPU 利用率纳入团队 KPI

AI 工程师

- 批量推理而非实时推理:将多个推理请求合并处理,提升 GPU 吞吐

- 模型量化与蒸馏:用更小模型满足业务需求,减少 GPU 依赖

- 使用推理优化框架:vLLM、TensorRT-LLM 等框架可显著提升 GPU 利用率

投资者/分析师

- 关注资源优化赛道:Cast AI、Run:ai、Volcon AI 等 GPU 优化平台价值凸显

- 警惕算力叙事泡沫:GPU 采购量不等于 AI 能力,利用率才是关键指标

- 寻找”20 倍效率差”企业:能在同等预算下实现 20 倍算力效率的公司将获得巨大竞争优势

格局判断

算力浪费的转折点可能即将到来。

当第一批企业通过优化实现”用 1/20 的成本完成同样的 AI 任务”时,行业将不得不正视这个问题。这不是技术升级问题——这是管理方法论的根本转变。

与此同时,这也为 AI 创业公司提供了一个巨大机会:谁能帮助客户将 GPU 利用率从 5% 提升到 50%,谁就掌握了万亿美元算力市场的入口。