一个在 X 上获得 319 个赞和 45 次转发的帖子揭示了 2026 年本地 AI 领域正在发生的事:五款工具组合,完全免费,能力超过大多数企业的付费方案。

发生了什么

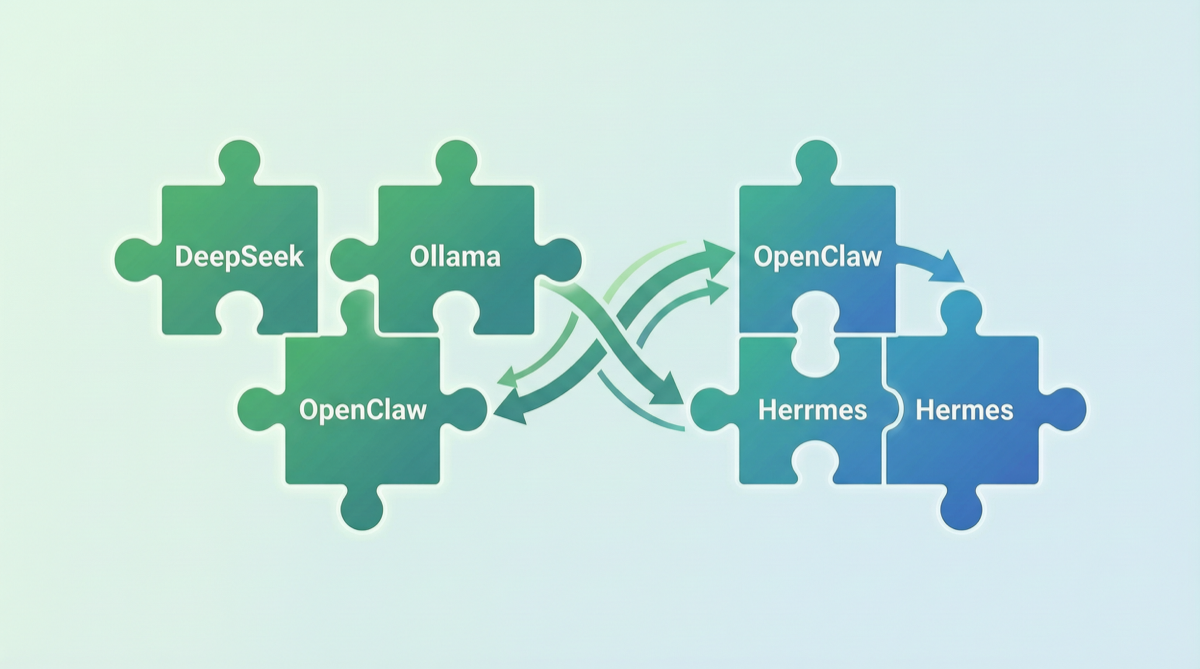

周末有人用以下工具链拼出了一套本地 AI 全家桶:

- DeepSeek V4 Flash —— 推理引擎(284B 参数,MoE 架构,API 价格约为 GPT-5.5 的 1/166)

- Ollama —— 本地模型管理(一行命令下载和运行 GGUF 模型)

- OpenClaw —— 24/7 本地 Agent 守护进程(自动任务执行、文件操作、Web 浏览)

- Hermes Agent —— 智能 Agent 编排(模型路由、技能管理、工作流自动化)

- Claude Code —— 编码辅助 CLI(可与本地模型协同使用)

这套方案的核心逻辑是:开源模型提供智能,开源框架提供能力,本地硬件提供算力——三方加起来,成本为零。

各组件角色拆解

DeepSeek V4 Flash:性价比之王

| 参数 | V4-Flash | V4-Pro |

|---|---|---|

| 总参数 | 284B | 1.6T |

| 激活参数 | ~28B | ~37B |

| 上下文窗口 | 128K | 1M |

| 架构 | MoE | MoE |

| 许可证 | Apache 2.0 | Apache 2.0 |

V4-Flash 是这个栈的推理引擎选择原因:

- MoE 架构保证在消费级硬件上可运行

- 编码能力与闭源模型差距不到 0.2 分(SWE-bench)

- Apache 2.0 许可证允许商用

Ollama:模型即服务

Ollama 把本地模型变成了”一行命令就能用”的服务:

# 一行下载并运行 DeepSeek V4 Flash

ollama run deepseek-v4-flash

# 同时运行多个模型

ollama run qwen3.6-27b &

ollama run gemma-4-26b &2026 年,Ollama 已经成为本地 AI 的事实标准——它屏蔽了 GGUF 量化、GPU 分配、上下文管理等底层细节。

OpenClaw:7×24 本地 Agent

OpenClaw 的定位是”永不停歇的 AI 员工”:

- 常驻后台,监听任务队列

- 自动执行文件操作、代码修改、网页浏览

- 支持定时任务(每天早上生成报告、监控价格变动)

- 最新 4.24 版本已将 DeepSeek V4 Flash 设为新用户默认模型

Hermes Agent:智能编排层

Hermes Agent 是这个栈的”大脑”:

- 模型路由:根据任务复杂度自动选择模型

- 技能管理:自动发现和加载工具技能

- 工作流自动化:组合多个工具完成复杂任务

- LM Studio 集成:5 月 1 日新增原生支持

Claude Code:编码辅助补充

虽然整个栈以本地模型为主,但 Claude Code 作为编码辅助的补充选项仍然保留。在需要极致编码质量的场景中,可以临时切换到 Claude API。

搭建步骤

第一步:安装 Ollama + 模型

# 安装 Ollama

curl -fsSL https://ollama.com/install.sh | sh

# 下载 DeepSeek V4 Flash

ollama pull deepseek-v4-flash

# 下载备用模型(推荐 Qwen 3.6 27B)

ollama pull qwen3.6:27b第二步:部署 OpenClaw

# 安装 OpenClaw

npm install -g openclaw

# 配置默认模型

openclaw config set model deepseek-v4-flash

# 启动守护进程

openclaw daemon start第三步:配置 Hermes Agent

# 初始化 Hermes

hermes init

# 连接 Ollama 后端

hermes connect ollama --auto-discover

# 启用模型路由

hermes config set routing.strategy "auto-complexity"成本对比

| 方案 | 月度成本 | 能力覆盖 | 数据隐私 |

|---|---|---|---|

| GPT-5.5 API | $50-500+ | 全场景 | ❌ 数据出境 |

| Claude Opus 4.7 API | $80-800+ | 编码最强 | ❌ 数据出境 |

| 本方案(本地) | $0(硬件已有) | 90% 场景 | ✅ 完全本地 |

| 本方案 + 云端兜底 | $10-50 | 100% 场景 | 大部分本地 |

局限性和注意事项

- 硬件门槛:V4-Flash 需要至少 24GB 显存(RTX 3090/4090 级别)。如果只有 16GB,可以跑量化版本但速度会下降

- 编码质量差距:DeepSeek V4 Flash 的编码能力虽然接近闭源模型,但在复杂重构场景中仍不如 Claude Opus 4.7

- OpenClaw 学习曲线:系统提示管理和工具配置需要一定上手时间

- 不是银弹:这套方案适合”够用就行”的场景,极致性能需求仍需云端 API

格局判断

五款工具组合的流行揭示了一个关键趋势:AI 能力正在从”付费 API”向”开源组合”转移。2025 年还需要付费订阅才能获得的智能水平,2026 年用开源工具 + 本地硬件就能实现。

这不是说闭源模型没有价值——它们在极致性能、可靠性和企业级 SLA 上仍然领先。但对于个人开发者、小团队和预算敏感的场景,免费本地栈已经是一个严肃的替代方案。

行动建议

| 你的情况 | 建议 |

|---|---|

| 有 RTX 3090/4090 | 立即搭建,DeepSeek V4 Flash + Ollama 是最低启动成本 |

| 预算紧张但不想放弃 AI 能力 | 本地栈 + 偶尔云端兜底,月成本控制在 $20 以内 |

| 企业级用户,数据安全敏感 | 本地栈天然满足数据不出域要求,优先考虑 |

| 追求极致编码质量 | 保留 Claude API 作为补充,日常任务用本地栈 |