英伟达不再只做卖铲子的人了。

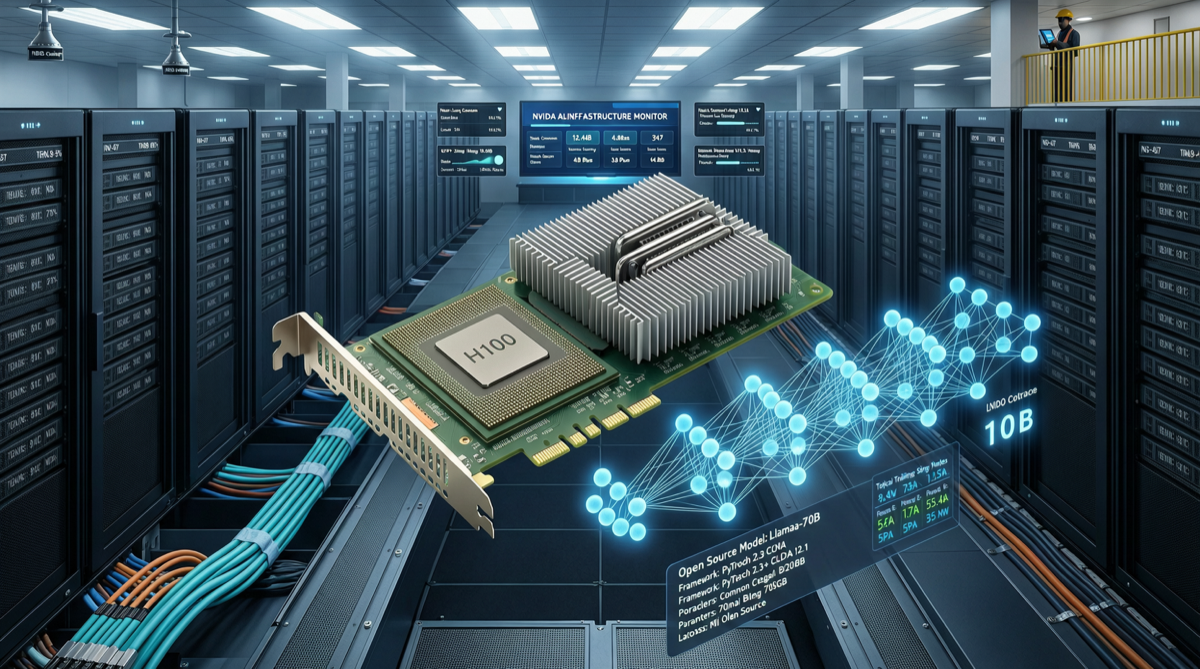

据 36 氪报道,英伟达宣布未来五年投入 260 亿美元研发开源大模型,正式从硬件巨头转型为全栈 AI 企业。配合已发布的 Nemotron 3 系列(Nano、Super、Ultra 三种规模),英伟达正在构建一个从芯片到模型的闭环生态。

其中最引人注目的是 Nemotron 3 Super——1280 亿参数,在综合评分中以 37 分超越 OpenAI GPT-OSS 的 33 分。

英伟达为什么要自己做模型

这个问题两年前就有人问过。当时英伟达的回答是"我们做模型是为了让芯片更好卖"。

现在答案变了。260 亿美元的投入规模说明英伟达不再满足于只做参考实现。 他们在认真地和 OpenAI、Anthropic、Google 竞争模型能力。

但竞争方式和这三家不同。英伟达走的是全开源路线:

- Nemotron 3 Nano Omni:全模态 Agent 模型,消费级 GPU 可运行(RTX 5090 就能跑)

- Nemotron 3 Super:1280 亿参数,面向企业级应用

- 全部开源,没有闭源的"旗舰版"

这和 Meta 的 Llama 策略类似——用开源换取生态绑定。但英伟达比 Meta 多一张牌:芯片。模型开源 + 芯片优化 = 更强的生态锁定。

对国产 AI 生态的影响

这才是最值得关注的部分。

国产模型公司(Qwen、Kimi、DeepSeek、智谱等)目前的核心策略是开源换生态。Nemotron 的入局意味着:

- 开源模型的质量基线被抬高:1280 亿参数的 Nemotron 3 Super 在综合评分上超过 GPT-OSS。这意味着国产模型需要在同等参数规模下拿出更有竞争力的表现

- 芯片绑定效应:Nemotron 系列深度优化了 Hopper 和 Blackwell 架构的 FP8 推理。如果模型能力足够好,开发者会自然倾向于用 NVIDIA 芯片

- 国产芯片的窗口期在缩小:华为昇腾、寒武纪等国产芯片的竞争力部分来自于"没有好的 NVIDIA 模型可用"。如果 NVIDIA 的开源模型在国产芯片上也能跑(或者适配成本降低),国产芯片的差异化优势会减弱

但反过来看,这也给国产生态带来机会:

- 开源模型的竞争对开发者是好事:更多高质量的开源选项意味着更低的成本和更强的议价能力

- 国产芯片如果能跑通 Nemotron 的推理优化,就等于间接获得了英伟达 260 亿美元研发投入的红利

关键变量:Nemotron 在国产芯片上的适配

这才是决定未来格局的关键。

Nemotron 系列目前主要优化的是 NVIDIA 自己的硬件。如果:

- 适配顺利:国产芯片能快速跑通 Nemotron 的推理,那国产生态会受益

- 适配困难:开发者只能在 NVIDIA 芯片上获得最佳性能,那生态锁定会加强

目前国内社区对 Nemotron 的适配讨论还不多。这是一个需要持续观察的指标。

判断

英伟达 260 亿美元的开源模型投入,短期内不会改变模型格局——Qwen 3.6、Kimi K2.6、DeepSeek V4 Pro 在各自领域仍然有竞争力。但中长期来看,英伟达的芯片+模型闭环是一个需要认真对待的变量。

对国产模型公司的建议:继续开源、继续优化中文能力、继续降低推理成本。英伟达的模型再好,中文能力和本地化服务短期追不上。

对使用开源模型的开发者的建议:Nemotron 系列值得加入你的模型选型列表,特别是如果你有 NVIDIA 硬件。对比测试一下,看看在你的场景下和 Qwen、Kimi 的表现差异。

主要来源: