世界模型(World Model)这个概念在 AI 圈不算新鲜。Yann LeCun 念叨了好几年,认为它是通向真正智能的必经之路。他也确实写过文章对比世界模型和 LLM 的路线差异。但一直以来,"世界模型"更多停留在论文和概念层面——能实时运行的、延迟低到可以交互的,几乎没有。

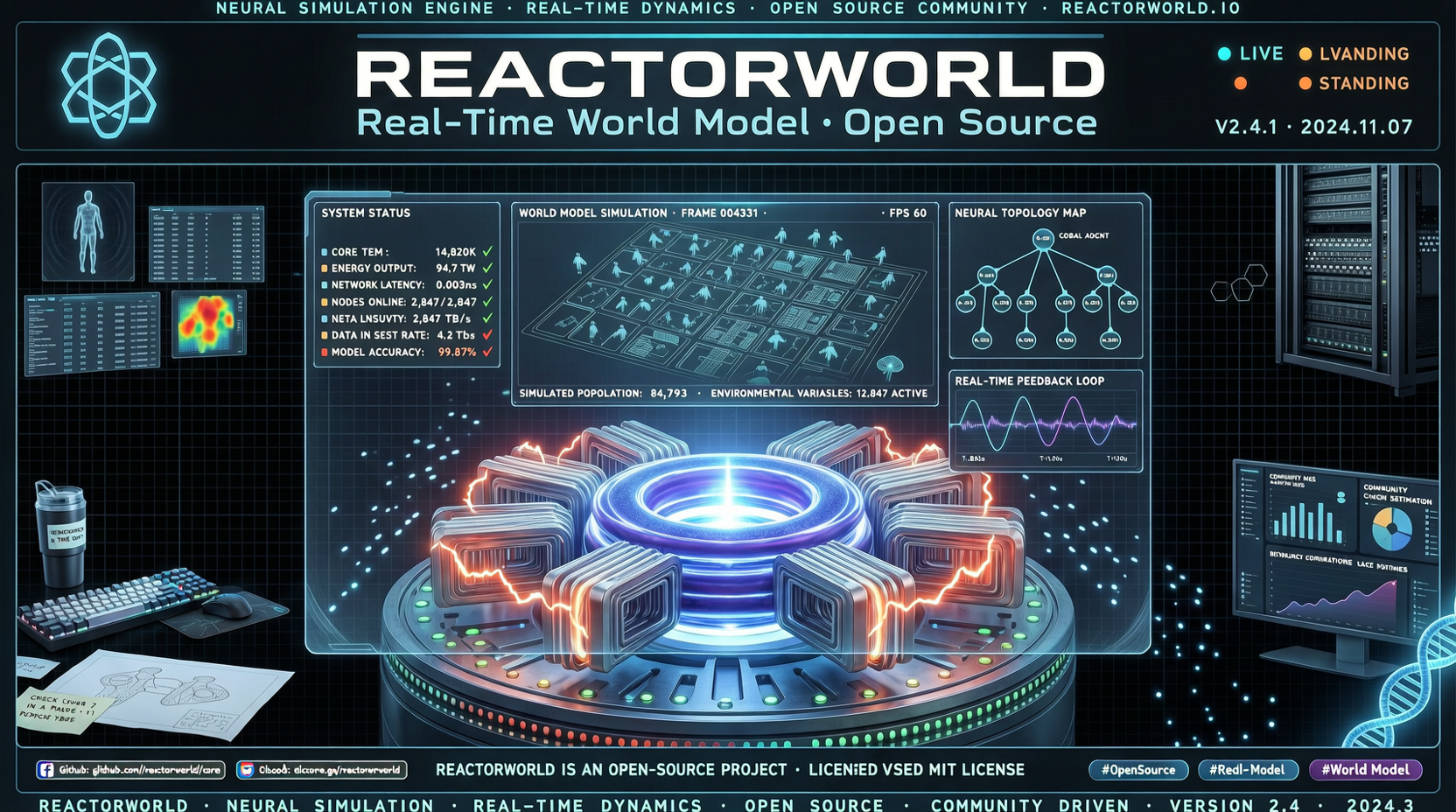

ReactorWorld 昨天上线了一个 early preview,把延迟压到了 50ms 以下。

50ms 是什么概念?人类视觉系统的反应延迟大概在 100-200ms。也就是说,ReactorWorld 的生成速度已经快到人眼无法感知延迟的程度。你输入一个 prompt,场景实时生成,然后你可以随时修改 prompt、调整场景、控制接下来的内容走向。

它解决了什么问题

世界模型的核心能力是理解并生成"世界的状态变化"。不是生成一张静态图片,也不是生成一段预渲染的视频——而是在你交互的过程中,实时推演接下来会发生什么。

ReactorWorld 的做法是用一个低延迟的全球基础设施来支撑推理。它跑在自家的分布式系统上,而不是某个本地 GPU。这意味着你不需要 H100 集群,打开网页就能体验。

这对于几个场景特别有意义:

- 游戏和交互媒体:实时生成游戏场景,NPC 行为由模型实时推演

- 物理 AI:LeCun 说的"物理世界的 AI" 需要世界模型来理解环境。ReactorWorld 提供了一个低延迟的推理后端

- 模拟和训练:用实时世界模型做机器人训练、自动驾驶仿真

开源意味着什么

ReactorWorld 选择了开源路线。这意味着开发者可以直接看代码、fork 项目、在它的基础上做二次开发。

但需要注意一个细节:开源的是模型和工具链,推理基础设施是 ReactorWorld 自己的。如果你想本地跑,需要自己解决算力问题——而世界模型的算力需求不是普通消费级 GPU 能应付的。

这一点和 Qwen Scope 的开源策略类似:开放核心算法,基础设施自己掌控。

现在能用吗

early preview 已经上线,可以在 ReactorWorld 的网站上试用。延迟表现据称在 50ms 以下,但我没有亲测,这个数据需要实际体验来验证。

对于开发者来说,更有价值的是代码库。如果你在做世界模型相关的研究或应用,ReactorWorld 提供了一个可以跑的 baseline。

和现有方案的对比

世界模型赛道目前比较拥挤。Sora 类的视频生成模型是预渲染方案,不能实时交互。Runway 和 Pika 走的也是这个路线。ReactorWorld 的差异在于"实时"——它不是生成一段视频给你看,而是在你交互的过程中持续推演。

这个差异很重要,但也很脆弱。50ms 的延迟承诺依赖于 ReactorWorld 自己的基础设施,一旦用户量上来,延迟能不能维持是个问号。

观察点

我会继续跟的几个指标:

- 延迟在负载增加后的表现——这是最关键的

- 开源社区的贡献活跃度——决定这个项目能不能形成生态

- 和物理 AI / 机器人训练的集成案例——这是世界模型最大的应用方向

主要来源:

- ReactorWorld on X

- ReactorWorld 官方预览页面