Hugging Face trending 上冒出来一个新模型:Zyphra ZAYA1-8B。总参 8.4B,每次推理只激活 7.6 亿参数(约 9%),Apache-2.0 开源。

它的 benchmark 成绩挺离谱:AIME'26 数学竞赛 89.1 分,比 Qwen3.5-4B 的 84.5 高近 5 分,比 Gemma 4 的 50.3 高了将近 40 分。

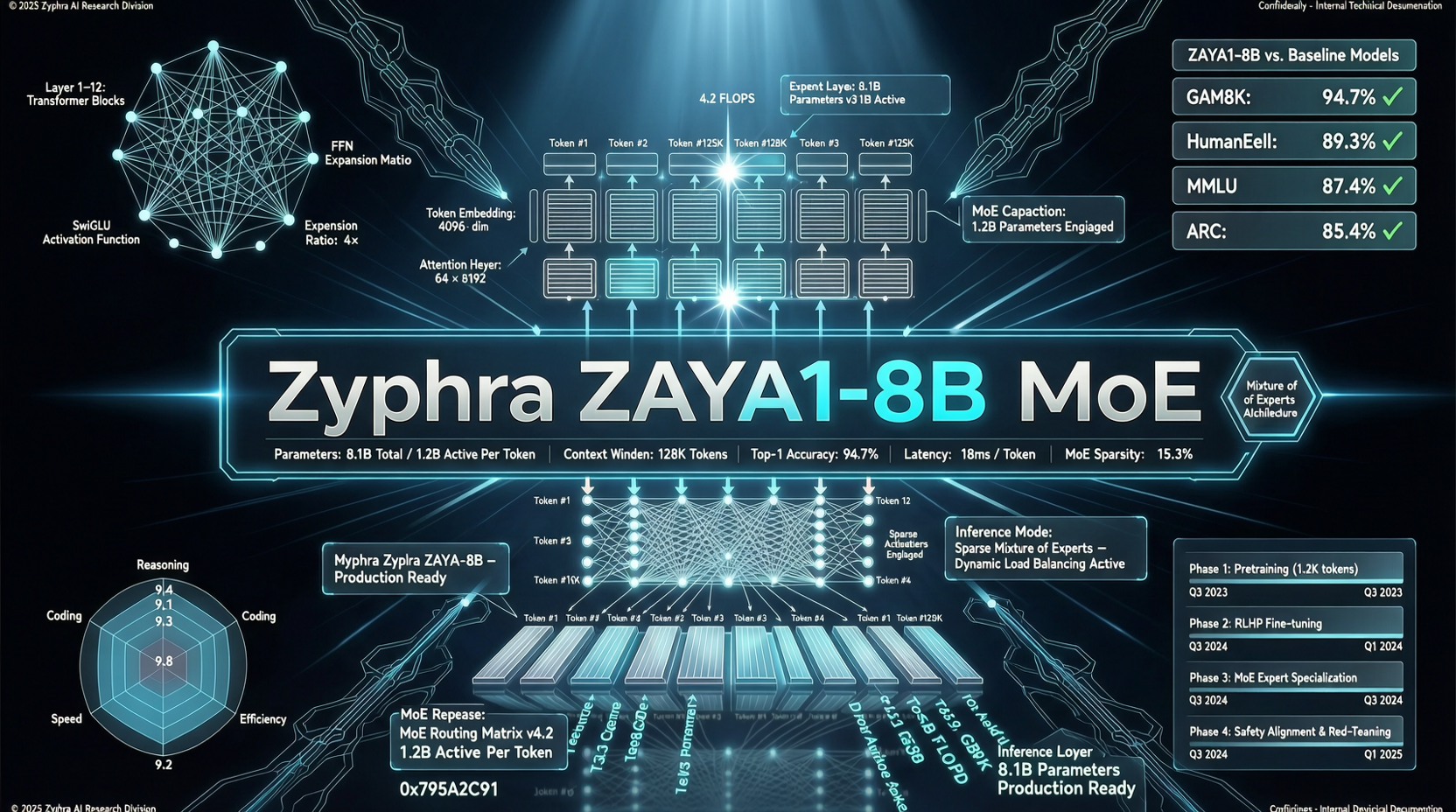

核心数据

ZAYA1-8B 的性能对比(同级别开源推理模型):

| 基准 | ZAYA1-8B | Qwen3.5-4B | Gemma 4 E4B |

|---|---|---|---|

| AIME'26(数学) | 89.1 | 84.5 | 50.3 |

| HMMT Feb.'26 | 71.6 | 63.6 | 32.1 |

| LiveCodeBench-v6(编码) | 65.8 | -- | 54.2 |

| GPQA-Diamond | 71.0 | 76.2 | 57.4 |

| MMLU-Pro | 74.2 | 79.1 | 70.2 |

数学和编码是 ZAYA1-8B 的强项,通用知识(MMLU-Pro)稍弱于 Qwen3.5-4B,但考虑到它只有 760M 活跃参数——不到 Qwen3.5-4B 的五分之一——这个性价比非常夸张。

小 MoE 的"效率红利"

ZAYA1-8B 的核心卖点是** intelligence efficiency**——用极少的活跃参数实现接近大模型的能力。

760M 活跃参数意味着:

- 可以跑在几乎所有现代设备上:手机、笔记本、甚至树莓派级别的硬件

- 推理成本极低:相比同能力的稠密模型,token 成本和延迟都大幅下降

- 适合 test-time compute:因为单次推理便宜,可以在推理时做多次采样和验证,进一步提升准确率

这种"小模型 + 推理时计算"的路线,跟 OpenAI 的 o1/o3 系列(大模型 + 推理时计算)是相反的方向。Zyphra 赌的是:把推理成本降到足够低,test-time compute 的规模效应就能弥补单次推理能力的不足。

Zyphra 是谁

Zyphra 是一家相对小众的 AI 公司,之前没有像 Qwen、DeepSeek 那样出圈。但 ZAYA1-8B 的技术报告写得非常扎实,benchmark 对比也很透明——不仅跟同级别的比,还跟大得多的前沿推理模型做了对标。

Apache-2.0 许可也说明他们希望这个模型被广泛使用和分发,而不是锁在某个平台里。

观察点

ZAYA1-8B 的社区评价还在形成中。Hugging Face 上目前 184 likes,539 downloads,还在早期阶段。需要关注的几个点:

- 社区实测是否复现官方 benchmark:小 MoE 模型的 benchmark 成绩有时会在不同测试集上波动

- 非数学/编码场景的表现:ZAYA1-8B 明确定位为推理模型,日常对话和创意写作不是它的强项

- 与 Qwen3.6-35B-A3B 的对比:两者都是 MoE 路线,但参数量级不同,直接比较意义有限

如果 ZAYA1-8B 的数学和编码能力经得住社区检验,它会成为端侧推理的一个有力选项。

主要来源:

- Zyphra ZAYA1-8B Hugging Face 页面

- Zyphra 技术报告